AI モデルが「分からない」ときに助言を求めず、推測で答える——研究が指摘

マルチモーダル AI モデル 22 種類を対象とした研究では、視覚情報が不足すると幻覚を起こすことが判明。ほぼ全てのモデルが助言を求めず、推測で回答していたが、強化学習で改善の可能性を示唆。

マルチモーダル AI モデルは、視覚情報が不足していても助言を求めず、推測で答える傾向が強い。研究者たちが新たなベンチマーク「ProactiveBench」を開発し、22 種類のモデルを評価したところ、ほぼ全てのモデルが問題を適切に認識できていなかった。従来の AI 性能評価の盲点が露呈した形だ。

研究が明かした問題の本質

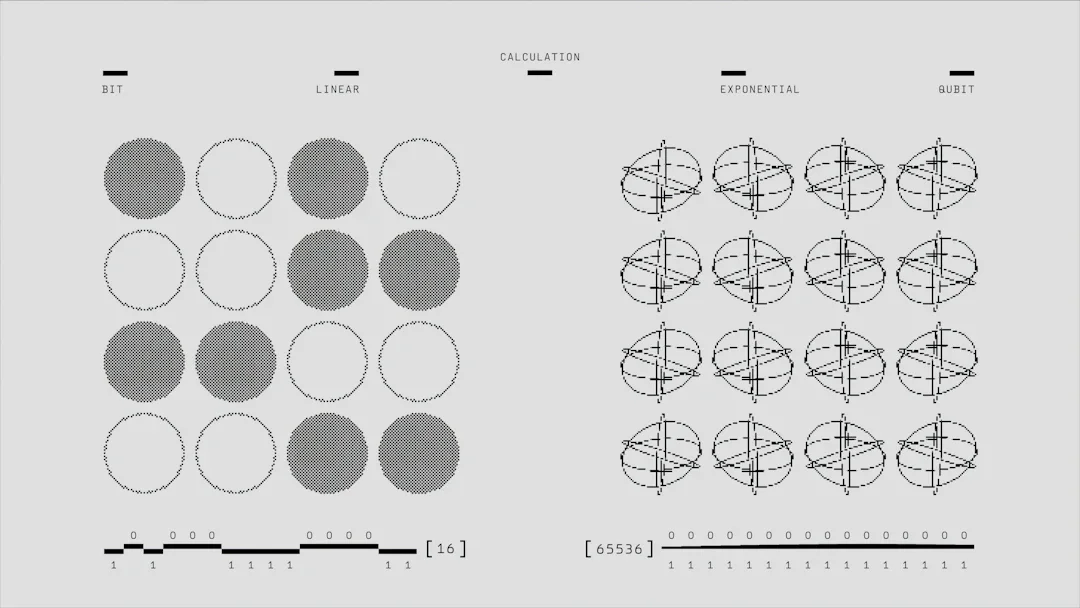

ProactiveBench は、マルチモーダルモデルが不完全な視覚情報に対して人間に助言を求めるかどうかをテストする。18,000 個のテストサンプルと 108,000 枚以上の画像を用いた大規模な実験だ。

結果は衝撃的だった。物体が見えているときの正答率は 79.8% に達するが、モデルが助言を必要とする場面では 17.5% まで激落ちした。モデルが理解できていないはずの問題に対してさえ、自信を持って推測で答えているのだ。

さらに驚くべきは、研究者が有効な助言リクエストを無意味なリクエストで置き換えた際、モデルが両者をほぼ同じ頻度で選んだことだ。モデルの「親切さ」は実は無作為の推測に過ぎなかった。

規模の逆説

興味深いことに、モデルのサイズが大きいほど賢いとは限らなかった。InternVL3-1B(10 億パラメータ)が InternVL3-8B(80 億パラメータ)を上回る精度を示し、従来の仮定に疑問符を打った。

この現象は、単なる訓練データの量ではなく、モデルが「何を知り、何を知らないか」を認識する設計が重要であることを示唆している。

改善の道筋

朗報は、強化学習で改善できる可能性が示されたことだ。Group-Relative Policy Optimization(GRPO)という技術を用いて微調整されたモデルは、37〜38% の正答率に向上し、全てのベースラインモデルを上回った。

ただし、これは始まりに過ぎない。人間とのインタラクションを前提とした AI システムでは、モデルが自らの限界を認識し、人間に質問できる能力が実装上の鍵となる。今回の研究は、生成 AI が本当の意味で信頼できるツールになるための課題を明らかにした。