AI更新に残る『指紋』が浮かび上がらせる新リスク

AIモデルの更新で残る「指紋」が機微データ(個人情報や機密情報)の露出を示す手掛かりになり得るため、企業は透明性と監査体制を強化し、利用者は更新情報を定期的に確認する姿勢が有効です。

AIモデルの更新作業で「指紋」と呼ばれる痕跡が注目を集めています。指紋とは、更新後のモデル挙動や残存情報から見える痕跡のことです。これが機微データの露出につながる可能性が指摘され、業界で議論が活発になっています。

指紋とは何か、なぜ気にするべきか

ここでいう機微データとは、個人情報や企業秘密など、扱いに注意が必要なデータのことです。更新時にこうしたデータが学習に含まれると、モデルの内部に痕跡が残ることがあります。イメージとしては、雪上に残る足跡です。足跡そのものが証拠になり得るように、更新の「指紋」も露出の手掛かりになります。

現時点では、公開された情報だけで因果関係が確定したわけではありません。ただし懸念は現実的です。だからこそ検証と透明性が求められます。

どうして起きるのか(背景)

大規模言語モデル(LLM)は大量のデータで学習します。大規模言語モデルとは、多数の文章を使って言葉を理解し生成するAIのことです。データ量が多いほど能力は上がりますが、出所の追跡は難しくなります。訓練中や更新時に使われたデータの管理を怠ると、予期せぬ痕跡が残る恐れがあります。

技術的には、学習データの混入やチェックポイントの取り扱い、微調整時の設定などが関係します。公開情報は限られているため、現場での慎重な検証が必要です。

誰に影響が及ぶのか

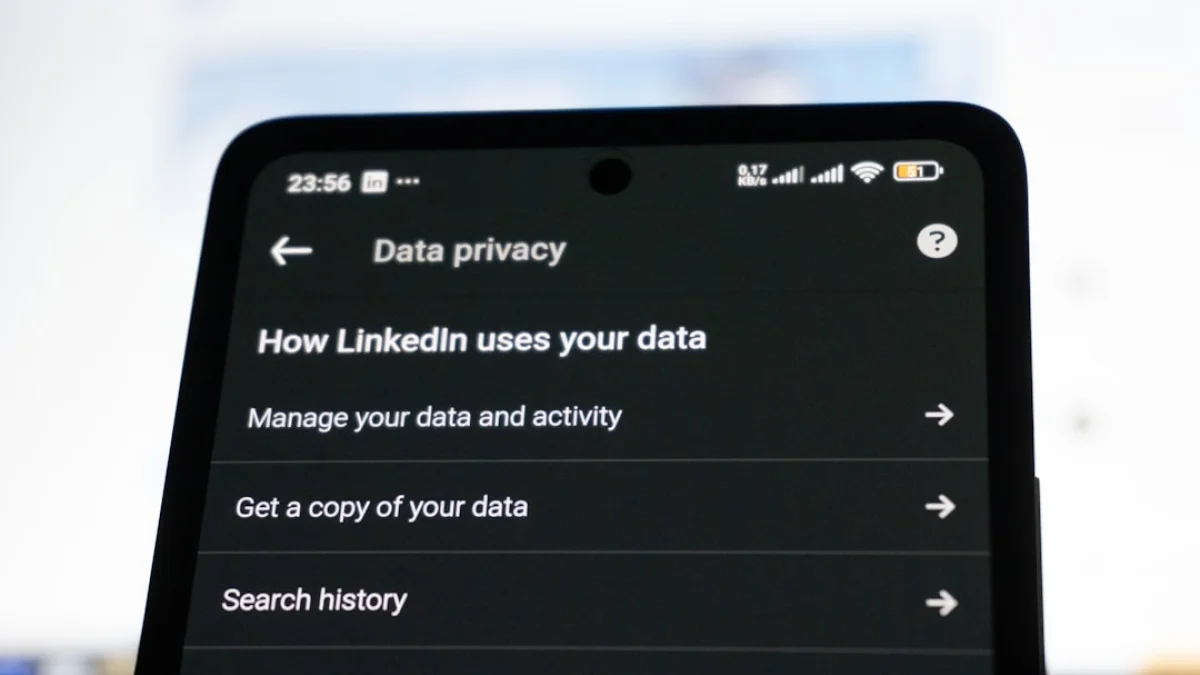

影響は幅広く考えられます。個人利用者はプライバシーの懸念に直面します。企業は機密情報の流出リスクに備える必要があります。サービス提供者は信頼性の維持が課題です。普及したツールほど、取り扱いミスの影響は大きくなります。

現場では、利用ポリシーの周知や生成物の出所確認といった実務対応が重要になってきます。

現実的な対策と現場でできること

対策は技術と運用の両輪が要です。技術面では差分の監視や異常検知、差分プライバシーなどの手法が挙げられます。運用面では更新履歴の記録、監査ログの保存、第三者監査の導入が効果的です。

具体的には次のような取り組みが現実的です。

- 更新前後の挙動を自動で比較するモニタリング

- 学習データの出所管理とアクセス制御の強化

- 変更点を説明する透明性レポートの定期公開

これらは即効薬ではありませんが、リスクを大幅に下げる実務策です。

これからの見通し

業界団体や規制当局が基準作りを進めると期待されています。標準化が進めば、ベストプラクティスの共有が広がります。企業は段階的に体制を整えることが求められます。

利用者としては、使うツールの更新方針や開示状況を定期的に確認する習慣が有効です。問題を公にすることで改善が加速します。

結論:透明性とセキュリティを両立させるために

更新時に残る「指紋」は、問題の兆候を示す重要な手掛かりになり得ます。因果関係の確定には追加検証が必要ですが、透明性と監査可能性の強化は明確な解です。技術的対策と運用の改善を同時に進め、ユーザー教育も欠かさないことが信頼を築く近道でしょう。今後の動きを注視し、必要があればベンダーに説明を求めてください。