GPT-5.3 Codex Spark、15倍速&128k対応

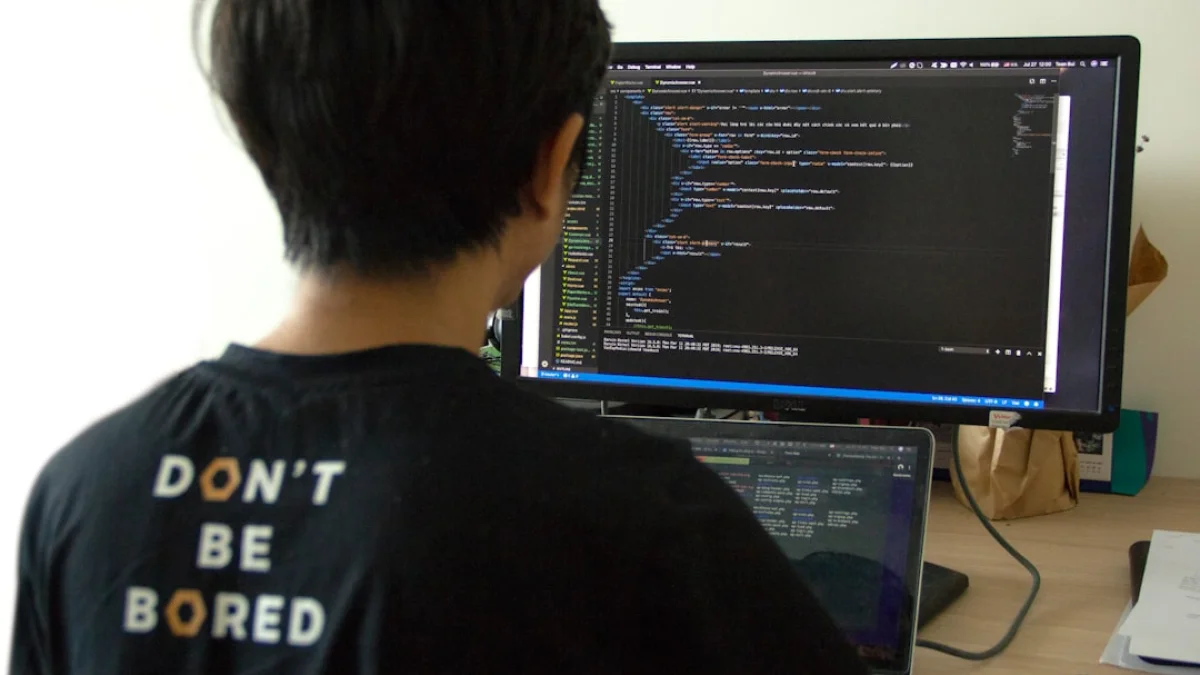

GPT-5.3-Codex-SparkはChatGPT Pro向けの研究プレビューで、コード生成を約15倍高速化し128kの長文コンテキストを扱える点が特長で、リアルタイム開発の可能性を大きく広げます。

新時代のリアルタイムコーディングが見えてきた

OpenAIが発表したGPT-5.3-Codex-Sparkは、リアルタイム向けのコード生成に特化したモデルです。今回の注目点は生成速度が約15倍になったことと、128kのコンテキストをサポートする点です。

コンテキストとは何か

コンテキストとは、モデルが一度に参照できる入力の長さのことです。長いコードファイルや設計書を一度に扱えるため、広い範囲の補完や解析が可能になります。

どんな変化が期待できるのか

15倍の高速化は、エディタでの補完がほぼ遅延なく流れるような体験を生むかもしれません。128kのコンテキストは、大きなリポジトリや長い関数、ドキュメントを丸ごと渡して解析する用途に向いています。

たとえば、数千行のコードをまたいだリファクタリング支援や、長い設計書を参照しながらの自動生成が現実味を帯びます。小さなファイルを次々と補完する従来の流れから、大きな文脈を一度に扱う新しいワークフローへと変わる可能性があります。

今すぐ使えるのか

現時点ではChatGPT Proユーザー向けの研究プレビューとして提供されています。公式は研究段階であることを強調しており、正式な運用開始や具体的な導入事例はこれから公開される見込みです。

注意点と期待

実務での効果は、統合先のツールやCI/CD、プラグインなどとの相性によって変わります。とはいえ、リアルタイム性と大容量コンテキストの組み合わせは、開発効率を高める大きな一歩です。

エディタ上で大型ファイルの補完が滑らかに動く様子を想像すると、まるで川の流れが速くなって景色が変わるようなワクワク感があります。今後のベンチマークや実例の発表で、さらに実用性が明らかになるでしょう。

結びにかえて

GPT-5.3-Codex-Sparkは、リアルタイムコーディングと長文コンテキストを組み合わせた注目の試みです。公式発表や実際の導入事例の公開を楽しみにしつつ、リリース後の実用性を見守りたいところです。あなたの開発体験がどう変わるか、一緒に注目していきましょう。