AIが苦手な人類最後の試験:2026年の検証

AIは古代文字や微細な生体データの解釈など、多分野を横断する『最後の試験』で限界を示しますが、説明可能性と専門家の検証を組み合わせた評価基準を整え、教育・産業・研究が連携すれば、安全で実用的に活用できます。

冒頭に一言

「AIは万能か?」という問いに、最近は少し違う言い方が増えました。 「AIは人類の最後の試験に合格できるか?」です。 今回は、古代文字の解読や微細な生体データの解釈といった具体例を通じて、2026年時点でAIがどこでつまずくのかを見ていきます。

跨領域という壁とは何か

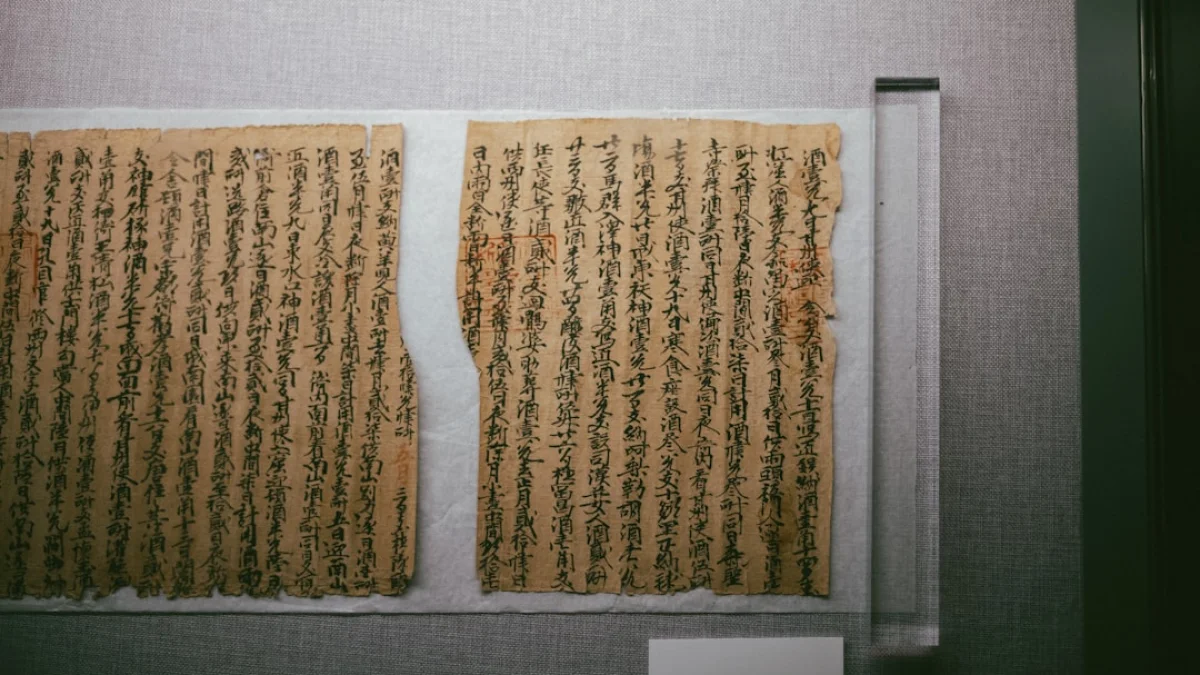

「跨領域(複数分野を横断すること)」という言葉を初めて聞く方へ。 異なる専門知識を同時に使う課題を指します。 たとえば、古代文字を医学的文献の知見で補強して解釈するような場面です。

こうした課題でAIの限界が分かりやすく表れます。 単一分野の大量データで学んだAIは、分野をまたいだ推論に弱いことが多いのです。 イメージとしては、万能ナイフにネジ回しが付いているけれど、細い精密ドライバーは別物、という感じです。

具体例が示す教訓

報道でしばしば取り上げられる事例をいくつか挙げます。 Palmyrene(古代パルミラの)文字の解読、ハチドリの腱のペア数、聖書ヘブライ語の閉音節の同定などです。 閉音節とは子音で終わる音節を指します。

これらは、それぞれ言語学・解剖学・歴史学といった別分野の知識を同時に要求します。 AIが単一データや形式的ルールだけで答えようとすると、根拠が薄くなり誤答につながります。 その結果、出力の裏付けが見えにくくなり、現場で使いづらくなるのです。

現場への影響と現実的な対処

教育現場や企業では、AIの適用判断がより難しくなっています。 過度な期待は禁物ですが、過小評価も避けたいところです。 重要なのは、AIの出力をそのまま信じない運用です。

具体的には、専門家による検証と品質の良いデータの組合せが必要です。 評価指標を明確にし、検証可能な根拠を求める体制を作ることが勧められます。 教育ではAIリテラシー(AIの働きや限界を理解する力)と倫理教育を同時に進めるべきです。

研究と開発の論点:安全性と一般化の両立

今後の研究では、安全性と一般化能力の向上が焦点になります。 一般化能力とは、訓練されていない状況でも正しく振る舞う力です。 これを高めるには、多様な専門家の知見をモデル設計に反映させる必要があります。

また、説明性(AIがどうしてその答えに至ったかを示すこと)と安全性を両立させる工夫も求められます。 透明な評価と段階的な導入が、現場の信頼を築く近道です。

企画と運用で考える落としどころ

現実的な方針は、期待と不安のバランスを取ることです。 AIを万能視せず、しかし補助ツールとして活かす道を探るのが賢明です。

企業や教育機関には次のような実務的提案があります。

- 専門家レビューを必須にする

- 検証可能な評価基準を作る

- 段階的に導入しフィードバックを回す

こうした運用は、技術の進歩と現場のニーズのズレを埋めます。 短期の過信を避けつつ、中長期で実用性を高める戦略です。

最後に:希望と現実のあいだ

AIは確かに強力な道具です。 しかし、万能の神話を鵜呑みにするのは危険です。 跨領域の課題は、専門家同士の協働と評価基準の整備によって、AIの力を安全に引き出せます。

結局のところ鍵は人間側にあります。 AIが苦手な問いを把握し、適切な検証プロセスを組み込めば、技術は期待に応えてくれるはずです。