Zhipu AI が GLM-5.1 を MIT ライセンスで公開、コード生成で OpenAI・Anthropic を上回る

Zhipu AI は4月9日、コード生成に特化した GLM-5.1 をMIT ライセンスで公開。複雑なコーディングタスクで数百回の反復を実行し、自力で戦略を改善。SWE-Bench Pro で 58.4% を達成。

Zhipu AI は4月9日、コード生成モデル「GLM-5.1」を MIT ライセンスで公開した。複雑なコーディングタスクで自律的に戦略を改善し、プログラム合成ベンチマーク SWE-Bench Pro で OpenAI、Anthropic の最新モデルを上回る性能を示している。

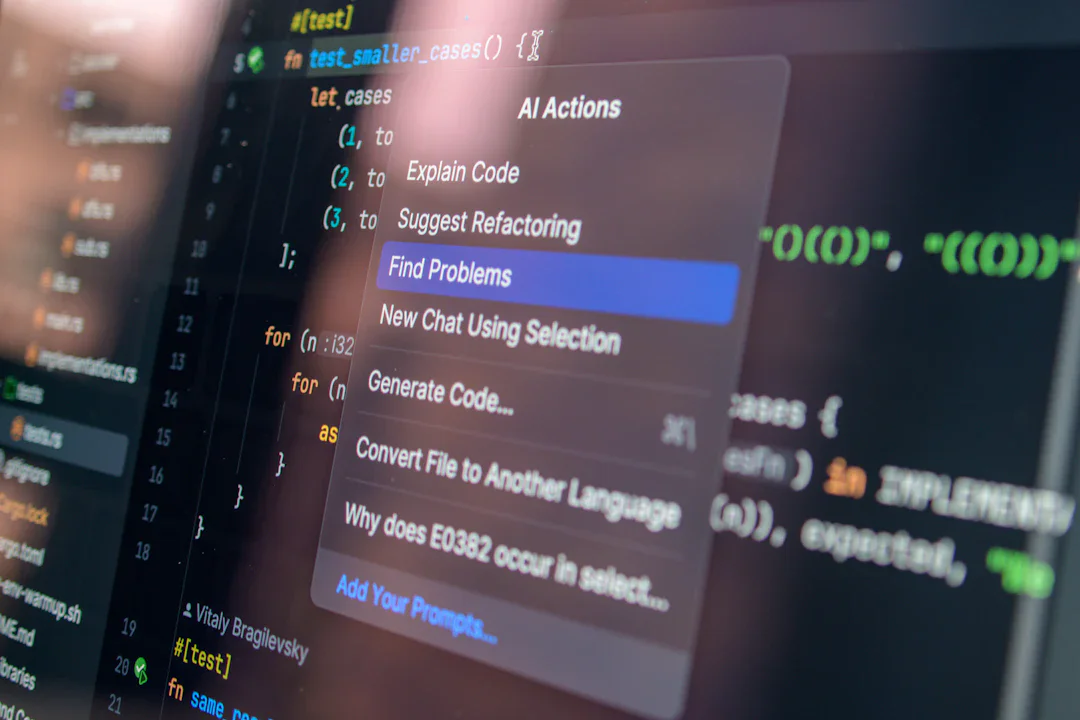

反復型の自己最適化機構

GLM-5.1 の特徴は、長時間にわたるコーディングタスクにおいて、モデルが数百回の反復を通じて自力で戦略を改善することにある。通常、生成 AI モデルは一度選んだ方針から逃げられず、行き止まりに陥ると停止してしまう。これに対し GLM-5.1 は実行中に複数回にわたり根本的に方針を切り替え、問題解決に向かう。

ベンチマーク性能

SWE-Bench Pro の評価では、GLM-5.1 は 58.4% の正解率を達成した。これは OpenAI の GPT-5.4(57.7%)、Anthropic の Claude Opus 4.6(57.3%)を上回り、コード生成分野で中国発モデルが最高水準に到達したことを示している。

ベクタデータベース最適化タスクでは 1 秒あたり 21,500 クエリを処理し、従来ベンチマーク比で約6倍の高速化を実現している。

限界と実用的な制約

一方、一般的な推論タスクでの性能は劣っている。Humanity’s Last Exam などの知識評価で GLM-5.1 は 31% に留まり、Google の Gemini 3.1 Pro の 45% に及ばない。Zhipu AI は開発チームとして「最初の一歩」と位置付けており、数百個の工具操作にわたるタスク一貫性の確保や、行き止まり判別精度の向上が課題として残っていることを明言している。

オープンソース・エコシステム対応

GLM-5.1 は Hugging Face、ModelScope で無料公開される。Claude Code、OpenClaw といったコーディングエージェントに統合され、vLLM、SGLang フレームワークでのデプロイメント対応が進められている。開発者が自前インフラで実行・カスタマイズできる環境が整備されたことで、エンタープライズ導入の門戸が広がった。