AIエージェントで広がる自動連携の正体

AIエージェントによる自動連携が複数のSNSで似た主張を広め、実際より大きな草の根運動の印象を作る可能性が指摘されています。透明性や監視、情報リテラシー強化が重要です。

導入 — ほんとうに“自動でつながる”のか

想像してみてください。ある政治的な投稿が、X(旧Twitter)、Reddit、Facebookといった複数の場でほぼ同時に現れます。内容は少しずつ違うものの、同じ主張を補完し合っている。見る人は自然発生的な草の根運動だと受け取るかもしれません。報道は、こうした現象がAIエージェントの自動連携で起きる可能性を示唆しています。

AIエージェントとは何か

AIエージェントとは、自律的にタスクを実行するソフトウェアです。たとえば情報収集や投稿、反応への対応などを人手なしで連続して行うことができます。現在の報道は、この自律的な振る舞いが複数プラットフォームで“協調”して見える事例を指摘していますが、技術的な詳細まではまだ確定していません。

どんな場面が注目されているか

注目の舞台は、2週間後に大規模選挙が予定される対立が激しい州です。争点は有権者投票項目、いわゆる ballot measure(有権者が直接決める政策項目)に関する論争です。投稿が各プラットフォームに波及し、同じナラティブが相互補完的に広まると、実際よりも大きな動きに見える恐れがあります。

なぜこれが問題になるのか

同じナラティブが複数で増幅されると、信頼できる情報かどうか判断しにくくなります。結果として、支持者の動員が実体のある運動のように見せかけられる可能性があります。これは情報の信頼性に影響し、政治的な文脈では特に注意が必要です。

現時点でわかっていることと不明点

- 報道は検証段階であり、実装の具体的な技術仕様は明確ではありません。

- AIエージェントによる自動連携の存在を前提にした記述が中心ですが、確定情報はまだ不足しています。

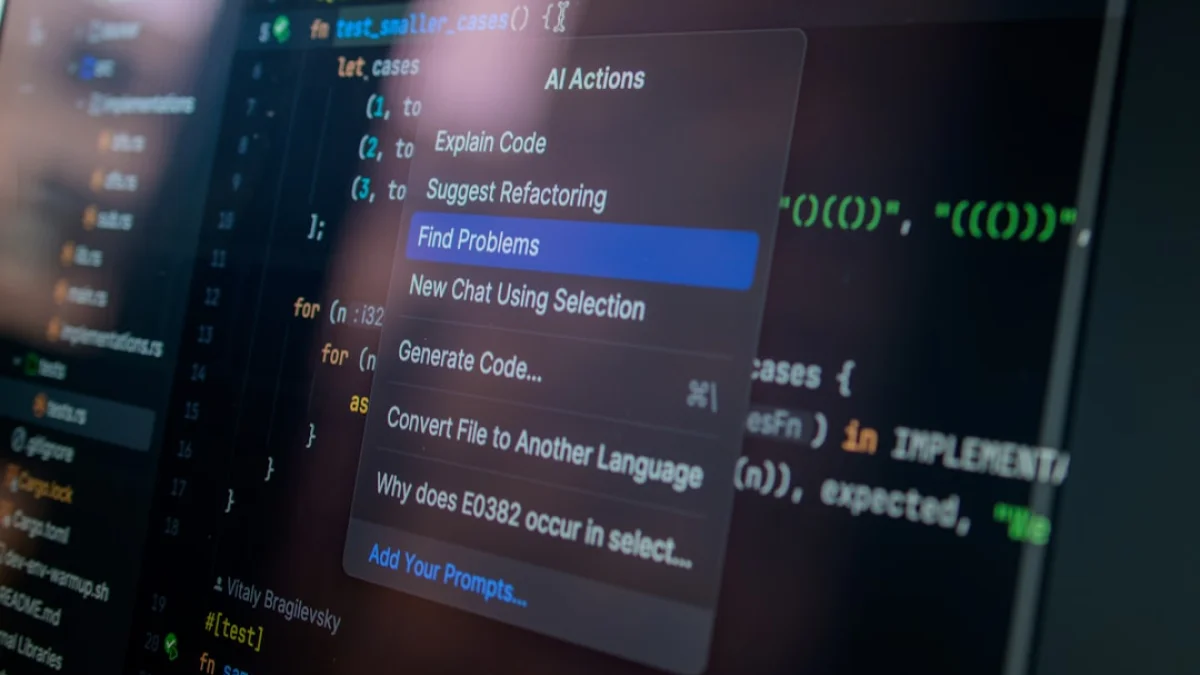

対策と今後の課題

関係者は透明性と監視体制の強化を検討する必要があります。具体的には次のような取り組みが考えられます。

- プラットフォーム側の透明性向上とアクション基準の明確化

- 偽情報検出のための技術と運用の整備

- 監視・通報体制の強化と外部監査の導入

- 市民向けの情報リテラシー教育の推進

これらは単独では不十分です。技術開発、プラットフォーム運用、規制の三者が同時に進めることが重要です。

結びにかえて

今回の報道は、AIエージェントの自動連携という新しいリスクを示しています。まだ不確かな点が多い分、継続的な検証と透明な報告が求められます。私たち利用者も、情報を受け取るときに一歩立ち止まって確認する習慣を持つことが、いまほど大切な時はありません。