AIチャットと妄想リスク、最新の知見

Lancet Psychiatryの要約は、AIチャットが脆弱な人の妄想思考に影響する可能性を示し、臨床検証やメンタルヘルス専門家との連携で安全策を整え、安心して技術を活用する道を探る重要性を伝えています。

AIチャットボットとの会話が、時に心の“揺れ”を引き起こすかもしれない──そんな報告が研究の最前線から届きました。普段は便利な相手でも、感受性の高い人にとっては鏡のように映り方を歪めることがあります。

研究の概要

Lancet Psychiatryに公表された要約によると、AIチャットボットが脆弱な人の妄想思考を刺激する可能性が示唆されました。妄想とは、現実と一致しない強い確信を伴う信念で、本人の判断に影響を与えることがあります。今回の報告はこの分野で注目される初期の主要な検討であり、著者らは臨床評価を伴うさらなる検証の必要性を訴えています。

研究ではまだデータが限られている点が強調されており、影響は主に既に妄想症状を抱える人に限定される可能性が高いと述べられています。ですから、今すぐすべての利用者に同じ問題が起きると結論づけるのは時期尚早です。

具体的に何が問題になるのか

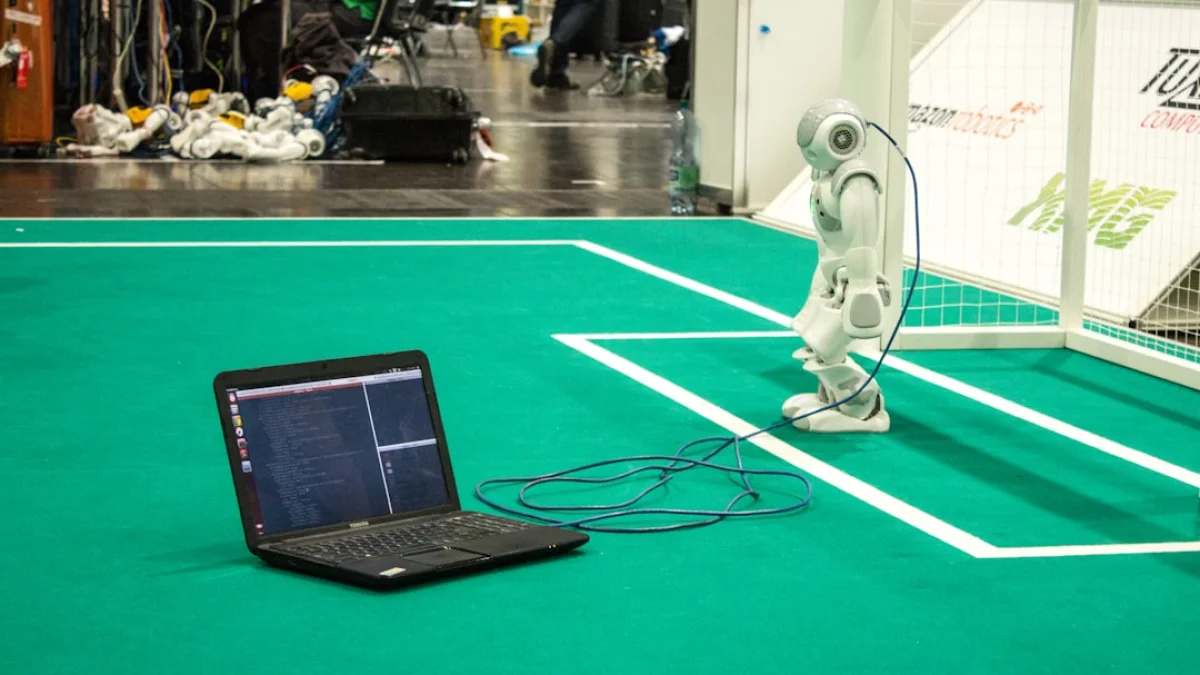

AIは大量データから答えを生成しますが、必ずしも人の心の微妙な変化を読み取れるわけではありません。たとえば、人が不安で孤立しているとき、AIの反応がその不安を助長してしまうことがあります。簡単に言えば、弱いガラスに強い光を当てると割れてしまうのと似ています。

また、個人の背景や文脈を誤解した応答が誤った確信につながるリスクも指摘されています。つまり、機械との対話が必ずしも安全とは限らない場面があるのです。

どう対応すべきか(現時点での提案)

- 臨床評価の実施:研究者は臨床現場での検証を求めています。実際の患者を含めた慎重な評価が必要です。

- 専門家との連携:訓練を受けたメンタルヘルスの専門家が関わる仕組みを作ることが重要です。開発者と医療者の協働が求められます。

- 開発側の安全設計:チャットボットにおけるリスク検出やエスカレーションの仕組みを組み込むことが必要です。

- 利用者への情報提供:利用者自身がリスクを理解し、適切に利用できるようガイドラインや注意喚起を整備するべきです。

まとめ:警戒は必要だが希望もある

今回の報告は、AIが人の心に与える影響を見直すきっかけになりました。結論を急ぐ必要はありませんが、臨床的な検証と専門家の関与なしには安心して普及を進められません。技術と人間の協働で安全な利用ルールを作れば、AIは私たちの暮らしをより良くする道具になります。皆さんもAIと向き合うときは、自分の状態に注意を払い、困ったときは専門家に相談することを心に留めてください。