Der Spiegel報道で問われるAI画像検証

Der Spiegelがイラン報道でAI生成の可能性がある画像を削除した事例を受け、The Decoderの指摘を踏まえつつ検証基準や出典明示の整備が今後の信頼回復に重要になると伝えます。

AI生成画像が突きつけた検証の壁

ニュースの写真が本物かどうかを信じる時代に、思わぬ亀裂が入りました。AI生成画像とは、人工知能が新たに作ったり大きく改変したりした画像のことです。最近、Der Spiegelはイラン報道に掲載された複数の画像を削除しました。その理由は、AIによる生成または大幅な改変の可能性が高いと判断したためです。

削除の判断には、調査報道メディアThe Decoderの指摘が影響しています。The Decoderの取材を踏まえ、Der Spiegelは該当画像の信頼性に疑いがあると説明しました。ただし、記事内では「可能性が高い」といった表現が残り、具体的な検証手順の詳細までは示されていません。

ここで見えてきたのは、検証の難しさと透明性の重要性です。新聞やウェブの記事はレンズで世界を切り取るようなものです。もしそのレンズに偽のフィルターが付いていたら、見える風景は変わってしまいます。読者としては、どの情報にどんな手順で信頼を置けばよいのかを知りたいはずです。

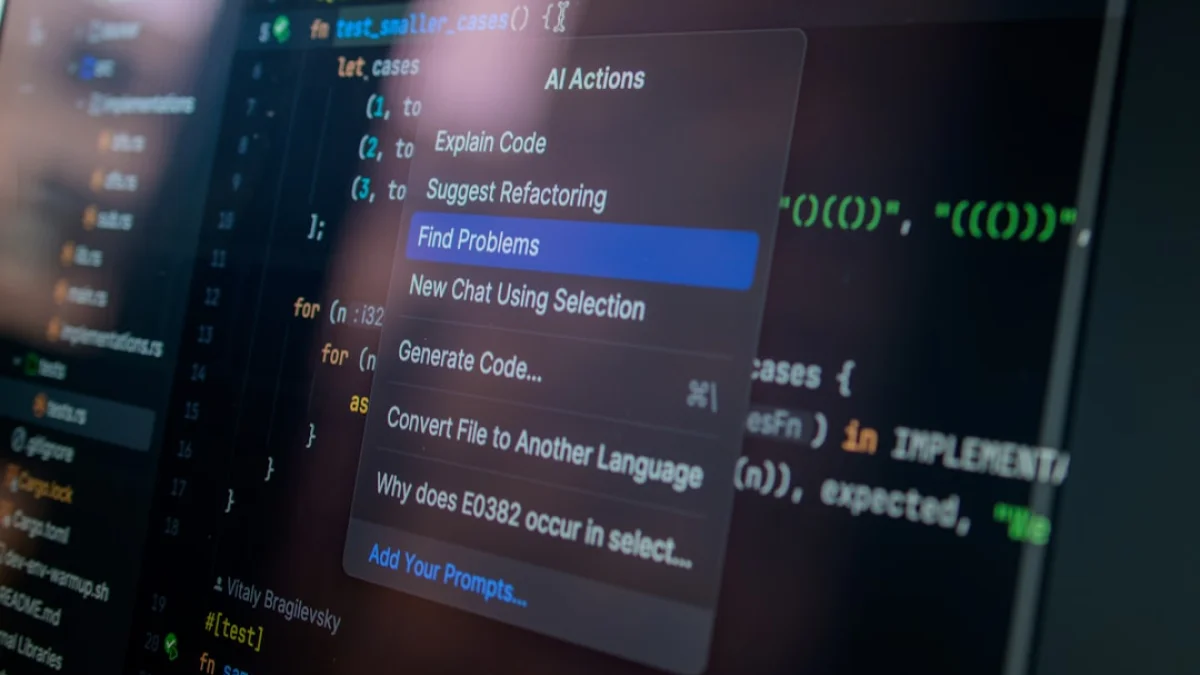

では、何が求められるのでしょうか。まずは検証ルールの整備です。メタデータの確認や逆画像検索、AI生成検出ツールの併用など、具体的な手順が必要です。次に出典明示の徹底です。どの取材やツールを根拠に判断したのかを明示すれば、読者の理解は深まります。最後に、検証の透明性を確保するための社内体制の強化です。外部監査や第三者レビューの導入も有効でしょう。

実務の整備には時間がかかります。ですが、透明性が高まれば読者の信頼回復につながります。誤情報対策や説明責任の強化にも寄与するはずです。今回の事例は、報道機関にとって検証実務を見直すきっかけになりました。

読者としてできることもあります。画像や情報を見たときは出典を確認してください。疑わしい点があれば、同じ事柄を別の信頼できる媒体でも確認してみてください。小さな習慣が、情報の健全性を支える大きな力になります。

今回の出来事は終わりではなく、始まりです。Der Spiegelの対応は、検証と透明性をめぐる議論を前に進めました。今後は具体的な検証手順と出典の明示が、ニュースの信頼を守る柱になるでしょう。