2027年を境に迫るAIの現実と対策

AnthropicのDario Amodei氏の予測を手がかりに、2027年以降のAIが現場でどう使えるかを調査やMETR研究を交えて整理し、透明性重視の検証・リスク管理と実務で使える人とAIの協働モデルを提案します。

イントロ:節目としての2027年

「AIがすぐに人を超えるかもしれない」——こうした専門家の発言は、期待と不安を同時に呼び起こします。AnthropicのDario Amodei氏の見通しは象徴的です。とはいえ、現場の実感は必ずしも一致していません。この記事では、そのギャップを見える化し、現場が取るべき具体的な対策を整理します。

専門家の予測と現場のギャップ

Amodei氏は、2027年直後にAIが多くの場面で人間を上回る可能性を指摘しました。こうした予測は技術進化の速さを示しますが、現実の業務では別の顔が見えます。

ここで用いるLLMとは、大規模言語モデル(Large Language Model)の略です。文章生成や要約を得意とするAIの一種です。現場の報告では、LLMは誤情報を出す「幻覚(hallucination)」や、長期計画・抽象的推論が不得意な点が課題として挙がっています。ある調査では、リモートのフリーランス案件などで期待通りの成果が出ないケースが目立ちました。

現場で起きていること:リモート案件の実例

リモートの仕事でありがちな例を一つ挙げます。AIに記事作成を任せたら、事実誤認が混ざった草稿が上がり、修正に人手がかかった──という話です。期待値は高いのに、実際はチェックに時間が取られる。これが導入初期に多く見られる課題です。

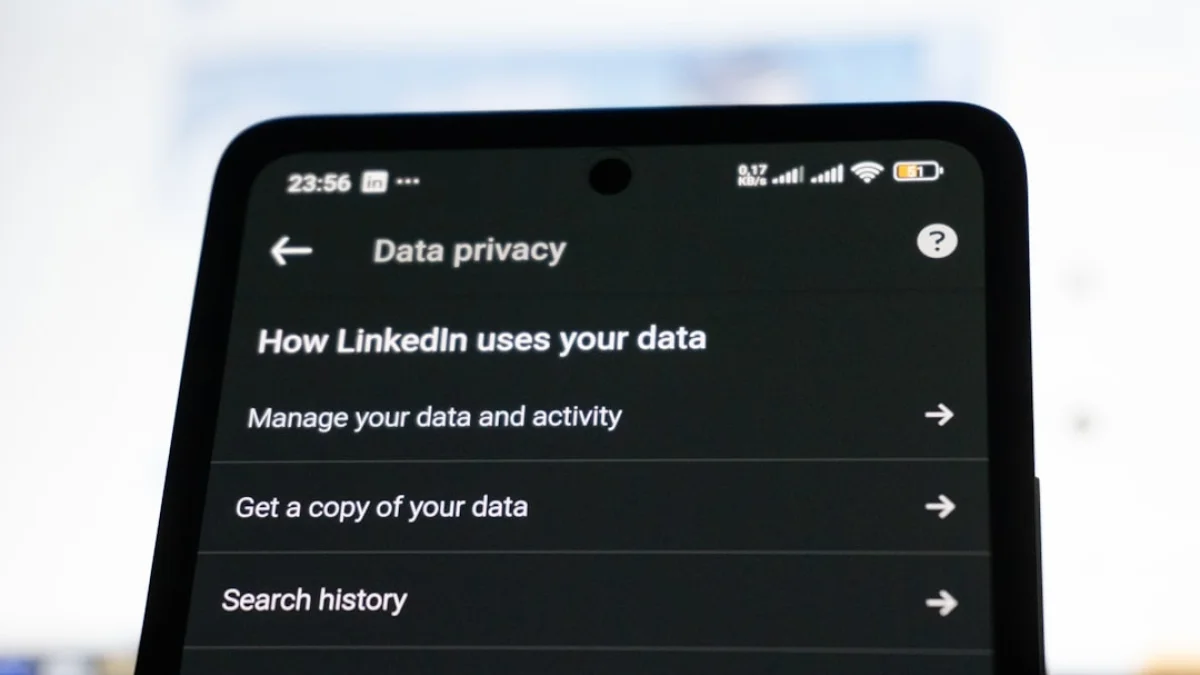

こうした問題は、単に精度の話だけではありません。説明可能性や責任の所在が不明瞭だと、ビジネスの判断は保守的になります。つまり、技術の成長速度と業務での活用可能性にはズレが存在します。

METR研究が示す兆候と経済への影響

METR研究などは、LLMの能力が短期間で大きく伸びる可能性を示唆しています。研究では「ほとんど成功しない時期」から「ほぼ常に成功する時期」へと移る可能性が指摘されました。これは、まるで薄氷が突然割れて氷上に出るような変化に似ています。

もしこれが現実になれば、労働市場の構造は急速に変わります。新しいスキル習得が求められ、教育や職業訓練の仕組みも見直されるでしょう。ただし、変化の速度と影響範囲には不確実性があり、準備の早さが大きな差を生みます。

現実的な行動指針

- 小さく試す。いきなり全面導入せず、限定的なプロジェクトで検証を重ねてください。

- 評価基準を明確にする。成功・失敗の指標を数値化し、定期的に見直しましょう。

- 説明可能性を重視する。幻覚や誤出力への対処フローを整備してください。

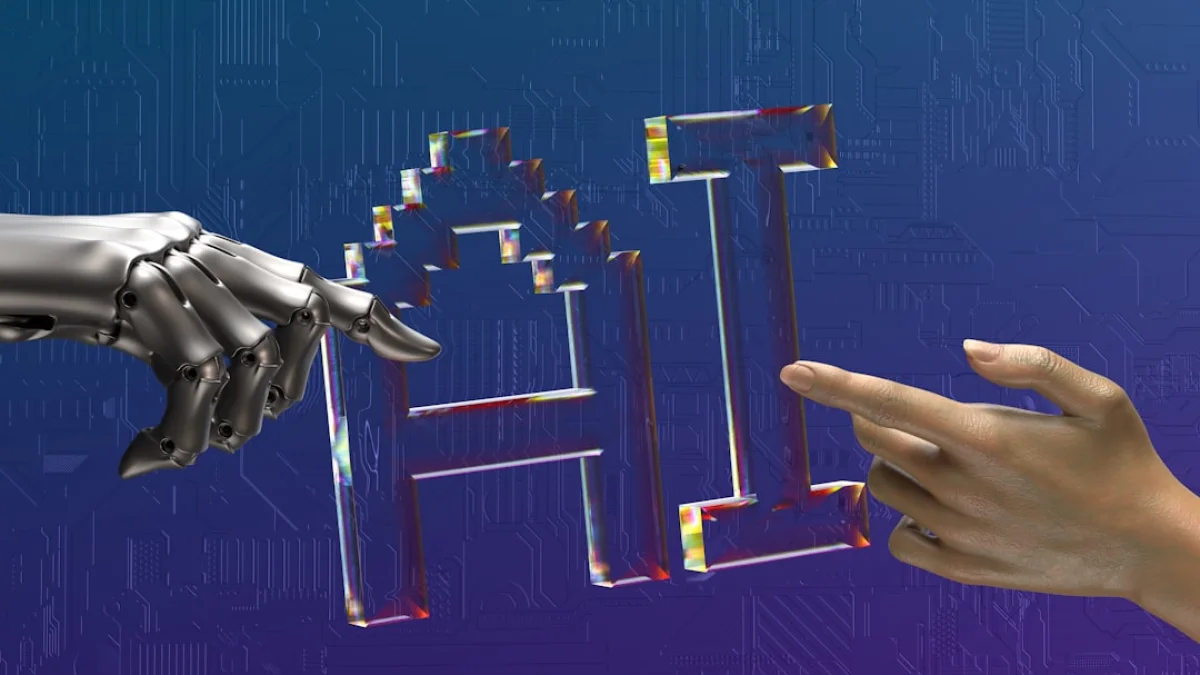

- 人とAIの協働設計を進める。AIは補助ツールと割り切り、最終判断は人が担う体制を作る。教育現場では、AIを道具として使いこなすスキル教育を早めに導入することが重要です。

まとめ:楽観と慎重のバランスを

技術の進化は確かに速まっています。ですが、現場で使えるかどうかは別の問題です。過度な楽観も過度な悲観も避け、検証可能な小さな実装を積み重ねていくことが現実的です。

透明性のある評価と責任ある運用、そして人とAIが互いの強みを活かす協働モデルの構築こそが、2027年以降の不確実な時代を生き抜く鍵になります。今日できることは、まず試して学び、改善を繰り返すことです。少しずつでも前に進めば、変化は味方になります。