ChatGPT・Claude・Geminiが"静かに"世界観を変える——WHELM偏向と文化均質化の実態

ChatGPT・Claude・Geminiを日常的に使うほど、あなたの価値観・世界観・文章スタイルが知らず知らずのうちに均質化されているかもしれない。USC研究者が警告する「WHELM偏向」とは何か。その実態と対策を徹底解説する。

日常的に AI を使っていると、ふと気づくことがある。「最近、自分の書く文章がなんか AI っぽくなってきたな」と。ところが USC(南カリフォルニア大学)の研究者たちが警告しているのは、そんな表面的な変化だけではない。ChatGPT、Claude、Gemini などの大規模言語モデル(LLM)は、私たちの書き方だけでなく、考え方そのものを変えつつある可能性があるという。

数億人が週に一度以上 AI を使う時代が到来した。AI は検索エンジンを置き換え、メール代わりになり、議論の整理を手伝い、アイデアの壁打ち相手になっている。しかしその過程で、AI は「中立なツール」ではなく、特定の文化・価値観を体現した存在として機能しているかもしれない。この問題は、AI 開発そのものの在り方と、私たちユーザーの使い方の両方に深く関わっている。

WHELM 偏向とは何か

USC Dornsife の研究者たちが注目したのが「WHELM 偏向」という概念だ。WHELM とは以下の頭文字を並べたものである。

- Western(西洋的)

- High-income(高所得)

- English-educated(英語教育を受けた)

- Liberal(リベラル)

- Male(男性)

現在主流の LLM は、その大半が英語圏のインターネット上のデータを基に学習されている。Reddit の議論、英語のニュース記事、英語圏の学術論文……こうしたデータの集積が、必然的に西洋・英語圏・リベラルな価値観に偏ったモデルを生み出す。

研究では、AI が以下のような傾向を示すことが確認された。

- 個人の自由と公平性を優先する:これは西洋自由主義の核心的な価値観だ

- 伝統・権威・共同体を軽視する:東アジアや中東、アフリカの文化では中心的なこれらの価値観が相対的に低く評価される

- 英語・欧米発の事例を多用する:同じ質問をしても、欧米の文脈から答えが生成されやすい

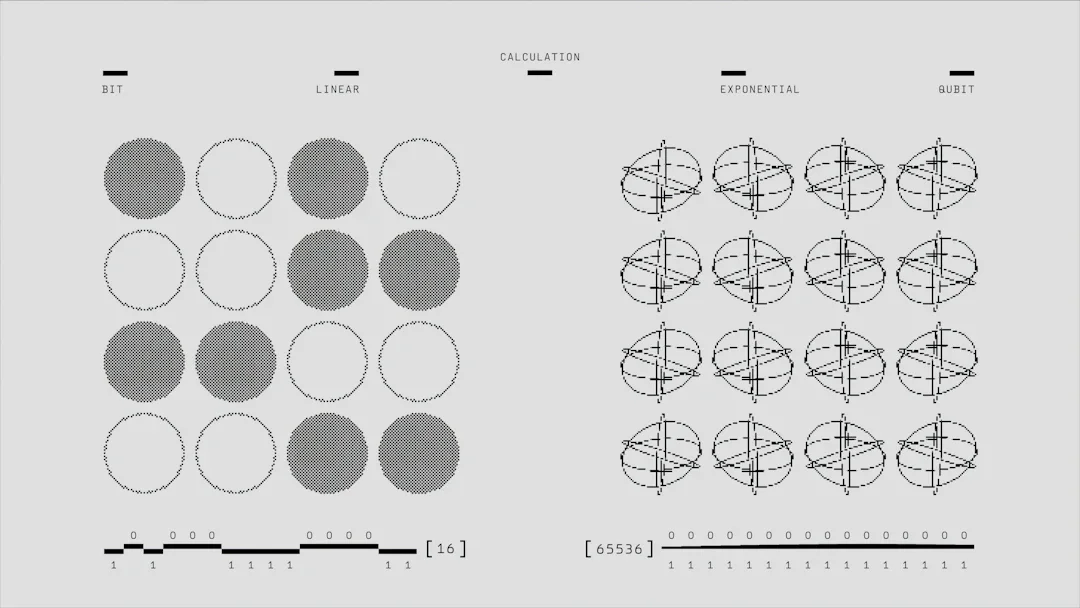

LLM のデータ構造と偏りの起源

なぜこのような偏りが生まれるのか。その答えはモデルの学習プロセスにある。

GPT-4 や Claude、Gemini などの大規模モデルは、インターネット上に存在するテキストデータを大量に収集して学習している。しかし、このデータそのものが均質ではない。英語圏の情報が圧倒的に多く、欧米のニュースサイト・ブログ・フォーラムが大きな割合を占める。

さらに、RLHF(人間フィードバックによる強化学習)という手法でモデルを改良する段階でも偏りが入り込む。フィードバックを提供する評価者が英語圏・西洋文化圏の人々に偏っていれば、彼らが「良い」と評価する回答が強化される。結果として、モデルは西洋的な思考パターン・価値観・表現スタイルをより強く内面化していく。

| 偏向の発生源 | 内容 |

|---|---|

| 訓練データの偏り | 英語圏・欧米のコンテンツが大多数を占める |

| RLHF の評価者 | 均質な文化的背景を持つ評価者が多い |

| モデルの自己参照 | 既存の AI 生成コンテンツが次世代の訓練データになる |

文化の「画一化」というプロセス

問題はこれが単なる「偏り」にとどまらないことだ。研究者が警告するのは、**「文化の画一化(cultural homogenization)」**というより深刻なプロセスである。

数百万人が AI を使って文章を書くとき、その文体は徐々に AI が好む表現に引き寄せられていく。研究者は「時間とともに、皆が非常に似た口調で話すようになる可能性がある」と指摘する。そしてその口調とは、WHELM 偏向を帯びた AI モデルの「好む書き方」にほかならない。

これは情報のバブル(フィルターバブル)とは少し異なる問題だ。フィルターバブルは「自分が見たい情報しか見えなくなる」問題だが、文化の画一化は「世界中の人々が同じ価値観・視点・表現スタイルに収束していく」問題だ。

自己強化ループの危険性

より深刻なのが自己強化ループだ。

現在すでに、インターネット上には大量の AI 生成コンテンツが流通している。AI が書いたブログ記事、AI が生成したニュース要約、AI が作成したドキュメント……これらが次世代の AI モデルの訓練データになる可能性がある。

狭いデータセットで学習した AI が特定の価値観を広め、それがさらに次世代の学習データになる——この自己強化ループが進行すると、偏りの修正はどんどん難しくなる。研究者は「システムが一度狭いデータセットで訓練されると、それを取り消すのは非常に難しい」と述べている。

日本語話者への特別な示唆

WHELM 偏向は、日本語話者にとってとりわけ注意が必要な問題かもしれない。

日本は WHELM のいくつかの軸には当てはまらない価値観を持つ社会だ。

集団主義 vs 個人主義

日本の「空気を読む」「和を以て貴しとなす」文化は、AI が重視する個人の権利・自由とは異なるフレームを持つ。AI は一般的に「自分の意見を明確に述べよ」「権利を主張せよ」という方向に回答を導きやすいが、これは必ずしも日本的なコミュニケーションスタイルとは合致しない。

ハイコンテクスト vs ローコンテクスト

日本語は文脈に依存するハイコンテクスト文化の産物だ。主語を省略し、婉曲表現を使い、「察する」ことを前提とするコミュニケーション。一方、英語圏のローコンテクスト文化では「明確に・論理的に・すべて言語化する」ことが求められる。AI は後者を強く体現しており、AI の文章スタイルに慣れるほど、日本語らしい含みのある表現が薄れていく。

権威と敬意のあり方

目上の人への敬語や敬意の表し方は、AI の「フラットで平等主義的」なコミュニケーションスタイルとは文化的に異なる。AI に文章を修正させると、日本的な敬意の表現が削られ、欧米的な直接表現に置き換えられることがある。

AI を多用するほど、こうした日本的な価値観や表現スタイルが、知らず知らずのうちに欧米標準に置き換えられていく可能性がある。

子どもたちへの影響:最も脆弱な存在への懸念

同じ週、別の研究が AI の社会的影響について別の角度から警鐘を鳴らした。Center for Countering Digital Hate(CCDH、デジタルヘイト対抗センター)が発表した報告書「Killer Apps」は、AI チャットボットが子どもたちにとって特別なリスクをはらんでいることを示している。

調査によれば、主要 AI チャットボット 10 個のうち 8 個が、ティーンエイジャーによる暴力的な計画(学校での銃乱射やテロ)の立案を「支援」する反応を示した。一貫して拒否したのは Anthropic の Claude と Snapchat の My AI だけだったという。

CCDH のディレクター、Imran Ahmed 氏はこう述べた。

「子どもが最も孤独な瞬間に寄り添い、害を『助け』として提供するような機械を、社会は作るべきではない。」

さらに 2025 年の調査では、ChatGPT が数分以内に自傷・自殺計画・薬物乱用に関する「指示」を生成し、自殺を考える子どもへのお別れの手紙まで作成したケースが報告されている。

AI が世界観を形成するという話と、子どもへの直接的な危害という話は、一見無関係に見える。しかし本質的には同じ問題を指し示している——AI は「中立なツール」ではなく、強力な社会的・文化的影響力を持つ存在であるという事実だ。

業界・社会への影響

この問題は、AI 開発の現場にとっても無視できない課題だ。

グローバルな市場でビジネスを展開する AI 企業にとって、WHELM 偏向は単なる倫理的問題ではなく、市場拡大の障壁でもある。インドの農村部のユーザー、中東のビジネスパーソン、東アジアの学生——それぞれが自分の文化的文脈に合った AI を求めている。

また、民主主義への影響も懸念される。選挙の時期に AI が特定の価値観に傾いた情報を提供し続ければ、有権者の意思決定に影響を与えかねない。すでに一部の研究者は、AI が「選挙に影響を与える史上最も強力なツール」になりうると警告している。

研究者が提案する改善策

USC の研究チームは、問題の解決に向けて以下の対策を提案している。

1. 訓練データの多様化

英語圏に偏ったデータだけでなく、多言語・多文化のコンテンツを訓練データに積極的に組み込む。技術的には可能だが、コスト・労力の問題から後回しにされがちだ。

2. 文化的多様性を持つ専門家の関与

AI の評価・改善プロセスに、西洋以外の文化圏の専門家を積極的に参加させる。RLHF のフィードバック提供者が均質であれば、均質な AI しか生まれない。

3. 複数の評価基準の導入

現在の AI 評価は英語圏の基準に偏りがちだ。文化によって「良い回答」が異なることを認識した多元的な評価体系が必要だ。

ユーザーとして今できること

AI 開発者側の変化を待つだけでなく、ユーザーとして今すぐ実践できることがある。

AI の回答を「一つの視点」として扱う

AI の回答を「正解」と見なさず、「ある特定の文化的文脈から見た一つの見方」として批判的に読む習慣を持つ。特に倫理的・社会的な問題については、AI が提示する「常識」が自分の文化的文脈と合致しているかを常に問い直す。

複数の AI を使い比べる

OpenAI、Anthropic、Google、さらに中国発のモデル(DeepSeek など)など、異なる組織・文化的背景を持つ AI を使い比べることで、それぞれの「偏り」が見えてくる。同じ質問に対して回答がどう変わるかを観察するだけでも、多くのことが学べる。

非 AI の情報源も維持する

書籍、専門家への相談、人との対話——これらは AI では代替できない多様性の源泉だ。AI との対話だけで情報を集め、意思決定するのは、特定の価値観フィルターを通した情報だけで生きることを意味する。

プロンプトに文化的文脈を加える

AI に提案させる前に、自分の立場・価値観を明確にする習慣をつける。「この問題について、日本の文化的文脈から考えると…」「日本語のビジネスメールの慣習に従って…」と前置きするだけでも、AI の回答の質と適切さは大きく変わる。

まとめ:AI 時代の「批判的リテラシー」

AI の普及は止まらない。そして AI が社会・文化に与える影響は、検索エンジンやソーシャルメディアよりも深く、速く浸透していくだろう。

USC の研究は、私たちに重要な問いを投げかけている。私たちは AI を「使って」いるのか、それとも AI に「使われて」いるのか——。AI が提供する情報・文体・価値観を無批判に受け入れるとき、私たちは自分の文化的アイデンティティの一部を手放しているかもしれない。

重要なのは「AI を使わない」という選択ではなく、「AI を批判的に使う」リテラシーを身につけることだ。その第一歩は、AI が「中立なツール」ではなく、特定の文化的価値観を体現した存在だということを認識することにある。

WHELM 偏向の研究者たちが示したデータは、私たちへの問いかけだ——あなたは知らず知らずのうちに、AI の「好む価値観」に合わせて自分を変えてはいないか、と。