AnthropicとOpenAIが挑む米軍契約の岐路

AnthropicはDoD契約で大量監視回避と完全自動武器の人間監督を条件とし距離を置き、OpenAIは政府案件で存在感を高めています。今後は透明性と民主的統制が鍵になります。

米国でAI企業と国防総省(DoD)の間に新たな緊張が生まれています。話は単なる入札争いではありません。倫理と安全保障がぶつかる、政策の分岐点なのです。

Anthropicの拒否が投げかけた問い

AnthropicはDoDとの契約を受ける際、二つの条件を掲げて受注を見送ったと報じられています。第一は「米国内でのmass surveillance(大量監視)を行わないこと」。ここでいう大量監視とは、多数の市民や公共空間を網羅的に監視・解析することを指します。第二は「完全自動武器は人間の監督下でのみ運用すること」。完全自動武器とは、人の介入なしに敵を選別して攻撃するシステムです。

この一歩引いた姿勢は、技術の活用範囲と社会的合意の境界を突きつけます。Anthropicの創業者の一人、Dario Amodeiの要求は、企業がどこまで軍事利用に踏み込むかという難しい判断を象徴しています。

OpenAIと政府契約の潮流

一方でOpenAIは政府機関向けの提供を強化する方向に動いています。報道では機密政府システムへの適用拡大が検討されているとされ、企業ごとに政府協力の温度差が浮き彫りになっています。ある報道では、トランプ前大統領がAnthropicのモデル利用停止を指示したという情報も伝えられましたが、これらは現時点では断定できない点にご留意ください。

企業によって倫理の線引きが異なることは、政府側の調達方針にも影響を及ぼします。どのラインを政府が受け入れるかで、今後の契約設計が変わってくるでしょう。

監視と自動兵器、どこに線を引くか

この議論は抽象論ではなく、民主的統制や透明性の問題に直結します。防衛関係者は安全性や実務性を重視しますが、企業や市民は人権や監督の確保を求めます。Pete Hegseth元防衛長官がAnthropicの条件を「woke(過度な配慮)」と評したと伝えられるように、社会的合意は一枚岩ではありません。

比喩を使えば、AIの軍事利用は橋を渡るようなものです。橋を丈夫にするには設計(ルール)と点検(透明性)が必要です。設計だけでなく、渡る人々の信頼も欠かせません。

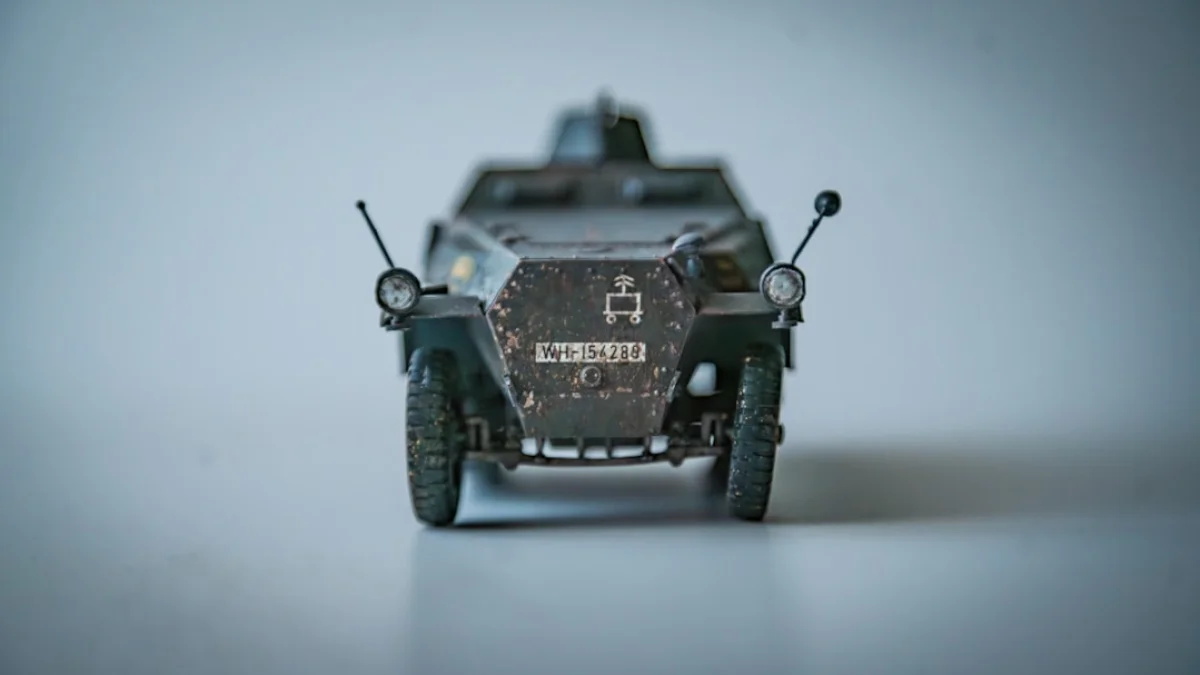

ドローン競技が示す技術競争の現場

DoDが主催したドローンスワーム(群制御)競技では、Anthropicは自社モデルClaudeで挑んだと報じられますが、契約はSpaceX/xAIとOpenAIと連携する防衛企業が獲得したと伝えられています。入札の勝者は、技術力だけでなく政府との関係性や実運用の信頼性も重視された結果と見られます。

この結果は、企業連携と政府の調達方針がどのように交差するかを示す良い例です。倫理規範と実務上の要求がどのように折り合いをつけるかが、今後の焦点になります。

今後の見通しと読者への問いかけ

現状を総合すると、Anthropicは条件付きで距離を置き、OpenAIは政府分野での存在感を強めつつあると読み取れます。重要なのは、倫理ポリシーと国家安全保障の必要性をどのように両立させるかです。

読者の皆様にはこう問いかけたいです。技術の力を軍事分野で使う際、どの線引きを優先すべきでしょうか。透明性と民主的統制を高めつつ、安全を確保するための“実践的な落としどころ”は何か。これからの政策と企業の選択をぜひ一緒に見守ってください。