深偽ポルノ対策の現在地と法のジレンマ

深偽(ディープフェイク)映像の急拡大に対し、米英豪の事例を整理し、法の適用範囲やプラットフォーム責任の明確化、透明性と迅速対応、国際協力の重要性をわかりやすく提言します。

深偽映像とは何か、いま何が問題か

深偽映像(ディープフェイク)は、AIを使って人物の顔や声を別人に置き換える技術です。簡単に言えば、映像の“なりすまし”です。最近では性被害や誤情報に使われる例が増え、ニュースやSNSで問題視されています。

本稿では、米英豪の事例を手がかりに、法と技術のズレを読み解きます。最後に現場で使える提言を示します。難しい話を噛み砕いて、読みやすくまとめました。

米国:Take It Down Actを軸に進むが限界も

Take It Down Actは、非同意の性的画像を対象にした法案です。違反行為が明確な場合には対処が期待できます。ですが、プラットフォーム全体の責任を直接問うのは難しいとの指摘が多いです。

なぜか。技術の進化が速く、現場での運用が追いつかないためです。法律は個別の違反に強くても、サービス設計や配信の仕組みまで踏み込むと裁判での判断が割れます。結果として、取り締まりの「穴」が残るのです。

具体的には、違法投稿を削除する手順や通報の流れが不十分なプラットフォームでは、被害者保護が後手に回ります。技術対策と法運用の両輪が揃わなければ実効性は出ません。

英国:OfcomとXの攻防が示す規制の力学

Ofcomは英国の通信規制当局です。Online Safety Act(オンライン安全法)は、プラットフォームに対策を求める枠組みです。OfcomはX(旧Twitter)をめぐる調査で、法の適用を強く試そうとしています。

注目点は、サービスの一部機能を有料化する動きです。政府は、AIチャットボットやプレミアム機能を有料層に限定する施策を警戒しています。これは、技術の利用と公共ルールの衝突を象徴します。

Ofcomの動きは強硬ですが、結論や所要期間は未定です。ここでの裁定は他国にも波及する可能性があります。規制の厳しさとプラットフォームのビジネスモデルのバランスが問われています。

豪州Bondi事件が示す誤情報の広がり方

豪州ではBondiの事件を契機に、ガーディアンの水印を模した深偽動画が拡散しました。会見をベースに作られ、虚偽の逮捕情報を伝える内容でした。

ファクトチェッカーが偽情報と断定しても、動画は数十万回再生されました。これは、正しい情報が拡散する速度よりも、誤情報が早く広がる現実を表しています。深偽生成はますます簡単になっており、対処の難度が上がっています。

個人への影響と社会的リスク

深偽ポルノは、特に女性や子どもを標的にします。非合意のビキニショットなどが大量に出回る事例も報告されています。被害は名誉や安全に直結します。

また、誤情報や名誉毀損のリスクも高まります。動画ひとつで人の人生が揺らぐ可能性があるのです。だからこそ、ファクトチェックの強化と利用者の情報リテラシー向上が不可欠です。

規制と現場運用の間で必要なこと

今後求められるのは三つの視点です。

- 法の明確化: 個別の違反とプラットフォーム責任を分ける法整備。

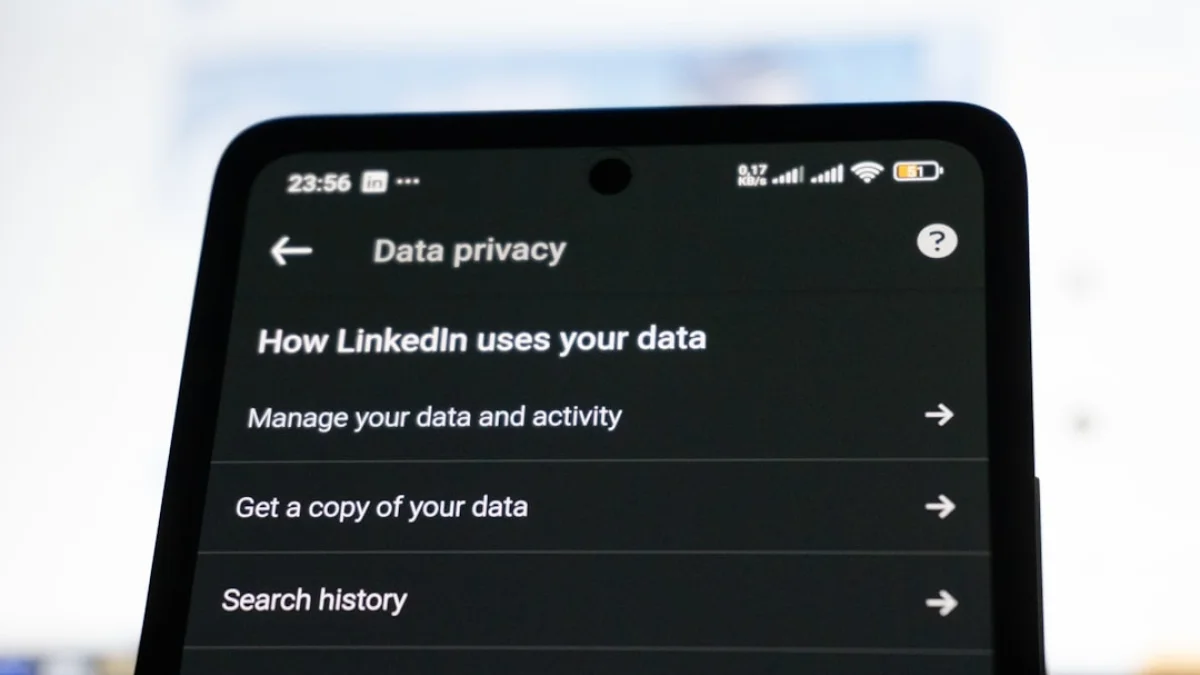

- 透明性の確保: 対応状況や削除基準を公開すること。

- 国際協力: 技術は国境を越えるため、各国で足並みを揃える必要があります。

さらに、プラットフォーム側には迅速な通報対応と技術的な検出力の強化が期待されます。これらが揃って初めて、被害を最小化できます。

まとめと提言

深偽映像は、今や“水たまりに広がる油”のように社会に広がっています。すぐに完全な防御はできません。だからこそ、段階的な対策が重要です。

短期的には、削除手続きの迅速化とファクトチェック体制の強化を進めてください。中長期的には、法制度の明確化と国際協調が鍵になります。

読者の皆様へ。情報を受け取る際は出所を確認してください。疑わしければ拡散を控え、信頼できる機関の確認をお勧めします。小さな注意が、大きな被害を防ぎます。