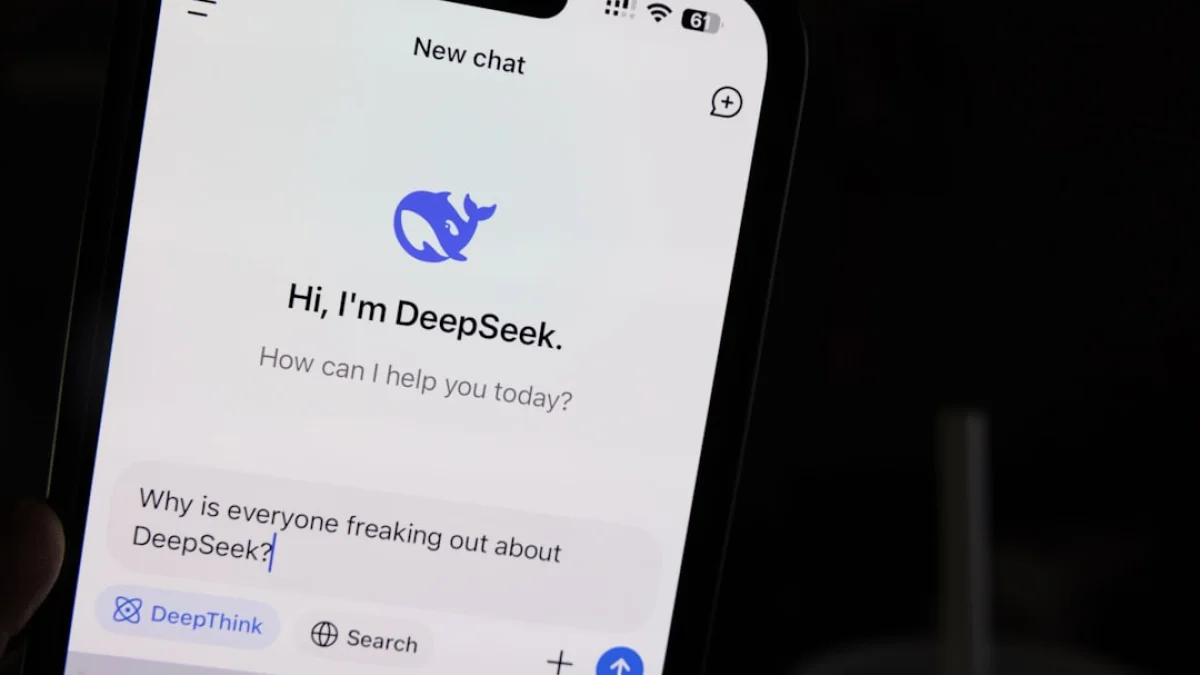

1日100回の動画通話が暴く最新AI顔詐欺の現実

WIREDの取材で確認されたTelegram上の「AI顔モデル」募集は、動画通話で顔をデータ化し詐欺に利用される可能性を示しており、非公式求人に応じず個人情報を守ることが大切です

導入

スマホに1日100回も動画通話がかかってくる光景を想像してください。

そんな極端な数ではなくとも、日常のやり取りが入り口になる時代です。WIREDの取材で明らかになったのは、Telegram上に広がる「AI顔モデル」募集という新しい動きでした。表向きは“モデル募集”でも、裏で詐欺に使われる恐れがあると報じられています。

Telegramの募集の実態

複数のTelegramチャンネルで同じ文言の募集が確認されました。募集内容は「AIの顔モデルになってほしい」というものです。短時間の動画通話を重ねて顔のデータを集める手口です。チャネル間で求人が共有され、情報が広く拡散していました。まるで求人の“ネットワーク”が勝手に広がるような状況です。

誰がターゲットになるのか

報告では応募者の多くが女性だとされています。必ずしもすべてが被害に使われるとは限りませんが、顔データを得た後の用途が問題になります。動画通話の依頼や個人情報の提示が発生したら警戒してください。知らない相手との通話で個人情報を渡す必要はありません。

なぜこの手口が厄介なのか

人の顔は信頼の“近道”です。画面越しの表情は安心感を与えます。そこを利用して信頼を築き、詐欺につなげる可能性があります。AIが高精度に顔を合成できる今、実際の顔をデータとして取り込む意図は軽視できません。想像してみてください。目の前の笑顔がコピーされ、別の悪用に回るかもしれないのです。

具体的な対策と注意点

まず、非公式な求人には返信しないことが基本です。短時間の動画通話で顔を撮られると困る場面が増えます。通話を求められたときは相手の出所を確かめてください。Telegramのような公開チャネルでの募集は特に注意が必要です。

個人でできる簡単な対策

- 不審な求人はスクリーンショットを保存して家族や友人に相談してください。

- 本人確認が曖昧な相手と動画通話をしないでください。

- 個人情報や銀行情報は絶対に渡さないでください。

プラットフォームと社会の対応

今回の報道は、プラットフォーム側の監視強化と利用者教育の重要性を浮き彫りにしました。Telegramのようなサービスではモデレーションの限界があります。運営側と利用者の双方で注意を高める仕組み作りが求められます。

まとめ

AI技術の進化は便利さをもたらしますが、同時に新たなリスクも生みます。WIREDの取材が示すように、顔を扱う募集は注意が必要です。非公式な求人には慎重に対応し、個人情報は厳重に守ってください。疑わしい依頼に対しては一呼吸置く習慣が、いま最も有効な防御になります。