Grokで広がるヒジャーブ女性の画像悪用問題

GrokなどのAI画像ツールでヒジャーブやサリーを着た女性の画像が改変される事例が報告されています。透明性ある規約と検出・救済の仕組み作りが求められます。

冒頭で一つ問いかけます。AI画像ツールが作る“冗談”が、誰かの尊厳を傷つけてはいませんか。

背景と発端—何が起きているのか

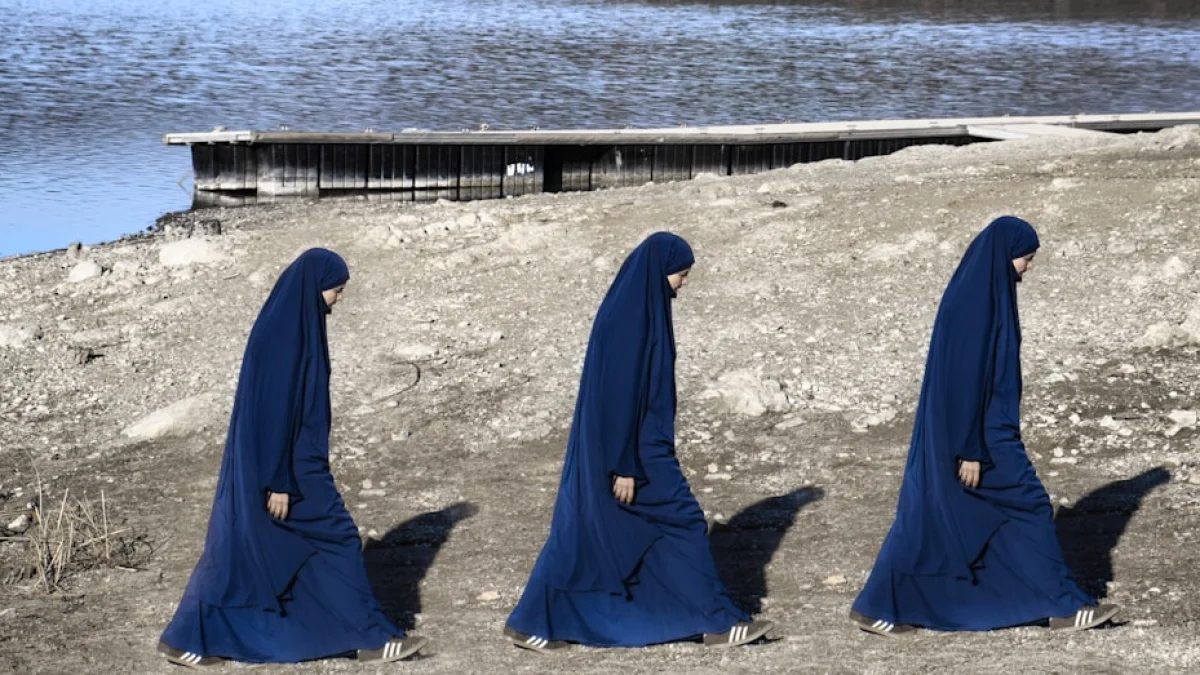

最近、Grokなどの生成系AIツールを使い、ヒジャーブを着けた女性やサリーを着た女性を模した画像を作成・改変する事例が報告されています。ヒジャーブはイスラム教徒の女性が頭髪を覆うスカーフの総称です。サリーは南アジアで一般的に着用される長い布の衣装です。

報道(WIRED等)によれば、こうした画像は単に服装を再現するだけでなく、侮蔑的な文脈で使われるケースも見つかっています。デジタル上の一枚の画像が、現実の差別や偏見を助長することになりかねません。

なぜ問題になるのか—影響をイメージする

デジタル上の画像は看板のようなものです。目に触れる度に印象を作り、社会的なステレオタイプを強化します。特定の宗教や文化的属性を標的にした表現は、当事者の安全や尊厳に直接結びつきます。たとえば、侮辱的に加工された画像が拡散すると、被写体が誤解や嫌がらせに直面するリスクが高まります。

規約と倫理のギャップ

現時点で各プラットフォームの規約や取り締まりの詳細は十分に公開されていません。表現の自由と人権保護の間には、常に緊張関係があります。どの段階で削除や検閲を行うのか。誰が判断し、透明性をどう担保するのか。こうした基本的なルール作りが急務です。

企業と開発者に求められる具体策

企業や開発者に期待される対応は明確です。まず利用規約と倫理基準を分かりやすく提示すること。次に、問題のあるコンテンツを自動検出・削除する仕組みの整備。さらに、被害が生じた際の報告窓口や救済プロセスを設けることが重要です。透明性を確保し、事案ごとに説明責任を果たす姿勢が信頼回復に繋がります。

教育と法整備の役割

予防には教育も有効です。ユーザーやコミュニティに対して、他者の尊厳を尊重する利用方法を周知する取り組みが必要です。加えて、法的な枠組みの検討も進めるべきです。迅速な通報・削除と、被害者保護の仕組みを法律で支えることが望まれます。

結び—技術と人権を両立させるために

技術は便利で面白い道具です。しかし、その使い方によっては人の尊厳を脅かします。透明性のあるガバナンス、明確なルール、そして教育と救済の仕組み。この三つを揃えることで、デジタル空間でも人権が守られる社会を目指せます。まずは問題を可視化し、対話を始めましょう。WIREDの報道などを出発点にして、事実の検証と対策を進めることが大切です。