Meta、Google TPU巨額レンタルでNVIDIAに挑む

MetaがGoogleのTPUを数十億ドル規模でレンタルしたと報じられ、NVIDIA依存の分散や訓練コスト最適化を狙う動きが注目されています。今後の契約条件次第で市場は大きく動きます。

MetaがGoogleのTPUを巨額でレンタルする契約を結んだと報じられました。契約規模は数十億ドル級と伝えられています。期間や詳細は非公表ですが、この一手はAIインフラの地図を塗り替える可能性があります。

TPUって何ですか?

TPUはTensor Processing Unitの略で、Googleが開発したAI専用の演算アクセラレータです。GPUに比べて特定の機械学習処理で効率が良いことが多く、大規模なモデル訓練で重宝されます。

なぜ今、TPUを借りるのか

AIモデルの訓練需要が急増しています。必要な計算資源は電力やデータセンターと同じく、確保しておきたい“インフラ”です。多くの企業は一つの供給先に頼らない方針を強めており、MetaもNVIDIA依存を分散しようとしていると見られます。

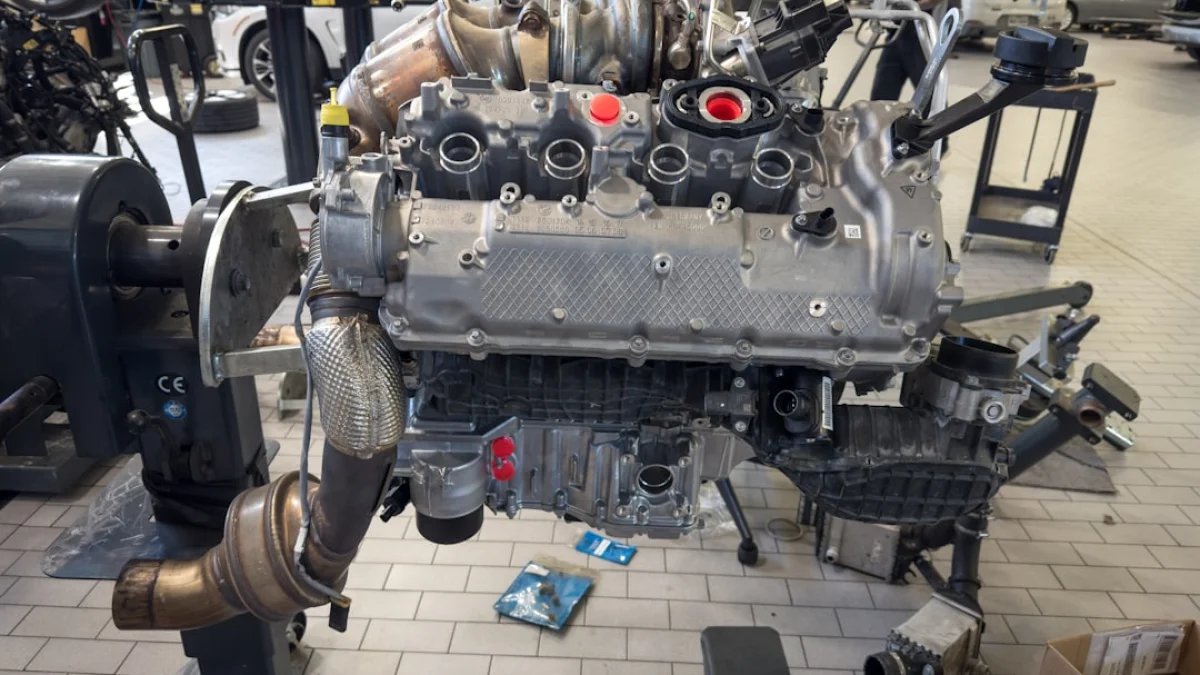

具体的には、TPUを借りることで訓練コストの最適化や処理パフォーマンスの改善を狙えます。車で例えれば、レンタカーで違うエンジン性能を試すようなものです。自前の車(自社データセンター)を持ちながら、外部の車種を使って性能を確かめるというイメージです。

NVIDIA優位へのリアルな挑戦

現在はNVIDIAのGPUがAIチップ市場をリードしています。MetaのTPU活用はその優位性に風穴を開ける試みです。短期的にはシェアに大きな変化があるかは不透明ですが、選択肢が増えること自体が業界にとって重要です。

気になるのはコストや供給契約の条件です。レンタル期間や価格、供給の安定性がどうなるかで、効果の大きさは変わります。

投資家や開発者に及ぶ波紋

投資家はリスクと機会を再評価するでしょう。クラウド事業者は資源調達の見直しを迫られます。開発者には訓練環境の選択肢が増えるメリットがあります。たとえば、大規模モデルを運用するチームはコスト構造を見直す好機になります。

今後のポイント

注目すべきは契約の実行規模と期間です。追加のレンタルや他社との提携が出てくれば、市場の勢力図はさらに動きます。読者の皆さんは、供給源の多様化が生む機会とコストを冷静に見極めてください。

Metaの動きは単なるベンダー切り替えではありません。AIインフラを巡る競争が、より多様で柔軟なフェーズに入ったサインです。今後も小さな一手が業界の地図を変えていくのを、一緒に追いかけていきましょう。