MITが挑む画像からロボ計画を作るAI

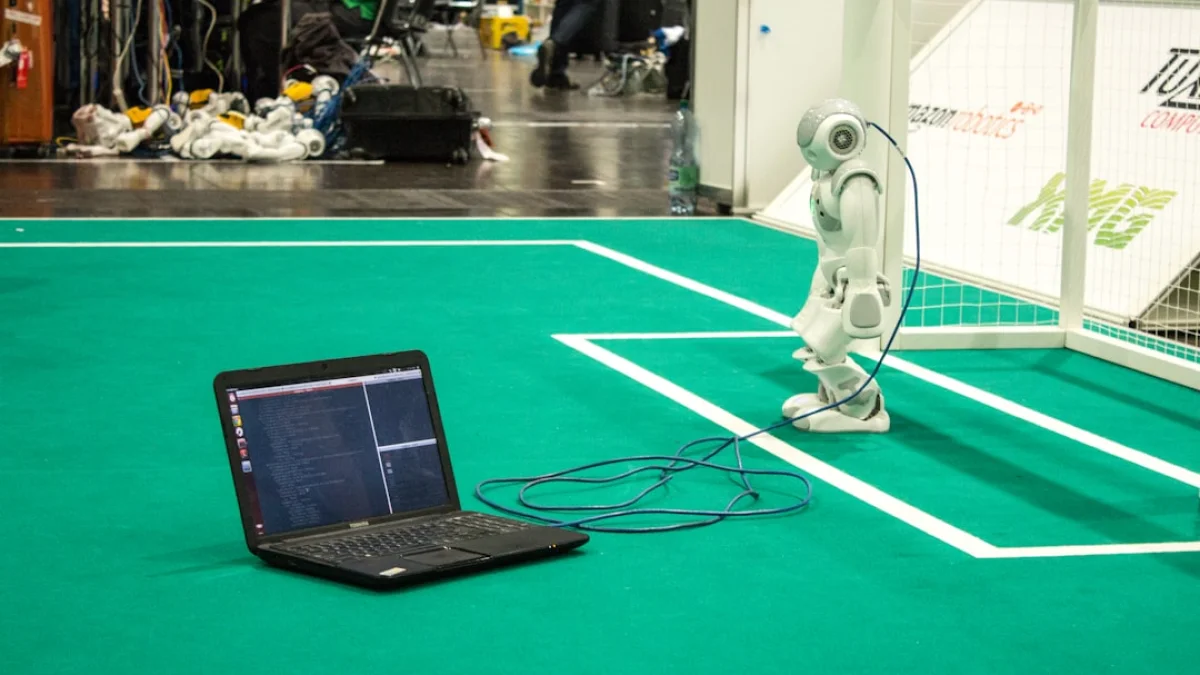

MITの新AIプランナーは視覚言語モデルで画像を理解し行動候補を生成、別モデルがそれをプログラム言語に翻訳して実行可能な計画に仕上げる技術で、報告では従来法の約2倍の効果が示されており、デモ公開が期待されています。

注目の新技術

MITの研究チームが、画像から長期的な行動計画を作る新しい生成型AIを発表しました。視覚言語モデル(画像を理解してテキストで表現するAI)を使い、場面把握から実行可能な計画作成までを目指すアプローチです。報告では従来技術の約2倍の効果が示されたとされ、研究コミュニティの期待を集めています。

仕組みをざっくり説明すると

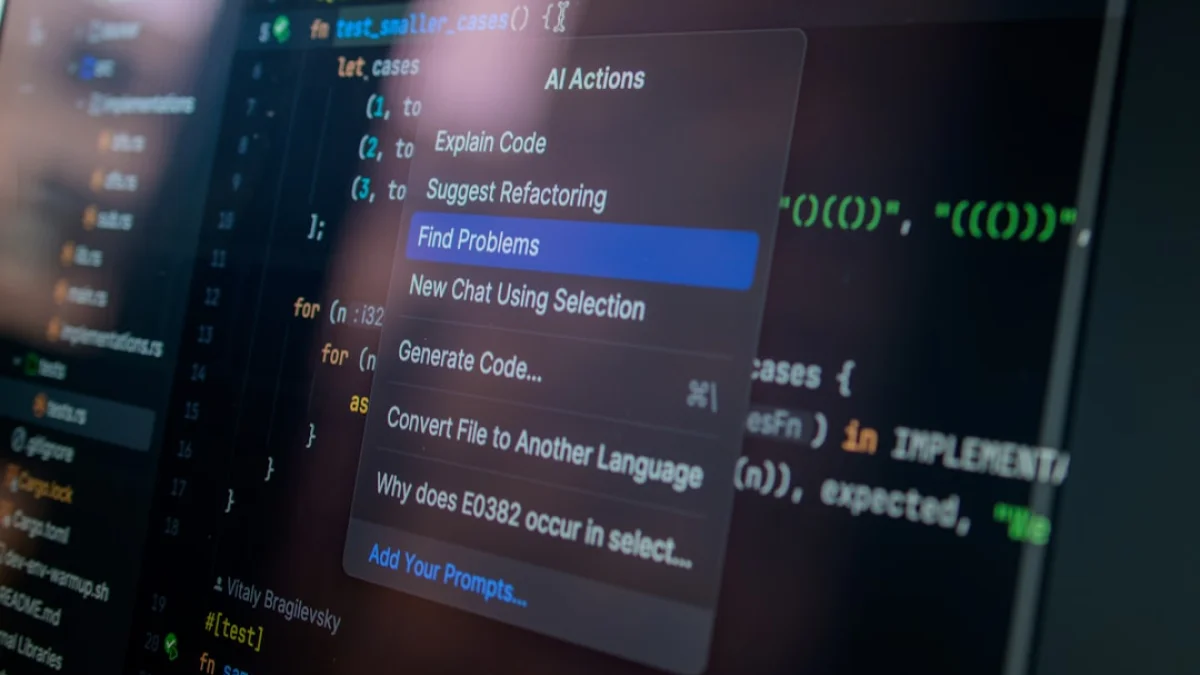

まず視覚言語モデルが場面を読み取り、目標達成に必要な行動候補を生成します。視覚言語モデルは、風景や物体の配置を“読む”役割です。次に別のモデルが、それらの行動候補を標準的なプログラミング言語に翻訳します。翻訳された内容は、計画問題として整理・洗練され、実行可能な手順へと磨かれていきます。まるで地図を読み、道順を書き起こす翻訳者と案内人が協力するような流れです。

なぜ面白いのか

画像から直接、実行可能な計画につなげる工程を短縮できる点が魅力です。従来は視覚認識と計画立案が別々の工程で行われることが多く、連携コストが発生していました。今回の方式はその断点をつなぎ、場面理解と行動設計を自然な一連の流れにまとめようとしています。

期待と現実的な課題

とはいえ、現時点での実用性は未確定です。報告された効果は有望ですが、信頼性の検証や計算資源の要件、リアルタイム性の確保など、現場導入に向けた課題が残ります。具体的な適用事例や制約の詳細は未公開で、デモや追加論文の公開が待たれる状況です。

どんな場面に役立ちそうか

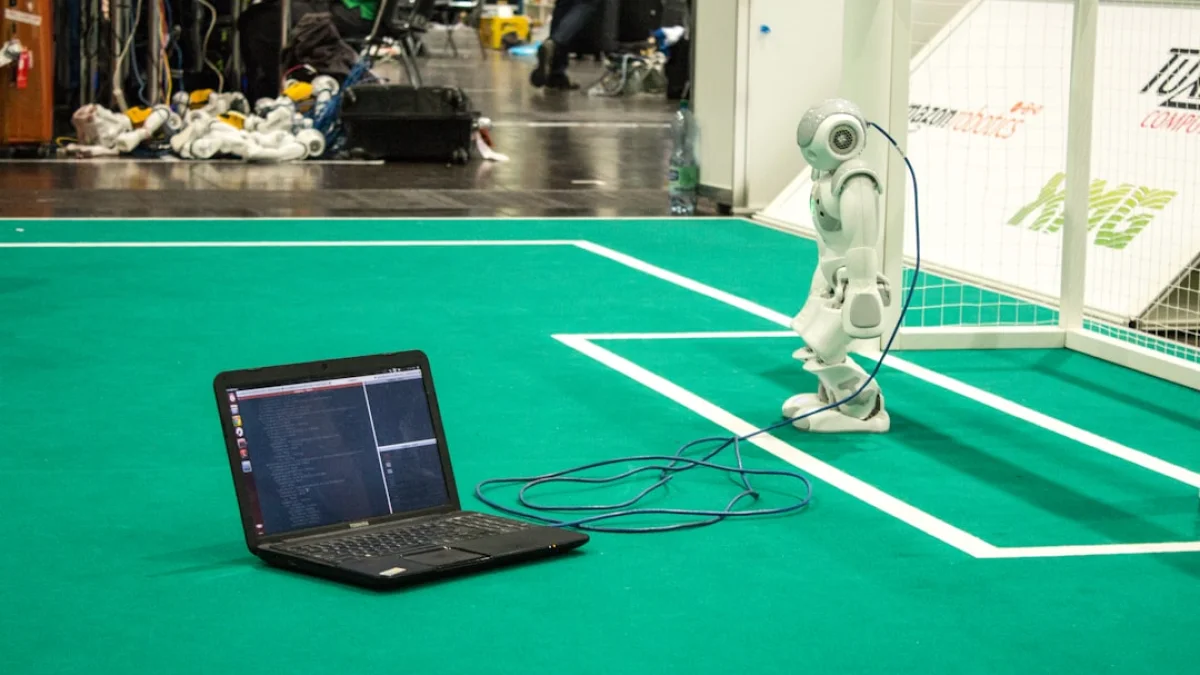

想像できる応用例は多彩です。倉庫でのピッキングや工場での組み立て、家庭用ロボットの長期タスク管理など、視覚情報を基にした複雑な行動計画が必要な領域で力を発揮しそうです。ただし、安全性や計算負荷をどう回避するかが鍵になります。

最後に一言

MITの提案は、長期視覚タスクの計画を支える新たな潮流の萌芽です。今後、論文の詳細やデモ映像が公開されれば、より現実的な評価ができるでしょう。興味がある方は、公開情報の更新を楽しみにしていてください。