LLMにベイズ的推論を教える新提案が示す可能性

Google Researchが提案する手法は、LLMにベイズ的な確率更新を学ばせて推論の透明性と不確実性の扱いを改善し、政策や企業判断にも活かせる可能性があり、詳細は原論文で確認する価値があります。

導入

AIの“考え方”をもう少し人間寄りに見せられたら、どんなに安心できるでしょうか。Google Researchが公開した「Teaching LLMs to reason like Bayesians」は、そんな期待を刺激する提案です。ここでは、提案の要点と実務への影響をわかりやすく紹介します。

ベイズ的推論とは何か

ベイズ的推論とは、既に持っている仮説や知識に対して、新しい証拠を受け取りつつ確率を更新していく考え方です。たとえば天気予報を毎日更新するように、情報が増えるほど判断を柔軟に変えるイメージです。

提案のポイント

この研究は、LLMにベイズ的な「確率更新」の仕方を学ばせる試みです。狙いは二つあります。まずは推論の透明性を高めること。次に、不確実性の扱いを明確にすることです。実験では、モデルに証拠ごとの重み付けや確率的な回答の出し方を教える工夫が示されました。

分かりやすい例を挙げると、AIがある判断を下すときに「どれくらい確信しているか」を数値的に示すような振る舞いを目指しています。これは、単に答えを出すだけのAIよりも説明力が高まります。

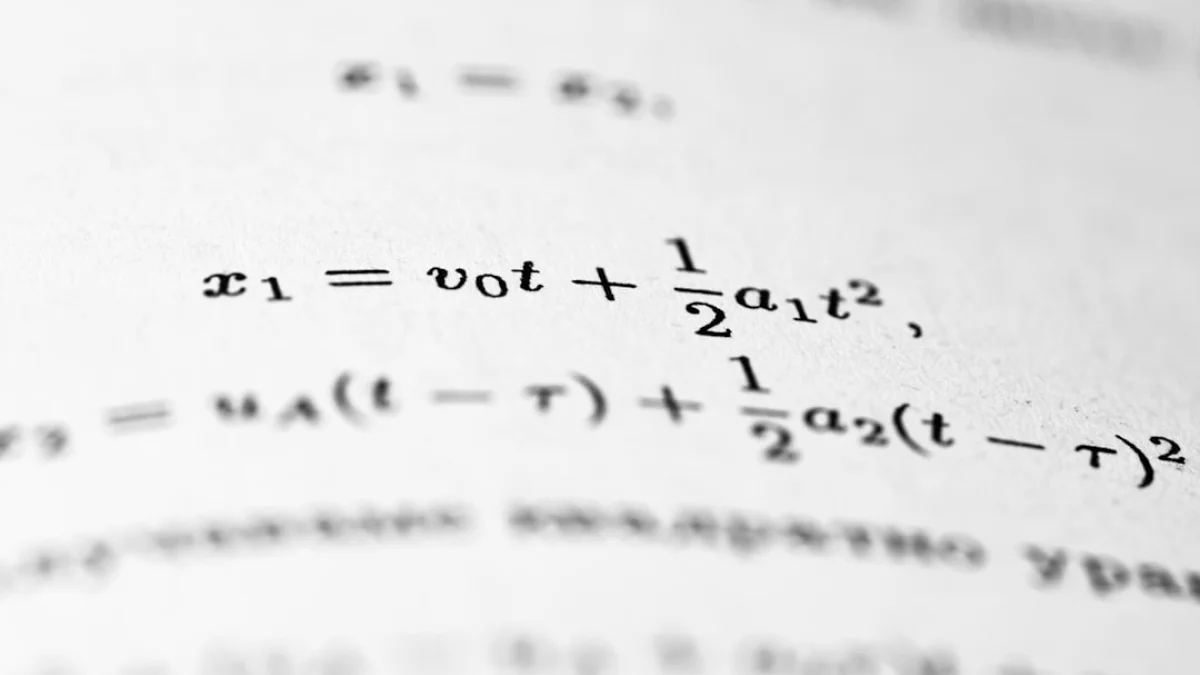

注意点と限界

重要なのは、模倣するだけでは厳密なベイズ推論にはならない点です。LLMはもともと確率分布を学習していますが、理論的に正しいベイズ更新を常に再現できるわけではありません。データ前処理や評価設計の工夫が不可欠です。

また、実務導入の初期段階ではコストや実装の難しさも現実的な障壁になります。推論の透明性を上げる設計が評価や監査の手間を増やす場合もあります。

誰に影響するか

この取り組みは、研究者やモデル設計者に直接的な示唆を与えます。推論の設計や評価指標の見直しが促されるでしょう。企業の意思決定者にとっては、AIの出力をどう信頼し運用するかを再考するきっかけになります。

実務でのポイント

短期的には、推論の信頼性と評価の透明性をどのように担保するかが最大の課題です。長期的には、不確実性を明示できるAIは、リスク管理や説明責任の点で価値を発揮します。具体的な方法論は今後の研究と実装事例の蓄積が鍵になります。

まとめ

Google Researchの提案は、LLMの“考え方”をより明示的にする挑戦です。ベイズ的な確率更新を取り入れることで、推論の透明性や不確実性の扱いが改善される期待があります。とはいえ、真のベイズ推論の再現や実務適用には技術的な検討が必要です。興味があれば原論文に目を通すことをおすすめします。