OpenAIの新オムニモデル、BiDi音源の真相

OpenAIの新オムニモデルと噂のBiDi音源について、流出情報や従業員投稿を整理し、現状の信頼性や影響範囲を分かりやすく解説しました。公式発表を基準に注目ポイントをチェックする姿勢を提案します。

ざわつく噂、何が起きているのか

OpenAIの“新オムニモデル”の噂が業界を賑わせています。公式発表はまだですが、従業員の投稿や流出とされる音源が話題を呼んでいます。噂は興味深い一方で、鵜呑みにはできません。まずは現状を整理しましょう。

現状まとめ:どんな情報が出ている?

複数の報道が、OpenAI関係者の投稿とされる断片を紹介しています。合わせて話題になっているのが「BiDi」と呼ばれる音声プロジェクトの流出です。The Decoderの記事で取り上げられたことがきっかけで広まりました。

ただし、現時点でOpenAIからの公式発表は確認されていません。情報には推測や断片が混ざっている可能性があります。

BiDiとは何か(簡潔に)

BiDiは、報道で「音声プロジェクト」として言及されている名称です。ここでは双方向的な音声処理や合成を想定したプロジェクトと説明されることが多く、音声の生成や理解を両方向で扱う技術を示す可能性があります。

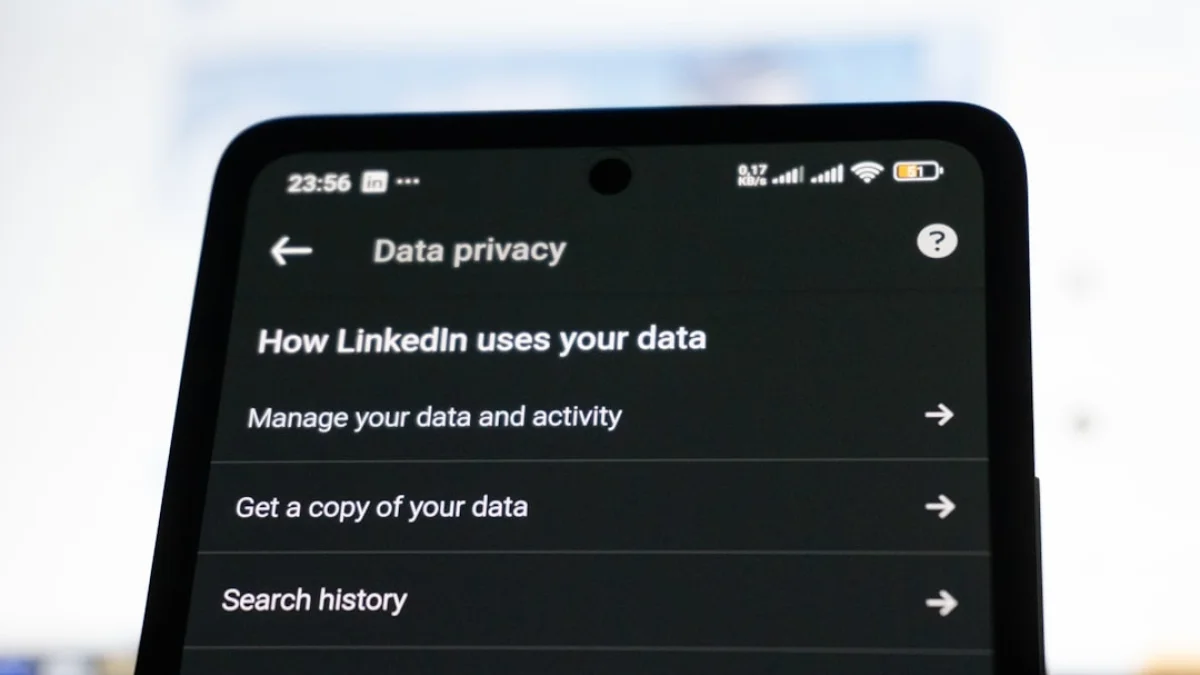

流出情報の意味と限界

流出とされる音声や従業員投稿は手がかりになりますが、断片的です。真偽が不確かな情報で全体像を描くのは危険です。例えるなら、完成前のパズルの端だけを見て絵柄を断定するようなものです。

情報源の信頼性を検証し、公式発表を基準にして判断することが重要です。

誰が影響を受けるのか

こうした動きは研究者や企業だけでなく、現場のエンジニアや一般ユーザーにも波及します。例えば、音声アシスタントやコンテンツ制作の現場では、音声処理の進化が直結して影響を与え得ます。影響範囲は広く、利害関係者は多岐にわたります。

今後の見方とチェックポイント

まずは公式発表を待つのが基本です。同時に、以下の点をチェックすると情報を整理しやすくなります。

- 情報源の出所(社外か社内か)

- 公開された音源やデータの完全性

- 技術仕様や対応するモーダル(音声・画像・テキスト等)

- 実運用での安全性や倫理面の配慮

発表があれば、これらの点を中心に一次情報で確かめてください。

おわりに:期待と慎重さのバランスを

噂はワクワクします。ですが、真実を見極める力も大切です。公式情報が出るまで待ちつつ、技術の可能性に胸を膨らませる。そうした姿勢が、冷静で健全な期待の持ち方だと思います。今後の発表を一緒に追いましょう。