OpenAIのSparse Circuitsが拓くAI透明性

OpenAIが提示した「Sparse Circuits」はモデル内部を“回路図”のように可視化して透明性向上を狙う試みですが、効果検証と詳細公開が不可欠であり今後の論文や再現実験に注目すべきです

AIの“回路図”が読めたら、私たちの信頼はどう変わるでしょうか。OpenAIが提示した「Sparse Circuits」は、まさにその可能性を探る試みです。本稿では、何が示され、何が期待できるかを平易に整理します。

まずは要点をひと言で

OpenAIのSparse Circuitsは、ニューラルネットワークの内部推論を限られた経路(回路)に絞って可視化しようというアプローチです。目的は透明性と安全性の向上です。

Sparse Circuitsとは何か(初出の用語説明)

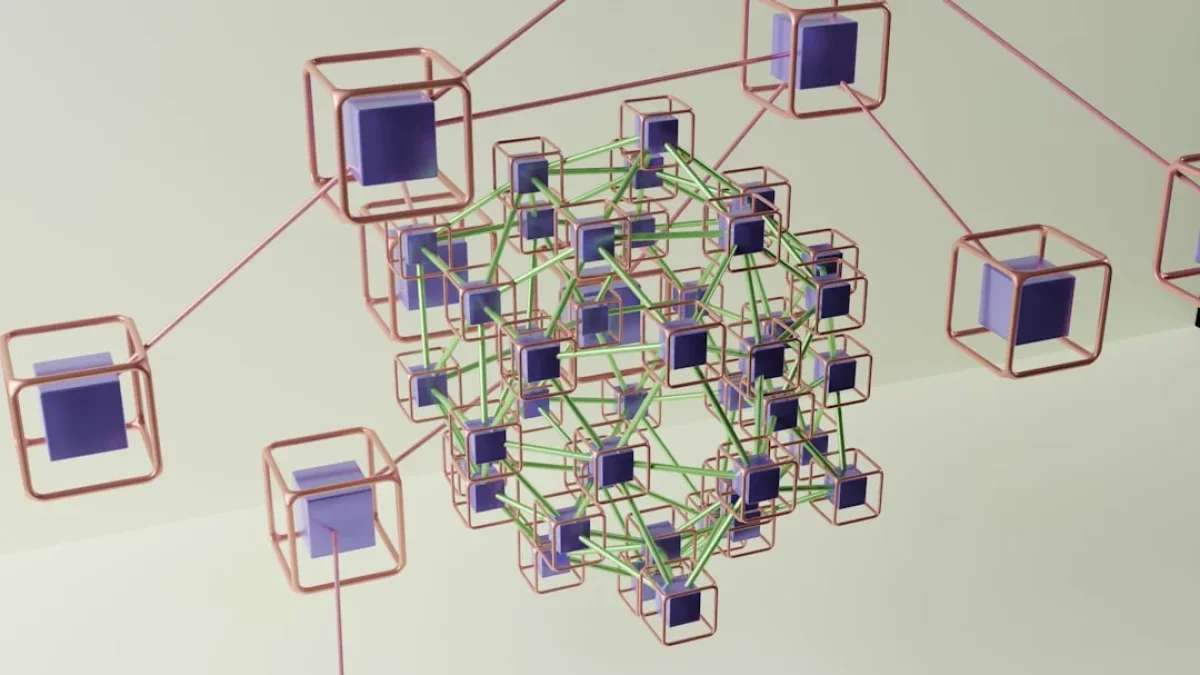

機械的解釈(mechanistic interpretability)とは、AIモデルの内部で何が起きているかを「機械の仕組み」として理解しようとする研究分野です。Sparse Circuitsは、モデルの多くの接続を薄め(sparse化)て、特定の出力に寄与する小さな「回路」を抽出しやすくする試みです。

なぜ“sparse(まばら)”にするのか?

大きなモデルは配線だらけの複雑な地下鉄網のようなものです。全部を一度に理解するのは困難です。sparsityで線を減らせば、特定の路線がどこへつながるか見えやすくなります。これにより、ある出力に寄与するユニットや経路を追跡しやすくなり、原因の特定や介入が現実味を帯びるわけです。

しかし、ここには設計上の難しさがあります。どの程度までsparseにするか。どのように回路を定義・抽出するか。これらの選択が結果に強く影響します。理論的には有望でも、実務で役立つかは実証が必要です。

期待される効果と注意点

期待できること:

- 望ましくない振る舞いの原因特定が速くなる

- 特定の「有害な回路」を特定して切り離す介入が可能になるかもしれない

注意すべきこと:

- 現時点で公開されている情報は限定的です。具体的なベンチマークや定量的評価が不足しています。

- 過度なsparse化で性能が落ちる可能性や、新たな脆弱性が生まれるリスクもあります。

過度の楽観は禁物です。実証データに基づく評価が不可欠です。

誰にどんな影響があるか

- 研究者・エンジニア:解析の粒度が上がれば、デバッグや安全評価がやりやすくなります。

- 事業者:説明責任やコンプライアンス対応に資する可能性がありますが、導入にはコストと評価が必要です。

- 一般利用者:短期的な目に見える変化は少ないかもしれませんが、研究の成果が実運用に反映されれば信頼性向上につながります。

今後に向けての現実的な道筋

- 手法の詳細公開と再現可能な実験データの提示

- ベンチマークによる定量評価と第三者による独立検証

- 実務では段階的導入。効果が期待できる領域からツールやプロセスを整備する

これらが進んで初めて、Sparse Circuitsは幅広く有効な手段になると言えます。

まとめ(読者への一言)

OpenAIの提示は、モデルの透明性を高める興味深い方向です。しかし、本当に信頼に足るかは、これからの詳細開示と実証にかかっています。論文やベンチマーク、オープンな再現実験に注目しておくことをおすすめします。未来の“回路図”が、AIと私たちの関係をどう変えるか。ワクワクする一方で、慎重な検証も忘れないでくださいね。