サム・アルトマンが語るOpenAIのペンタゴン契約

OpenAIのサム・アルトマンがペンタゴンとの契約を発表しました。詳細は未公開ですが技術的安全策を軸に透明性や監査の在り方が今後の注目点です。

冒頭:注目が再燃した政府とAIの協力

米国防総省(ペンタゴン)との契約を、OpenAIのサム・アルトマンCEOが公表しました。契約は「技術的安全策」を軸に据えると説明されていますが、詳しい条項はまだ公開されていません。市民感覚で言えば、車のシートベルトのように安全の基準を定めようという試みと捉えられます。

契約の要点はまだ霧の中

現時点で明らかになっているのは方針の方向性だけです。具体的な運用方法、監査の頻度、透明性の範囲などは非公開のままです。関係者が関心を寄せるのは「誰が」「どのように」「どれくらいの頻度で」AIの安全性を検証するのかという点です。

Anthropicの論点と重なる課題

ここで名前が出てくるAnthropicは、AI安全性の基準や検証の重要性を提起してきた別の企業です。Anthropicが指摘してきた問題と似た観点が今回の契約でも考慮されているとされ、業界全体で安全性の測り方が再検討される可能性があります。

何が変わるのか:企業と研究者への影響

もし技術的安全策が実務に落とし込まれれば、企業や研究者は新しい基準に合わせて対応を迫られます。透明性の要求が強まれば、研究データや検証手順の公開度にも影響が出るでしょう。一方で、安全性を担保しつつ競争力を維持するバランスは簡単ではありません。

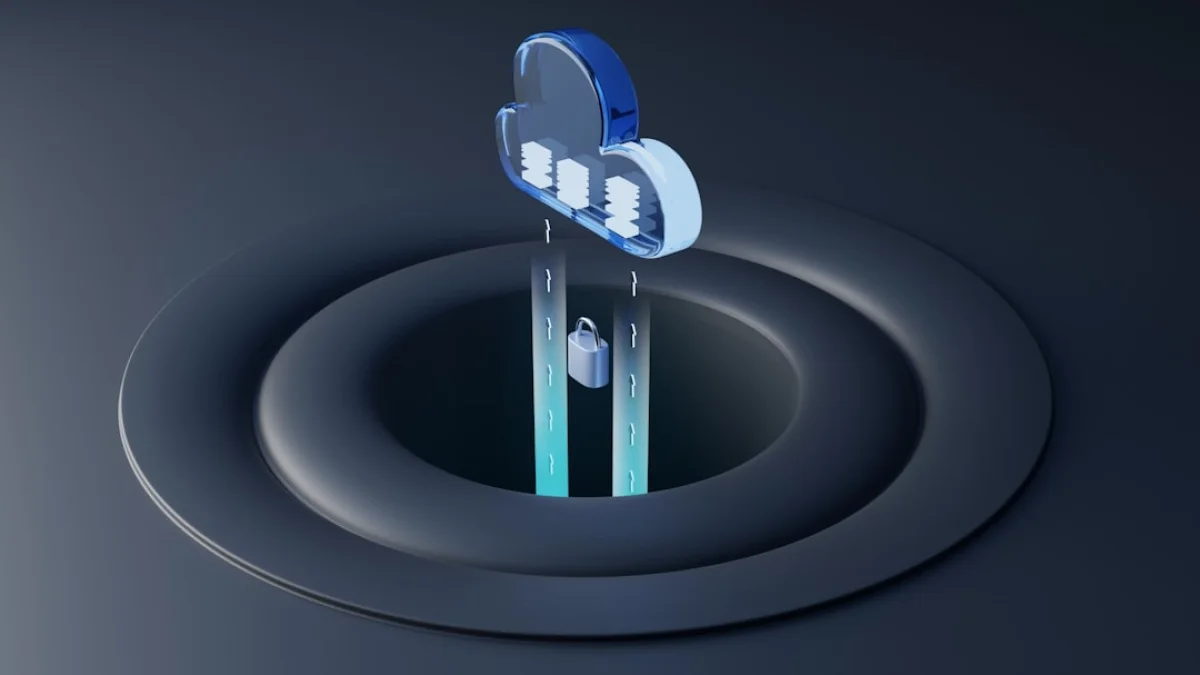

イメージで理解する:安全策の“設計図”とは

契約は建物の設計図のようなものです。設計図だけでは建物は完成しません。実際の材料や検査、メンテナンスが伴って初めて安全が確保されます。今回の発表は設計図を出した段階であり、実務での取り組みがこれから問われます。

注意点と今後の焦点

鍵になるのは透明性と再現性です。検証方法が公開されれば第三者による評価が進みます。公開されなければ疑問が残り、信頼の構築が遅れます。ペンタゴン契約が業界標準にどう影響するかは、今後の公開情報で見えてくるでしょう。

結び:注目しておくべきポイント

今回の発表は、政府と民間が安全性で協力する新たな一歩です。とはいえ詳細が出てこそ実効性が評価できます。読者の皆様は、契約の運用ルール、監査の仕組み、そして公開される検証結果に注目してみてください。新しい情報が出次第、追ってお伝えします。