AIロードマップと対立から学ぶ6つの教訓

Pro-Human宣言の最終化とPentagonとAnthropicの対立を受け、透明性や実行可能な基準、国際協調など6つの教訓を示し、倫理と革新の両立を目指す道筋を提案します。

AIロードマップと対立から学ぶ6つの教訓

AIの進路が揺れています。航路に例えれば、今は羅針盤を見直すタイミングです。先週、Pro-Human宣言が最終化される一方で、米国国防総省(Pentagon)とAI企業Anthropicの対立が表面化しました。両者の動きは、同時期に起きたことで世間の注目を集めています。

ここで押さえておきたいのは二点です。ひとつは、宣言の具体的な中身がまだ公開されていないこと。もうひとつは、対立が倫理や安全性の議論を一気に政策決定の場へ押し上げたことです。宣言が実際の開発行動にどの程度影響するかは、公開される要点次第で変わります。

以下では、この状況から導ける6つの教訓を紹介します。短く、実務に結びつく視点を意識しました。難しい用語は初出時に簡潔に説明します。

教訓1: 透明性と情報公開の継続

ロードマップは羅針盤です。信頼には地図の詳細さが必要です。要点や制約、安全対策を明確に示すことで、関係者の合意形成が進みます。企業や政府は、逐次的に情報を共有する仕組みを作るべきです。

教訓2: 倫理と安全性を実装可能な基準へ

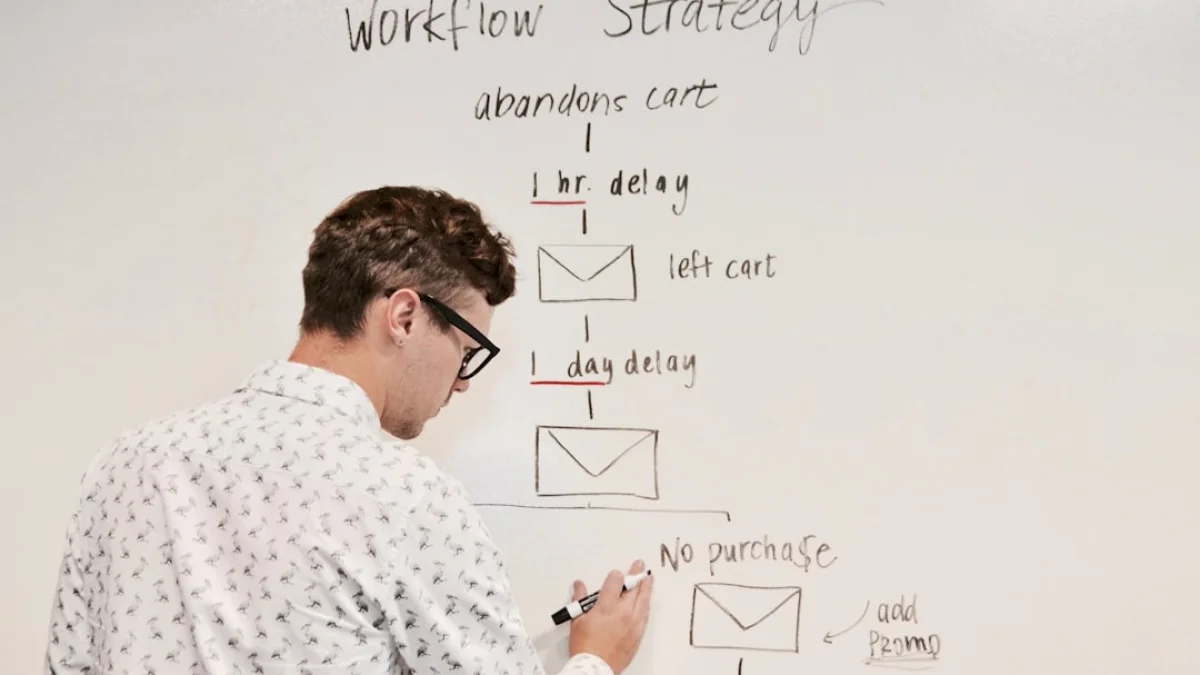

倫理や安全と言っても、それが抽象のままでは現場で使えません。達成可能な基準と検証手順、いわばチェックリストを用意しましょう。実験や運用で何を測るかが明確になれば、現場の対応も速くなります。

教訓3: 政府・産業の協調と透明な対話

規制は一方通行では機能しません。政府、企業、研究機関が互いに顔を合わせ、前提条件を確認する場が必要です。対話は摩擦を減らし、実効的なルール作りにつながります。

教訓4: 国際協力と標準の重要性

AIは国境を越える技術です。各国がバラバラのルールでは混乱を招きます。国際的な合意や標準化は、安全性と開発速度のバランスを取る土台になります。

教訓5: 市民の理解と参画の確保

倫理や安全の議論は専門家だけのものではありません。市民が議論に参加することで、政策の正当性と受容性が高まります。公開イベントや分かりやすい説明資料が有効です。

教訓6: 実効性のある監視と評価

制度は作って終わりではありません。継続的な評価と改善の仕組みを組み込み、現場のフィードバックを政策に反映させましょう。メトリクスを設定することが鍵です。

最後に一言。今は「速さ」と「慎重さ」を同時に求められる局面です。透明性を高め、具体的な基準を共有し、対話を続けることで、倫理と革新を両立させる道が見えてきます。今後の公式発表と議論の進展に注目してください。