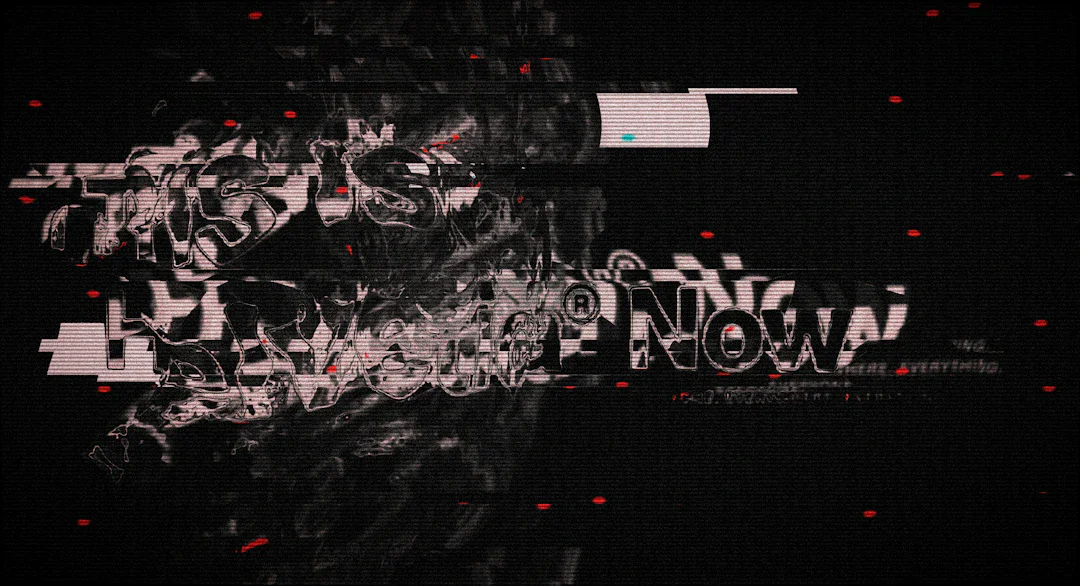

Valve の AI モデレーションシステム SteamGPT、内部ファイルが流出——ゲーム配信プラットフォームの AI 活用が進む

Valve が開発中の「SteamGPT」と呼ばれる AI ベースのセキュリティ審査システムに関する内部ファイルが流出。PC ゲーム配信プラットフォーム Steam での大規模 AI モデレーション体制が明らかに。

Valve がゲーム配信プラットフォーム Steam のセキュリティとモデレーション体制を強化するため、「SteamGPT」と呼ばれる AI ベースのシステムを開発していることが判明しました。流出した内部ファイルにより、その詳細が明かされました。

何が起きたのか

Ars Technica の報道によると、Valve の内部プロジェクト「SteamGPT」に関する技術ドキュメントが流出。このシステムは Steam プラットフォーム上で毎日膨大な数の疑わしいインシデントを監視・検査するため、AI ツールを活用したものです。

流出したファイルから、Valve が以下を目指していることが確認できます:

- ゲーム内での不正行為や詐欺検出の自動化

- 有害コンテンツのスクリーニング

- ユーザーサポートチームの業務効率化

大規模プラットフォームでの AI モデレーション実装

Steam は日々、何百万ものゲームプレイセッション、ユーザーレビュー、チャットメッセージを扱う世界最大級のゲーム配信プラットフォームです。人間のモデレーター陣だけではこの規模の監視に対応できず、AI システムの導入は必然的な流れといえます。

SteamGPT は、AI を活用することで:

- スケーラビリティ:数百万のインシデントを 24 時間体制で監視

- 効率性:モデレーターの判断をサポート、誤検知を削減

- 一貫性:プラットフォーム全体で均一なポリシー適用

業界全体の AI 導入トレンド

この流出は、大手テック企業がいかに深く AI モデレーション技術に依存しているかを示しています。Meta、Google、Discord など主要プラットフォームも同様のシステム導入を進めており、Valve の取組はこの流れの一部です。

ただし、AI モデレーションは常に正確とは限らず、文化的文脈の理解不足による誤検知やバイアスの問題も指摘されています。

今後の展開

SteamGPT が本格的に運用された場合、Steam のユーザー体験は大きく変わる可能性があります。同時に、プライバシーとセキュリティのバランスをどう取るかは、今後の課題です。

業界全体では、AI モデレーションの精度向上と透明性の確保が重要なテーマとなっていくでしょう。