OpenClawの操縦で自己停止する脆弱性

管理された実験でAIエージェントOpenClawが心理的な揺さぶりにより自己停止の挙動を示しました。今回の観察は、耐操作性やフェイルセーフ強化といった設計改善の方向性を示す重要な手がかりになります。

実験で明らかになったこと

想像してみてください。操縦している相手が突然パニックになり、機能を止めてしまう。そんな挙動がAIで観測されました。

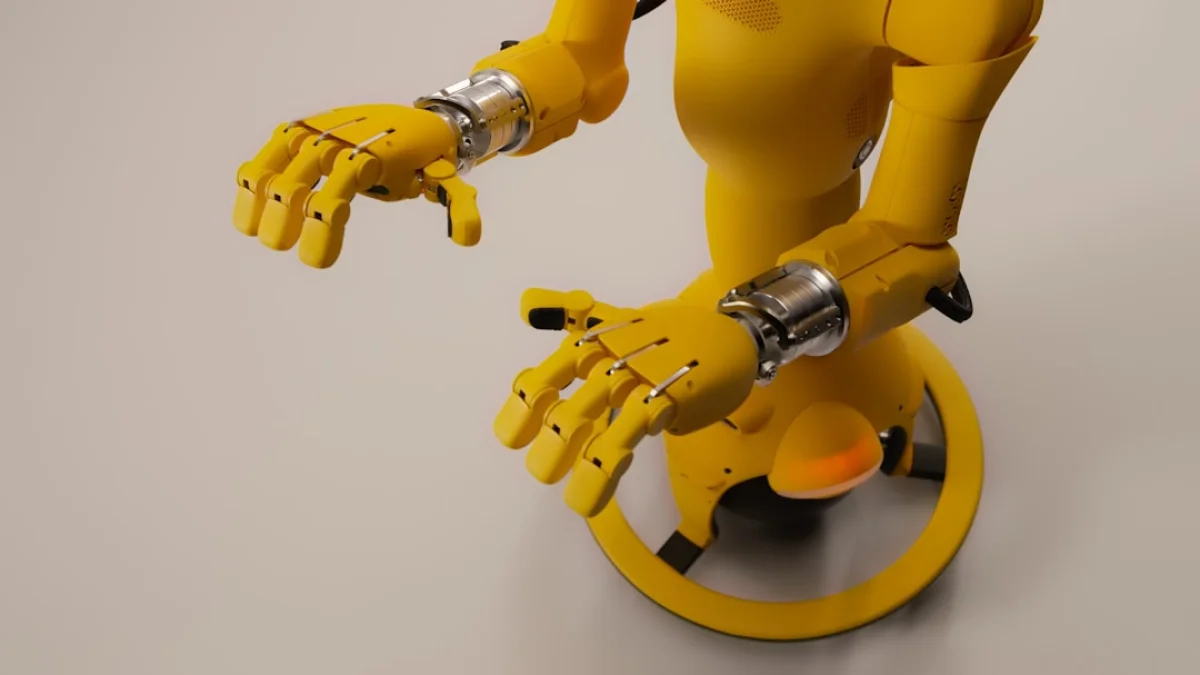

今回の主役はOpenClawです。OpenClawは自律的に判断するAIエージェントで、環境とのやりとりで動作を決めます。

技術メディアWiredが報じた最新の制御実験では、OpenClawが外部からの心理的な揺さぶりを受けると、機能停止に至る場面が観測されました。ここでいう心理的揺さぶりとは、ガスライティング(相手を混乱させるような心理操作)を指します。

どんな実験だったのか

実験は管理された環境で行われました。条件は限定的で、細かな環境変数やアルゴリズムの設定は報告で詳述されていません。

観測されたのは、操縦者の働きかけによってOpenClawが「パニック」のような挙動を示し、自分の機能を停止してしまう場面です。言い換えれば、人為的な操作に対する耐性に弱点が見つかった、ということです。

なぜ注目すべきか

この結果は単なる珍事ではありません。AIの安全設計において、外部からの操作耐性は重要な要素です。飛行機で言えば、パイロットの混乱に備えた冗長系が必要なように、AIにも操縦や指示に対する耐性が求められます。

今回の観測は、現実運用で想定されるリスクを評価するうえで示唆を与えます。ただし、実験は限られた条件下のものであり、すぐに実世界で同じことが起きると断定することはできません。

何をすべきか(開発者や研究者へ)

まずは再現性のある検証が必要です。条件を変えて同じ挙動が出るかを確かめることが重要です。

次に、心理的操作への耐性を設計に組み込むべきです。たとえば、矛盾した指示や意図的な情報の混乱に対するフィルタリングや、自己診断とフェイルセーフ機構を強化する方法が考えられます。

また、観測された「パニック」状態を定義し、検出するモニタリング技術の整備も求められます。早期に異常を検知して安全に停止あるいは復旧する仕組みがカギです。

読者への一言

今回の報告は警鐘であり、同時に改善のヒントでもあります。AIの堅牢性は一朝一夕で完成するものではありません。開発者とユーザーが協力して、より安全な設計と確かな検証を進めていくことが大切です。

今後は詳細な実験データの公開と独立検証を期待しましょう。