Garry TanのClaude Codeが議論を呼ぶ理由

Garry Tanが公開したClaude Codeの設定は手軽に再現できる学習素材として開発者の注目を集め、ClaudeやChatGPT、Geminiなどの比較検討の場を広げつつ、各社ポリシーや公式情報を照らし合わせることで安全かつ効果的に活用できます。

AIツールの「使い勝手」と「安全性」をめぐる議論が、また現場レベルで盛り上がっています。きっかけはGarry Tan氏がGitHubで公開した、いわゆるClaude Codeの設定です。

ClaudeとはAnthropicが開発する対話型の大規模言語モデルで、Claude Codeというのはその活用やコード生成に役立つ設定やスクリプト類を指します。誰でも手を動かして試せる点が評価され、一方で公式サポートがないことを不安視する声も出ています。

公開がもたらした波紋

この設定はGitHub上で広まり、数千人規模の開発者が試していると伝えられています。話題は開発コミュニティ内に素早く拡散し、技術者同士の議論を生んでいます。

短く言えば、利便性と検証機会を生む“学びの道具”になっている半面、サポートや安定性の面で“自己責任”が強まる状況です。

なぜ注目を集めたのか

主な理由はシンプルです。誰でも短時間で環境を再現できること。手順が公開されていれば、学習コストはぐっと下がります。

例えるなら、良くまとまったレシピを配るようなものです。料理が苦手でも工程を追えば同じ味に近づけます。しかしプロの厨房のように、火加減や素材の違いで結果が変わる点は注意が必要です。

また、ClaudeだけでなくChatGPT(OpenAI)やGemini(Google)など他社のモデルと比較する機会が増えたことも、議論を活性化させる要因です。

賛否のポイントを整理すると

利点

- 短時間で環境再現が可能なため学習やプロトタイピングが捗る

- コミュニティでノウハウ共有が進みやすい

懸念点

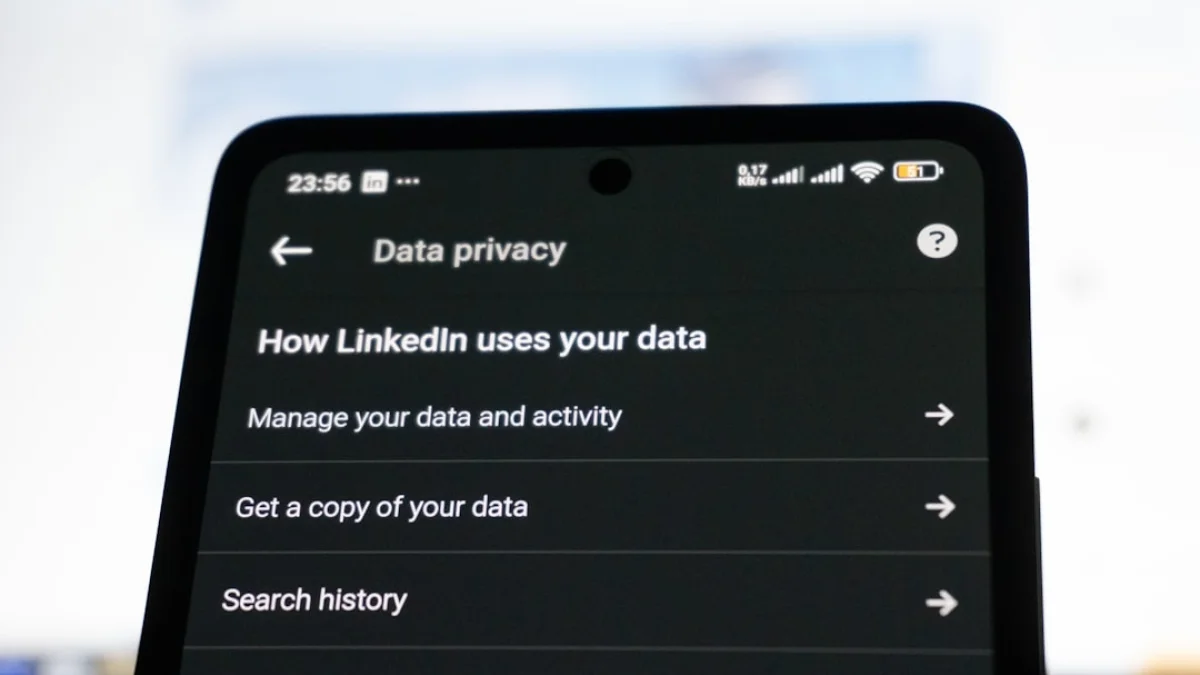

- 公式サポートがないため不具合時の対応が自己責任になりやすい

- 企業ごとのポリシーや安全基準が異なり、利用時に混乱が生じる可能性がある

- 著作権・倫理・セキュリティ面のチェックが不十分だとリスクになる

このように、利便性を評価する声と、ガバナンスの不備を心配する声が拮抗しています。

今後どう見ればよいか

開発者や企業は、オープンな共有文化と安全性のバランスを模索する必要があります。実務的な対策としては、次のような点をおすすめします。

- 本番環境ではまず小さな実験環境で検証する

- 各ベンダーの利用規約やセキュリティガイドラインを確認する

- 機密データは投入しない、あるいはマスキングして試す

- コミュニティ情報は参考にしつつ、公式ドキュメントで裏取りする

比喩を使うと、公開設定は「試乗用の車」です。試してみて感触を掴めますが、長距離運用や改造はメーカー保証や整備を確認してからにしましょう。

結論:情報を活かす工夫を

今回の動きは、学習機会と比較検討の場を広げるポジティブな側面が強いです。同時に、利用者自身がリスクを評価し、公式情報と照らし合わせる習慣が求められます。

興味がある方はまずローカルや隔離された環境で試し、情報の出所を確認しながら活用してみてください。議論の行方はまだ続きますが、検証と透明性が信頼を築く鍵になるでしょう。