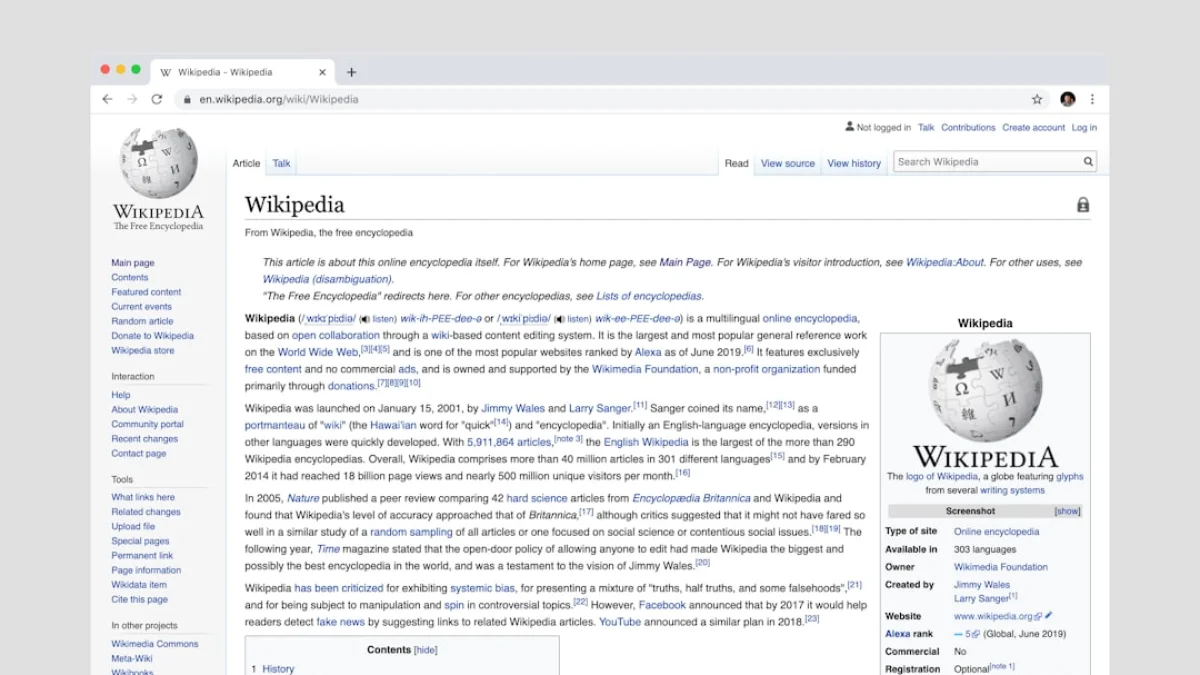

WikipediaがAI記事作成を原則禁止

ウィキペディアは信頼性向上を目指し、AI生成記事の利用を制限し、翻訳と小さな表現修正のみを例外とする新方針を打ち出して編集ガイドラインの整備と運用見直しを進めます

要点をひと言で

ウィキペディアは、AIで新規記事を作ることや既存記事をAIで書き直すことを原則禁止にしました。翻訳と小さな表現修正だけが例外です。今回はその狙いと影響をやさしく解説します。

何が変わるのか

新方針では、AIを使った生成や大幅な再執筆が原則として認められません。例外は翻訳作業と、意味を変えないような小さな表現の修正に限られます。

ここでいうAIとは、大量の文章を学習して人間のような文章を生成する大規模言語モデル(LLM)のことです。LLMは短時間で多くの文を書けますが、誤情報や出典不明の記述を作ることがあります。

なぜ今なのか

急速なAI技術の進展に伴い、LLMが事実と異なる話を自信満々に提示するケースが増えました。百科事典にとって最も大事なのは「正確さ」と「信頼性」です。今回の改定は、その二つを守るための安全装置を取り付けるようなものです。

例えるなら、図書館に自動書き換えボタンが付いたとしたら本当に良いか慎重に考える、という感覚です。便利さと正確さのバランスを再調整したわけです。

編集者と読者への影響

編集者は作業手順を見直す必要があります。AI任せにしていた下書きを手作業で確認し直す場面が増えるでしょう。一方で、出典確認や検証の重要性が高まり、結果的に記事の品質向上につながる期待があります。

読者としては、表示される情報の出典や検証の跡がさらに重視されるはずです。信頼できる百科事典を維持するための一歩、と考えていただければわかりやすいでしょう。

実務面の注意点

例外で認められる翻訳でも、機械翻訳をそのまま載せるわけにはいきません。翻訳結果を人が検証し、文脈に沿った修正を加えることが求められます。また、方針の具体的運用は今後の議論で細部が詰められていきます。

これから何を見ればいいか

技術は進み続けます。ウィキペディアは今回、信頼性を優先する判断を示しましたが、将来的な方針の微調整や新しい検証ツールの導入も考えられます。編集者も読者も、変化の行方を注視し、必要に応じて対応を柔軟に変えていくことが大切です。

最後にひと言。AIは強力な道具ですが、百科事典は道具任せにできない場面が多い場所です。今回の決定は、その“人手と検証”の価値を再認識する契機になりそうです。