AI相棒は孤独を救うのか、深めるのか

AI相棒(例: ChatGPT)は、夜間の相談や日常のストレス軽減に役立ちますが、適切な利用ルールと透明なデータ管理を整えることで、孤独を和らげる頼れる相棒になれます

はじめに――夜中にそっと聞いてくれる相手

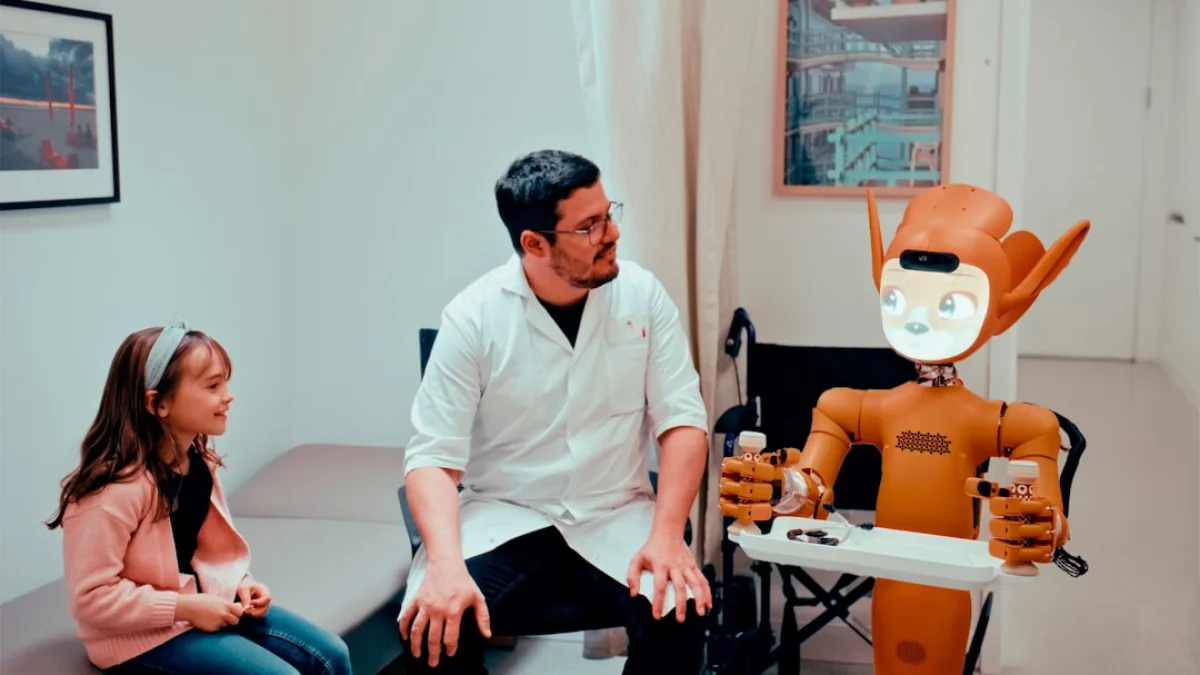

夜中にふと誰かと話したくなることはありませんか。そんな時、スマホの向こうにいるAI相棒は、24時間待っていてくれます。疲れずに批判もしない。ポケットに入った相談相手といえる存在です。

この便利さが注目を集める一方で、長く付き合うと人とのつながりにどんな影響が出るのか。即効性のある安心感と、長期的な関係性の希薄化。この相反する2つの面が、いま議論の核心です。

即効性のメリットと、その魅力

AIは予測や共感のシグナルを出して、孤独を和らげます。短い対話で気分が落ち着く。たとえば、夜に悩みを吐き出すだけで安心する人は多いでしょう。仕事での小さな相談も、気軽に済ませられます。

この即効性は、まるで冷えた体に温かい飲み物を差し出すような働きです。短時間でほっとする効果は確かにあります。

長期利用で現れる変化

しかし長く頼りすぎると、現実の人間関係に必要な“やりとりの訓練”が減る恐れがあります。対人関係には時に不快な緊張や調整が必要です。そこをAIが代替してしまうと、実世界での関係構築が難しくなるかもしれません。

また、AIの対話は平坦になりがちです。感情の揺れや矛盾をリアルに返してくれるのは、人間同士の強みです。長期的な幸福感は、その複雑さを乗り越える経験から生まれることもあります。

職場や日常で誰が影響を受けるか

実務の現場では、個人の利用がチームのコミュニケーションに波及します。たとえば、ちょっとした確認や愚痴をAIで済ませる社員が増えれば、雑談の減少や信頼形成の機会喪失につながります。

一方で、初期のストレス緩和やメンタルヘルスの補助としては有効です。要はバランスの問題です。個人と組織の双方が利用ルールを考える必要があります。

技術、倫理、規制の注目点

技術面では感情モデリングの精度向上が進みます。より「人らしい」返答が可能になれば、依存リスクは大きくなります。

倫理と規制では、感情データの扱い、透明性、依存防止策が重要です。企業や開発者は、利用者がどう安心して使えるかを示すガバナンスを整える必要があります。

上手な付き合い方の提案

AIを完全な代替にしないための実践的な工夫をいくつか挙げます。

- 日常の補助ツールとして位置づける。感情的な決断は人と相談する習慣を残す。

- 使用時間や回数の目安を自分で決める。週に何回は直接会話を持つなど、ルール化する。

- 組織としてのガイドラインを作る。業務上の相談はAIで済ませないケースを定める。

- データ取り扱いや応答の限界を明示する。透明性が信頼につながる。

これらは、AIを“味方”にするための工夫です。ポケットの相談相手を賢く使えば、孤独の救済にも、豊かな人間関係の維持にも役立ちます。

おわりに――AIと人間の最適な距離感を探る

AI相棒は強力なツールです。夜の安心をくれる半面、人と人の間で育つ緊張感や学びを奪うこともあり得ます。大切なのは、便利さを享受しつつ、現実のつながりを意図的に守ることです。

企業も個人も、透明性とルールを整えながら、AIとの“ほどよい距離”を設計していきましょう。そうすれば、AIは孤独を和らげる良き相棒になれるはずです。