D4RTで加速するロボットの四次元認識

Google DeepMindのD4RTは、動画から時間を含む立体情報を4Dで高速に再構成し、ロボットやARの空間理解を大きく前進させる可能性を示しています。

動画の一瞬を超えて、世界を“動く立体”として捉える――そんな未来が見えてきました。Google DeepMindが発表した新モデル、D4RTは動画から動的シーンを4Dで再構成する技術です。ここでいう4D再構成とは、時間を含めた立体情報を復元することを指します。つまり、動く物体や人の形と動きを、空間と時間の両面で再現する技術です。

どこが新しいのか

D4RTの最大の特徴は処理速度です。従来法と比べて最大で約300倍の高速化が報告されています。実験では、動画の連続フレームから時間情報を含む3次元構造を短時間で生成できました。イメージとしては、映画の一場面を立体模型にして、動きまで再現できるようなものです。これにより「ほぼリアルタイム」の環境理解が現実味を帯びます。

期待できる応用例

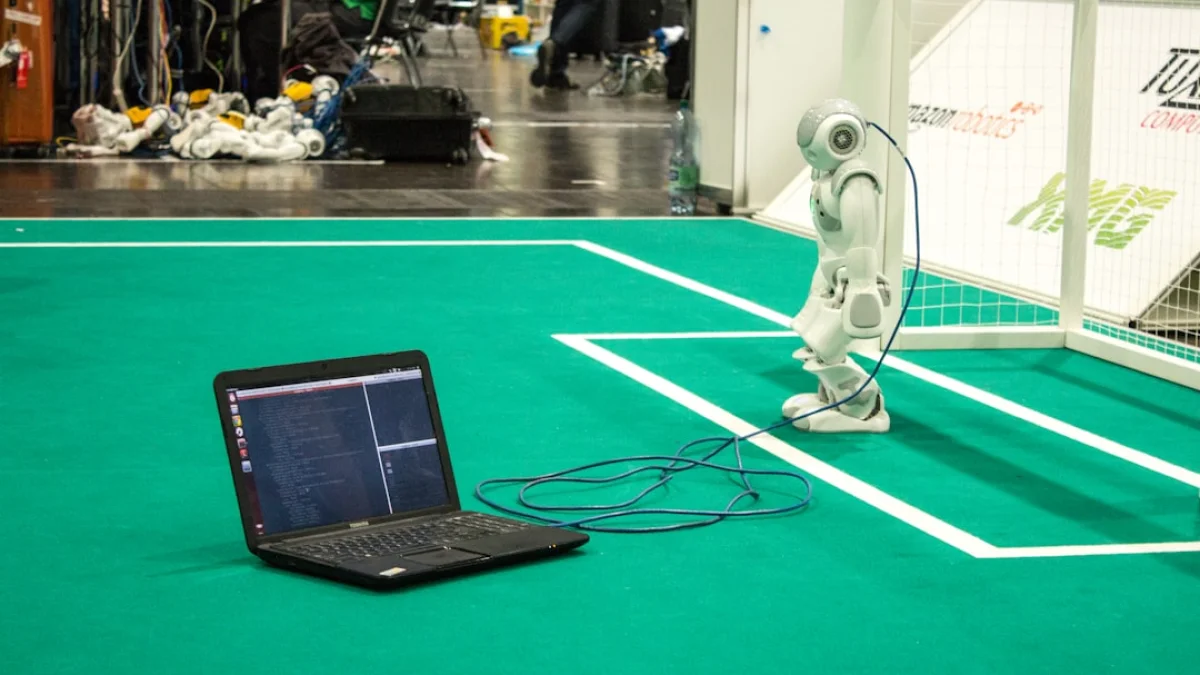

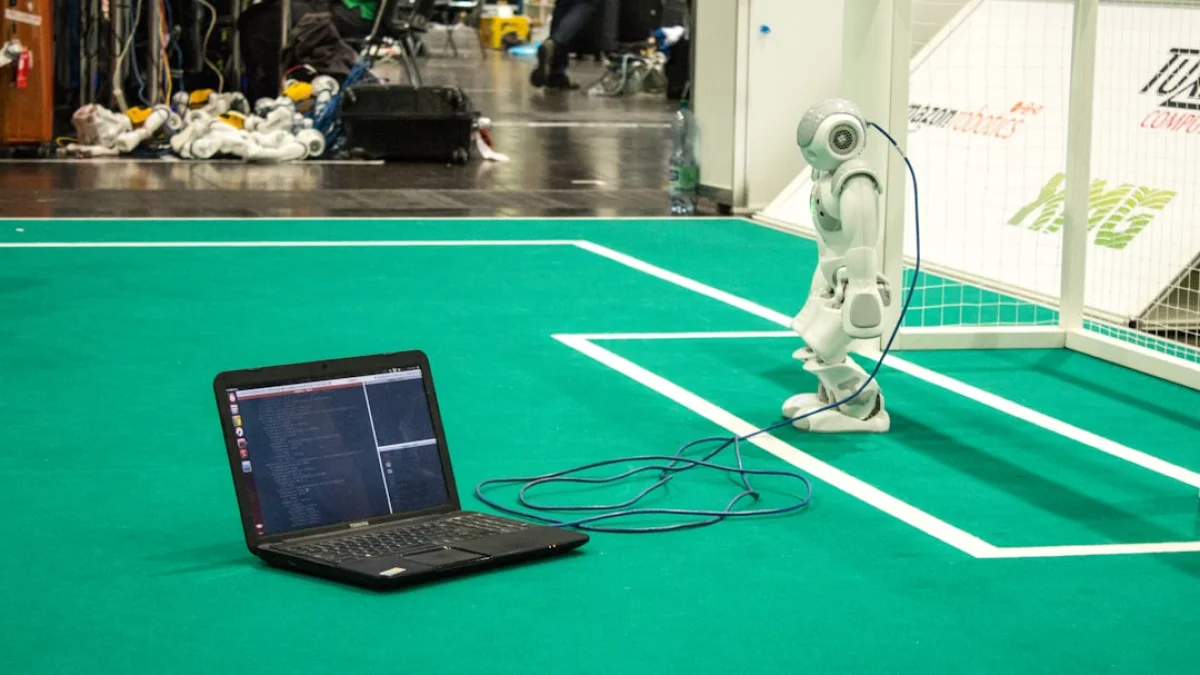

スピードが上がると、応用の幅も広がります。たとえば家庭用ロボットなら、動く子どもや家具を瞬時に把握して安全に動けます。現場作業向けのAR(拡張現実)では、動く機械や人に合わせて情報を重ねられます。自動運転や産業ロボットでも、動的な障害物の予測精度が向上するはずです。

残る課題と注意点

ただし、現実導入には壁があります。4D再構成は大量のデータと高い計算リソースを必要とすることが多いです。学習に使うデータセットの多様性や、計算コストの削減が今後の課題です。加えて、屋外環境や照明変化、見慣れない物体への一般化性能も検証が必要です。

今後の展望

D4RTは四次元的な空間理解を高速化する大きな一歩です。今後はモデルの効率化やデータ効率の改善が進むでしょう。そうなれば、家庭や現場で「動く世界」を正確に扱える機器が増えてきます。研究と実装の積み重ねで、ロボットやARがより人間に近い空間認識を持つ日が来るはずです。興味がある方は、DeepMindの今後の発表と実証実験をチェックしてみてください。