GPT-2 から Claude Mythos へ、「危険すぎてリリース不可」が現実に

2019年の GPT-2「危険すぎてリリースできない」宣言から7年。Anthropic の Claude Mythos Preview は 27年前の未発見脆弱性を見つけ出し、その宣言の正当性を証明した。

2019年、OpenAI は GPT-2 を「危険すぎてリリースできない」と宣言して業界を沸かせた。その時、多くの論者は「言い過ぎだ」と笑った。7年後、Anthropic が Claude Mythos Preview で OpenBSD の 27年前のバグを見つけたことで、OpenAI の警告がいかに先見の明があったかが証明されることになった。

GPT-2 の警告は正しかったのか

2019年、OpenAI は当時の最先端言語モデル GPT-2 について、危険性を理由に完全リリースを段階的に実施すると発表した。脆弱性利用、悪質なコンテンツ生成、詐欺的な使用といった懸念が理由だった。当時の業界では「過剰反応」という声も多く、慎重な姿勢に対する批判もあった。

7年経った今、Claude Mythos Preview が数千もの高度な脆弱性を発見し、悪用方法まで示唆しうるという能力を実証したことで、当時の警告が単なる予防線ではなく、現実的な懸念だったことが明らかになった。

Claude Mythos Preview が見つけた脆弱性の規模

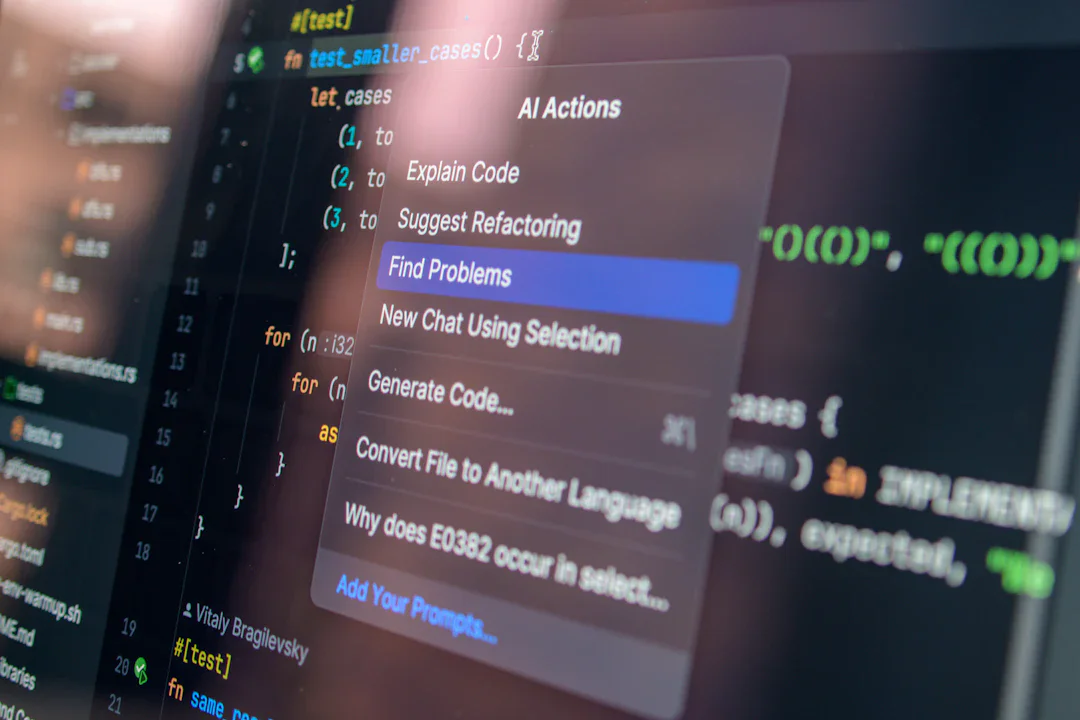

Anthropic が Project Glasswing のパートナー企業経由で実施したセキュリティテストによると、Claude Mythos Preview は以下を含む複数の重大な脆弱性を発見した。

OpenBSD: 27年にわたって検出されず、接続中の任意のマシンをリモートでクラッシュさせることができるバグ。

FFmpeg: 16年の歴史を持つビデオエンコーディングツールの脆弱性。自動セキュリティスキャンツールが約500万回実行しても見逃していた。

Linux カーネル: 複数の脆弱性を組み合わせることで、マシン全体の制御権を奪う権限昇格の欠陥。

これらの発見は Mythos Preview が単なる高性能 LLM ではなく、セキュリティ領域で人間の研究者さえ見落とす脆弱性を体系的に発見できる能力を持つことを示している。

業界の対応は混乱状態

Linux カーネル開発に携わる著名なセキュリティ研究者 Greg Kroah-Hartman は、AI が生成した脆弱性報告に対応するのに膨大な時間を費やしていると述べている。セキュリティコミュニティは、従来の手作業による脆弱性発見プロセスが、AI の発見速度に追いついていない現状に直面している。

Anthropic が制限されたアクセスで Claude Mythos Preview を公開している理由は、このギャップを埋めるためだ。Project Glasswing のパートナーには AWS、Apple、Microsoft、Google、NVIDIA など 40以上の組織が参加し、セキュリティの専門家がいる環境でのみ使用を許可している。

「危険だから制限する」の正当性

Claude Mythos Preview の公開方法は、GPT-2 当時の「段階的リリース」戦略をさらに進化させたものだ。Anthropic は悪用のリスクを認識しながらも、広範リリース前に改善されたモデルとセーフガードを検証する方針を採用している。

一般向けのリリースは現在のところ予定されておらず、Claude API・Amazon Bedrock・Vertex AI など限定的なプラットフォームでのオンボーディング時に初期セーフガードが施される。

長期的な示唆

GPT-2 から Claude Mythos への7年間の経過は、AI 企業の安全保障政策が、単なる「慎重さ」ではなく、実際的な脅威に基づいていることを示している。

高度なセキュリティ能力を持つモデルが一般に公開されると、防御側と攻撃側の非対称性がさらに拡大する可能性がある。Anthropic の制限リリース方式は、セキュリティコミュニティと企業側が協力して脆弱性対応を加速できるまで、モデルへのアクセスを管理する折衷案として機能している。