NYTの2000万会話要求に対するOpenAIの反撃

ニューヨーク・タイムズが約2000万件のChatGPT会話ログの開示を要求し、OpenAIが利用者のプライバシー侵害だと法的対抗を表明、透明性と個人情報保護のバランスが焦点となっています。

ユーザープライバシーか報道の透明性か — NYTの要求にOpenAIが反発

想像してみてください。鍵のかかった日記の束を第三者が覗こうとしているようなものです。今回、話題になっているのは、ニューヨーク・タイムズ(NYT)がOpenAIに対し、約2000万件に及ぶChatGPTの会話ログの提出を求めたという報道です。OpenAIはこれを受けて強く反発し、法的に争う姿勢を示しています。

何が起きたのか

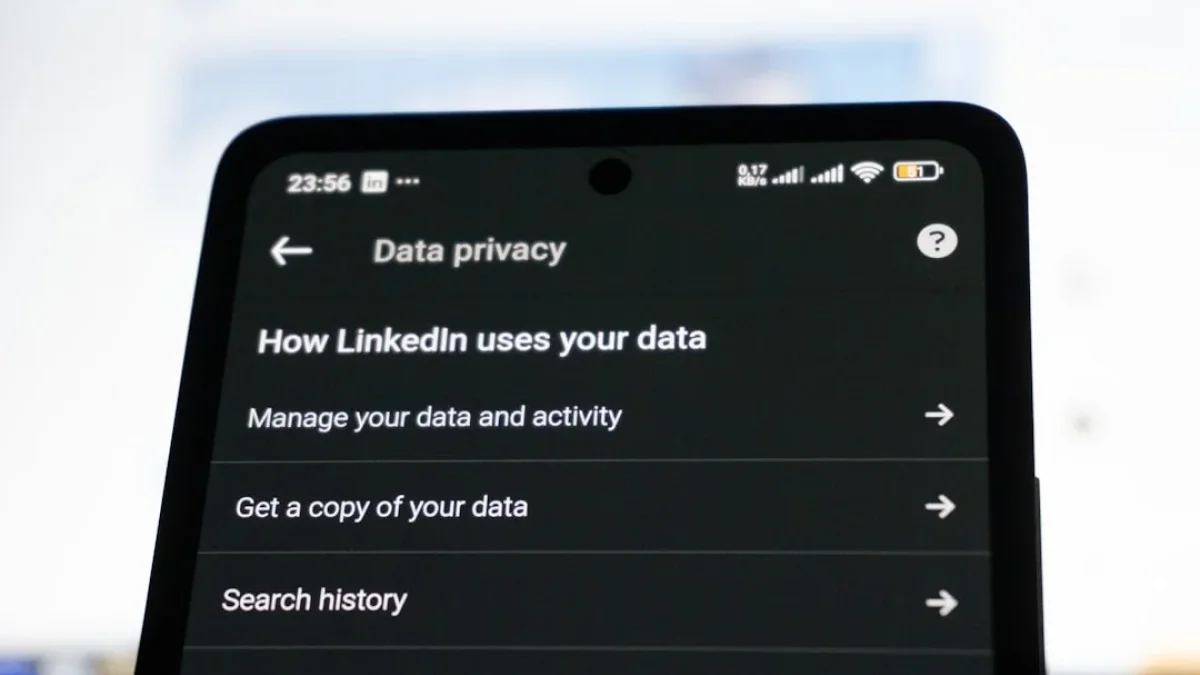

報道によると、NYTはプライベート設定で交わされた会話ログの開示を要求しました。ここでいう「会話ログ」とは、ユーザーとChatGPTとのやり取りの記録を指します。OpenAIは同要求を「ユーザーのプライバシー侵害だ」と非難し、声明ヘッドラインには英語で“Fighting the New York Times’ invasion of user privacy”と記されています。

両者の主張は現在、声明と報道に留まっています。具体的な法的手続きの進捗や、どの範囲までの情報開示が想定されているかといった詳細は、まだ明らかではありません。

なぜ問題になるのか

この対立は単なるデータのやり取りの可否を超え、透明性とプライバシーという二つの価値がぶつかる場面です。NYT側は実データへのアクセスでAIモデルの挙動や誤情報、バイアスを検証したいと考えています。一方、会話ログには個人情報や機微な私的やりとりが含まれる可能性が高く、無条件の提供は利用者の信頼を大きく損ねかねません。

たとえば、あなたがチャットに健康や家族の事情を打ち明けていたとします。その記録が第三者に渡ることを想像すると、多くの人は不安を感じるでしょう。匿名化とは、個人を特定できないようにデータを加工することを指しますが、それがどこまで信用できるかも議論になります。

影響は誰に及ぶか

- 利用者:自身の会話が第三者に渡るかもしれないという不安から、サービス利用を控えたり入力内容を極端に慎重にする可能性があります。

- 研究者・開発者:実データで問題点を検証できる利点と、個人情報保護のためにデータが制限されることで研究が進みにくくなるリスクが両立します。

- 報道機関:重大な問題を明らかにするには十分なデータが必要ですが、取得手段がプライバシー権を圧迫するなら正当性が問われます。

今後注目すべき三つのポイント

- 法的手続きの行方:裁判所がどの範囲までの開示を認めるか。

- 技術的・運用的条件:認められた場合に求められる匿名化やフィルタリング、第三者監査の仕組み。匿名化は個人特定を避ける加工を意味します。

- 先例と業界慣行:今回の判断が今後のデータ要求や規制にどう影響するか。

読者として今できること

この争いは、AIが私たちの生活に深く関わる現代の重要な問いです。まずは利用規約やプライバシーポリシーに目を通し、企業がどのようにデータを扱うかを確認しましょう。また、サービス利用時に入力する情報の種類や表現を見直すのも一案です。

結び — バランスをどう取るかが鍵

今回の対立は、報道の監視機能と企業の利用者保護責任という公共圏のバランスをめぐる重要な前例になり得ます。鍵は透明性とプライバシーの両立です。どちらを重視するかで社会のルールは変わります。今後の法的決着や企業の具体的な保護策に、ぜひ注目してください。