Nvidia、マルチモーダルモデル『Nemotron 3 Nano Omni』公開——複数AI企業のデータで学習

Nvidia がマルチモーダルモデル『Nemotron 3 Nano Omni』を公開。テキスト・画像・動画・音声を統一的に処理でき、GUI エージェント向けで Qwen3-Omni より 9 倍高速。トレーニングデータは OpenAI・Qwen・DeepSeek など複数企業のモデルから構成。

Nvidia が 30 億パラメータのマルチモーダルモデル「Nemotron 3 Nano Omni」を公開した。テキスト・画像・動画・音声を統一的に処理できる設計で、エンタープライズ向けの AI エージェント開発を見据えたリリースとなっている。

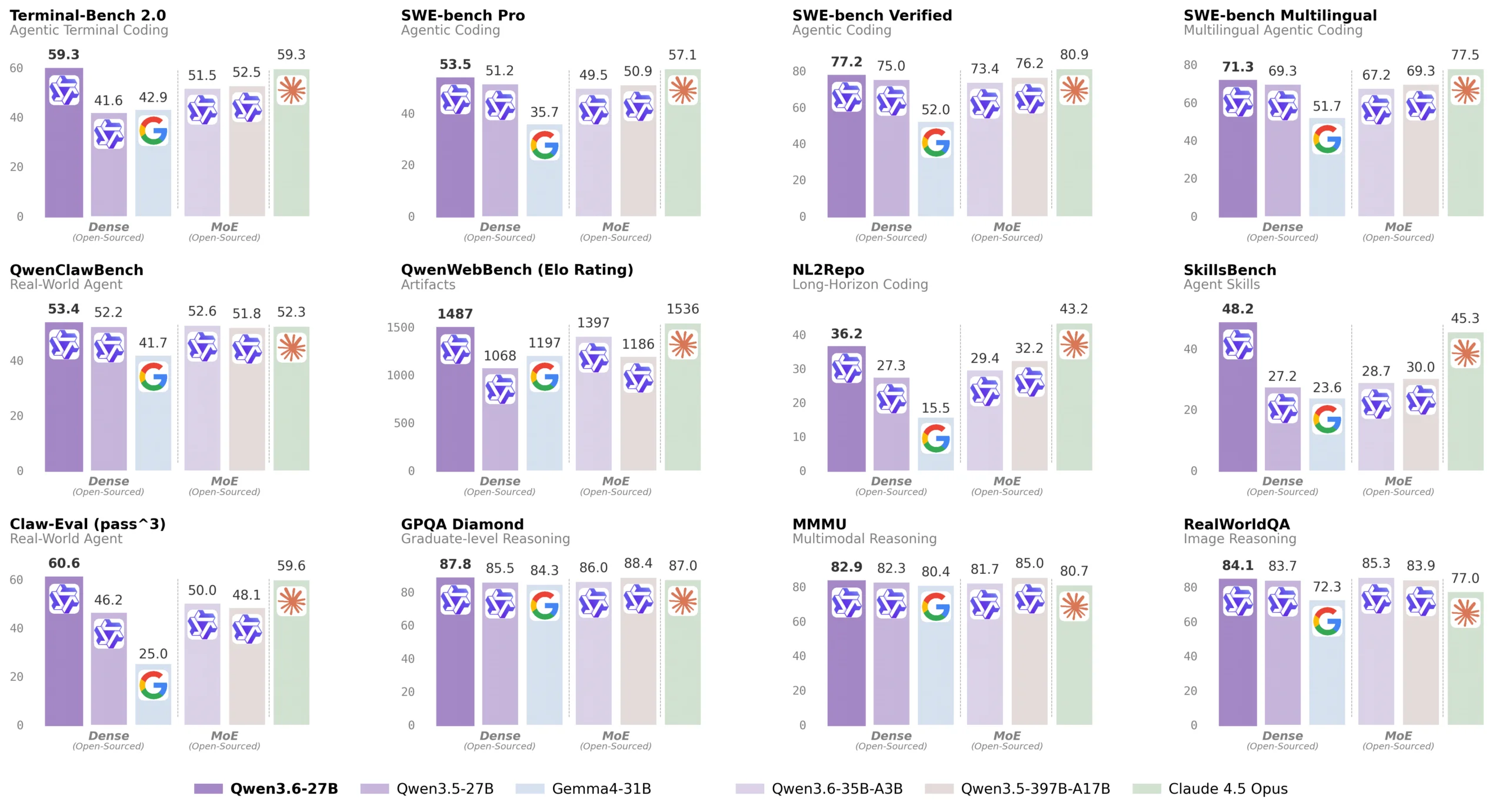

モデル仕様と性能

Nemotron 3 Nano Omni は 30 億パラメータの規模で、Mamba-Transformer ハイブリッドアーキテクチャに Mixture-of-Experts(MoE)を採用。推論時には約 3 億パラメータがアクティブに機能し、コンテキストウィンドウは 256,000 トークンに対応している。

性能面では OSWorld ベンチマーク(GUI エージェント向け)で 11.1 から 47.4 ポイントへと大幅に向上。Qwen3-Omni との比較では、同等の推論レベルで最大 9 倍のスループット性能を実現している。この高速化は、エンタープライズ環境で多数のエージェントを並行実行する際に重要な利点となる。

トレーニングデータの透明性

注目すべき点は、トレーニング構成の透明性だ。全 717 億トークンにわたる 7 段階のトレーニングに、OpenAI の gpt-oss-120b、Qwen、Kimi-K2.5、DeepSeek-OCR など複数企業のモデルからの学習データが含まれている。このアプローチは、複数のオープンソースおよび企業モデルの知見を統合し、より堅牢なマルチモーダル能力を構築することを意図している。

ビジネスとエコシステムへの影響

Nemotron 3 Nano Omni は NVIDIA Open Model Agreement の下で商用デプロイが可能。モデル重みだけでなく、トレーニングデータとトレーニングパイプラインも提供されるため、企業は独自の用途に合わせたカスタマイズが容易だ。

GPU リソースと開発人材が潤沢でない企業にとって、事前学習済みのマルチモーダルモデルへのアクセスは、生成 AI 活用の参入障壁を下げる。Nvidia は自社シリコンとの親和性を高めながら、エコシステム全体の活性化を図る戦略を進めている。

今後の展望

現在は英語のサポートに限定されているが、このモデルが複数言語対応に拡張されれば、グローバル企業の AI 導入が加速する可能性がある。エージェント能力の向上は、顧客サポート、データ分析、業務自動化など、実務的な利用シーンの拡大につながるだろう。