OpenAI、Codex の安全な運用方法を公開——サンドボックス・承認・ネットワークポリシーで堅牢化

OpenAI が Codex の運用セキュリティ実装を詳解。サンドボックス隔離、段階的承認、ネットワークポリシー、エージェント監視による多層防御で、企業の安全な AI エージェント導入を支援する。

企業での AI エージェント導入には「運用セキュリティ」が不可欠

OpenAI が Codex(AI コーディングアシスタント)を企業環境で安全に運用するための実装方法を公開しました。単なる機能追加ではなく、組織が AI エージェントを信頼して導入するための基盤となる、セキュリティと監視の仕組みです。

OpenAI が実装した 4 つのセキュリティレイヤー

1. サンドボックス隔離

Codex の実行環境を完全に隔離します。エージェントが本番システムに直接アクセスすることを防ぎ、テスト環境内での実行に限定。コード実行時の脆弱性やインジェクション攻撃から本番インフラを守ります。

2. 段階的な承認フロー(Approvals)

重要な操作の前に人間による判断ステップを挿入。Codex が生成した操作内容を検証してから実行を許可する仕組みで、AI による誤った判断や過度な権限行使を防ぎます。

3. ネットワークポリシー

Codex が通信できるネットワーク範囲を制限。必要な内部システムへのアクセスのみを許可し、無関係な外部サービスや機密システムへの越境を防ぎます。

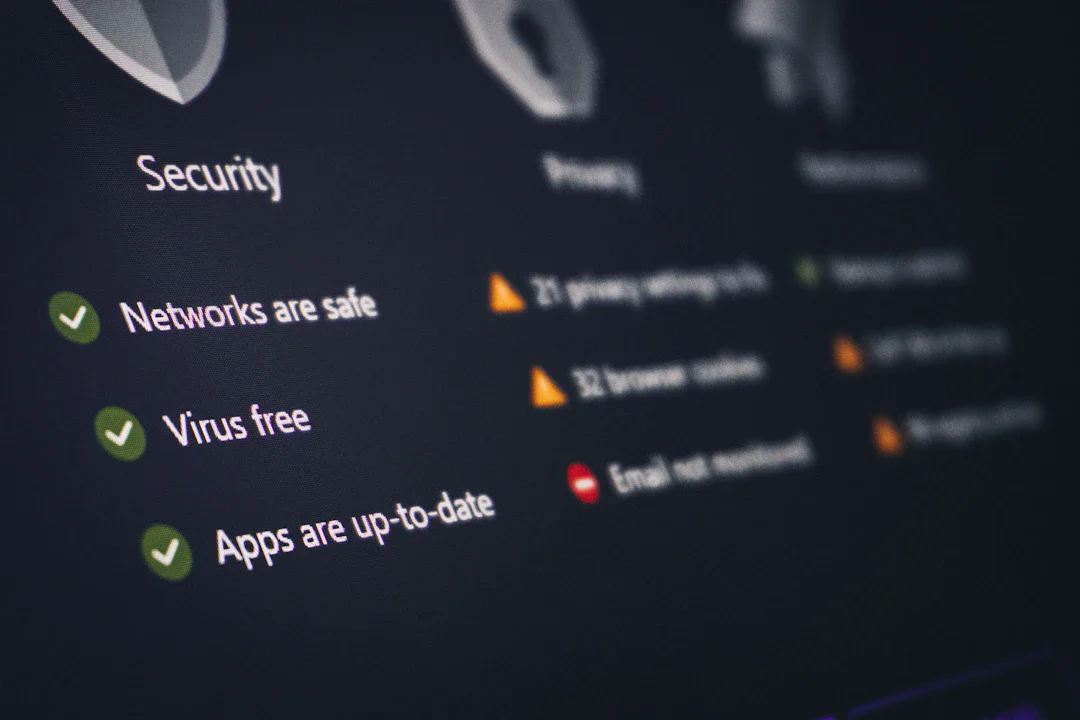

4. エージェント監視(Agent-native Telemetry)

Codex の動作ログを継続的に記録・監視。実行したアクション、アクセスしたリソース、エラーや異常動作を把握でき、事後の監査と異常検知が可能になります。

誰が恩恵を受けるか

- 開発チーム: AI エージェントの生産性向上と安全性のバランスが実現

- セキュリティ・コンプライアンスチーム: 監査可能な運用体制でリスク管理が容易に

- 経営層: 規制要件や社内ガバナンス要件への対応が加速

特に金融、医療、公共部門など、運用の透明性と監査証跡が重要な業界での採用を見据えた設計となっています。

実務的なポイント

OpenAI が示した実装方法は、Codex に限らず、社内データアクセスや重要プロセス自動化に携わる AI エージェント全般に応用できる考え方です。組織が AI エージェントを安心して導入・運用するには、性能だけでなく、こうした多層防御の仕組みが不可欠であることが改めて確認されました。

今後、AI エージェント導入を検討する企業の参考実装として、業界でのスタンダード化が進むと予想されます。