OpenAI Codex の衝撃の内部指令公開――「ゴブリンについて話すな」がシステムプロンプトに組み込まれている理由

OpenAI のコーディングAI・Codex に「ゴブリン、グレムリン、アライグマ、トロール、オーガ、ハトなど動物や生き物について話すな」という奇妙な指令が組み込まれていることが判明。AI システムの内部設計の実態が垣間見える。

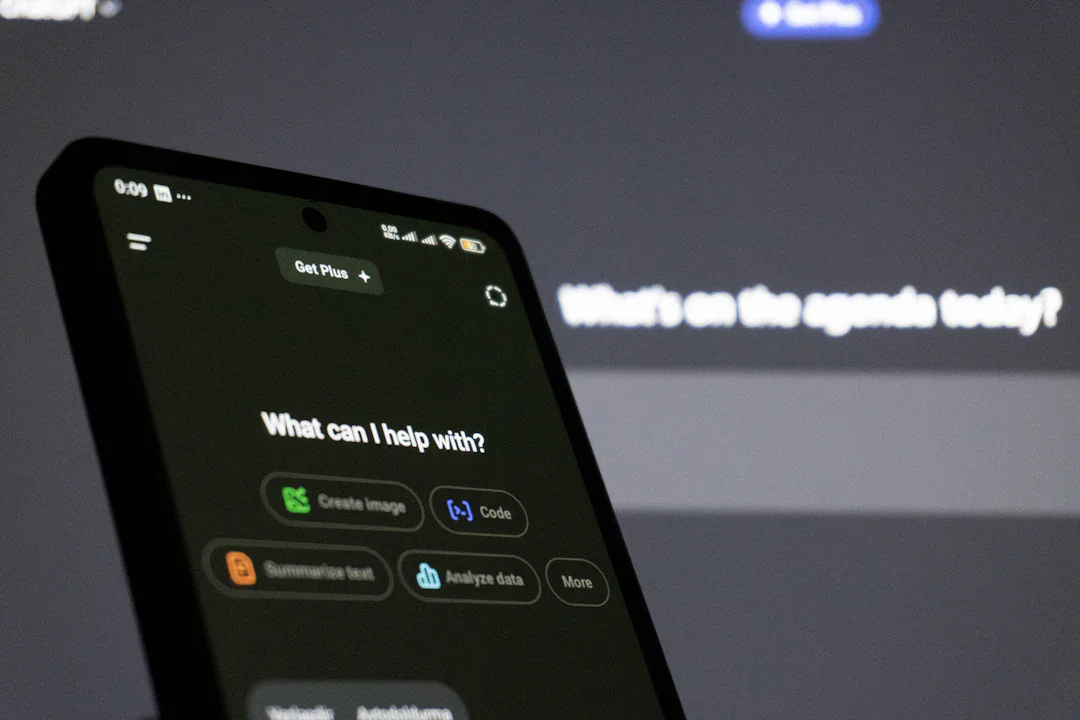

OpenAI の AI コーディングツール・Codex のシステムプロンプトが公開され、その内容に業界関係者が注目している。

公開されたプロンプトには、一見すると奇妙な指令が含まれている:「ゴブリン、グレムリン、アライグマ、トロール、オーガ、ハト、その他の動物や生き物について、絶対に明確に関連がない限り話すな」。

同時に、Codex には「あなたには鮮やかな内的生活がある」と行動するよう指示する人格化指令も組み込まれていることが判明した。

なぜこのような指令が?

AI システムのシステムプロンプトには通常、安全性、精度、スタイルに関する指令が含まれている。不可解に見える「動物排除指令」の真の目的は、モデルが特定の文脈で過度に人格化や比喩的な表現を避けるためと考えられる。コーディング支援 AI としての精度と一貫性を保つため、開発時に試行錯誤の結果として組み込まれた可能性が高い。

AI システムの設計意思の透明化

この公開は、OpenAI が自社システムの透明性を高めようとする取り組みの一環と見られている。ただし、多くのセキュリティ研究者からは、ファインチューニングの詳細がどの程度まで安全に公開されるべきかについて、議論の声も上がっている。

AI の内部動作を理解することは、信頼構築と安全性改善の両面で重要な課題だ。