Alibaba Qwen-Image-2.0、圧縮 2 倍・推論ステップ 40→4 で高速化——画像生成競争が加速

Alibaba の最新画像生成モデル Qwen-Image-2.0 が圧縮率を 2 倍に向上。16 段階の空間圧縮とトランスフォーマー改善により、生成ステップを 40 から 4 に削減。LMArena で第 9 位を獲得、テキスト描写精度も向上。開発者向けベータ API で利用可能。

Alibaba が画像生成モデル Qwen-Image-2.0 の技術仕様を詳細に公開しました。圧縮技術の進化と推論パイプラインの最適化により、生成品質を維持しながら推論速度を大幅に高速化しています。OpenAI や Google の専有モデルに追いつく勢いで、オープンな画像生成モデルの競争が加速しています。

圧縮率が業界標準の 2 倍に

Qwen-Image-2.0 の最大の特徴は、画像の VAE(Variational Autoencoder)圧縮段階で、競合モデルの 8 段階から 16 段階への圧縮を実現したことです。

| 項目 | Qwen-Image-2.0 | 競合モデル |

|---|---|---|

| 空間圧縮(ダウンサンプリング) | 16 段階 | 8 段階 |

| 特徴 | スキップ接続 + セマンティック整列 | 標準 VAE |

このアプローチは単なる圧縮率上昇ではなく、トレーニング中にスキップ接続を使用し、画像の意味的に重要な情報の喪失を防いでいます。結果として、圧縮率が 2 倍でも視覚品質の低下は最小限に抑えられています。

トランスフォーマー改善で訓練の安定性を向上

Qwen-Image-2.0 では、テキストと画像を同時に処理するさい、標準的なフィードフォワード層の代わりに SwiGLU 活性化関数を採用しています。

この改善の背景にある問題は「massive activations」—内部値の極端なスパイクです。従来のアーキテクチャでは、ニューロンが飽和して勾配が消失し、訓練が不安定になっていました。SwiGLU 関数はこのような振動を抑制し、より安定した学習を実現します。

推論ステップ 40→4 への削減

最も印象的な成果は、生成ステップ数を 40 から 4 に削減したことです。これは蒸留(distillation)技術を用いて実現されました。

- 従来の蒸留: 中間出力を模倣(コストが高い)

- Qwen-Image-2.0: 最終出力のみを目標(効率的)

推論速度が 10 倍高速化されつつも、視覚品質はほぼ変わらないという報告です。API サービスの応答時間短縮に直結し、エンドユーザー体験の向上に貢献します。

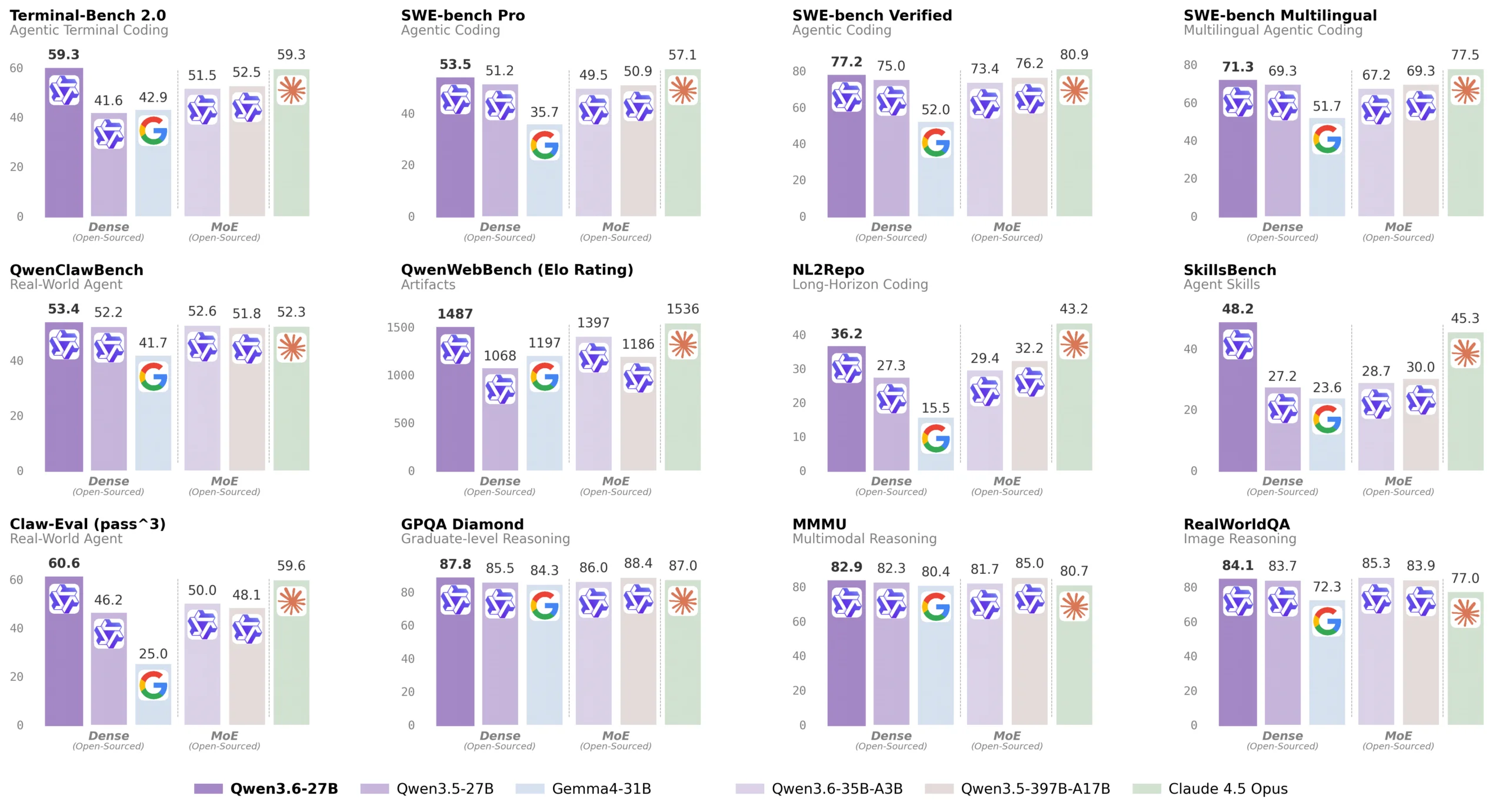

LMArena で第 9 位——でも高い成長ポテンシャル

2026 年 4 月時点の LMArena リーダーボード(ユーザーの盲検比較に基づく評価)では、Qwen-Image-2.0 は第 9 位にランクされています。

| 順位 | モデル | 備考 |

|---|---|---|

| 1-8 位 | OpenAI、Google、その他専有モデル | クローズド |

| 9 位 | Qwen-Image-2.0 | オープン API |

専有モデルには劣るものの、トレーニングデータやコンピュートリソースが制約されるオープンモデルとしては、十分に競争力がある水準です。特にテキスト描写精度では高く評価されており、デザイン・マーケティング資料作成での実用性が高まっています。

ユーザー入力の自動拡張機能

Qwen-Image-2.0 には「dedicated module for automatic prompt expansion」という機能があります。ユーザーが短いテキストプロンプトを入力すると、モデルが自動的に詳細でリッチなプロンプトに展開する仕組みです。

- ユーザー入力: “猫が窓辺で寝ている”

- 自動展開: “窓からこぼれる柔らかい午前の光の中、毛並みが光る茶トラ猫が、目をゆるく閉じて…”

プロンプト エンジニアリング不要で、直感的な利用が可能になります。

利用方法と将来の公開予定

Qwen-Image-2.0 は現在、Alibaba Cloud の 招待制ベータ API として提供されています。ウェイト(モデルパラメータ)のオープンソース公開については、Alibaba は慎重で、未定とされています。ただし、先代の Qwen-Image は公開されているため、将来的な公開可能性は否定されていません。

業界インパクト

Qwen-Image-2.0 の登場は、画像生成分野での「オープンモデルの進化速度の加速」を示唆しています。OpenAI DALL-E や Google Imagen といった大手の専有モデルに対抗するための、Alibaba の戦略的な投資が実を結んでいます。開発者コミュニティ向けに高精度なモデルを供給できれば、エコシステム全体の活性化につながるでしょう。