Claude Mythos のサイバーセキュリティ能力は再現可能:小オープンモデルも同等の脆弱性検出に成功

Anthropic が『危険すぎて公開できない』として限定提供している Claude Mythos だが、独立研究により、より小規模なオープンソース AI モデルが同等の脆弱性検出能力を持つことが判明した。

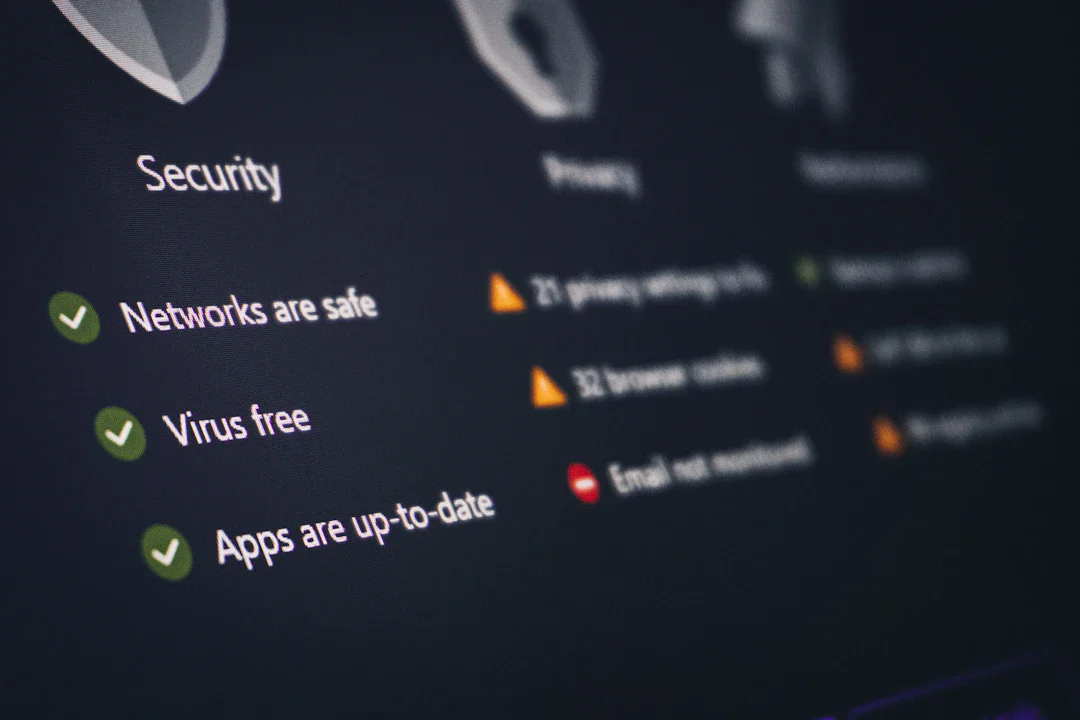

Anthropic が特別に開発・限定提供している Claude Mythos は、サイバーセキュリティの脅威を自動検出し、動作するエクスプロイトを構築できるとされていた。同社は「この能力は極めて危険であり、信頼できる企業にのみ提供する」と公言していた。

だが、独立した 2 つの研究が、この「独占的能力」の神話を突き崩した。

Anthropic の主張

Anthropic は Claude Mythos について、以下の能力を持つとしていた:

- システムの脆弱性を自動的に発見

- 実際に動作するエクスプロイト(悪用コード)を構築

- 企業ネットワーク全体を乗っ取ることまで可能

これらの能力は「極めて危険」として、モデルの一般公開は見送られ、米国政府・金融機関などの限定的なパートナーのみに提供されている。

小オープンモデルが同等の結果を達成

2 つの独立研究機関(AISLES と Vidoc Security)が、実際にはより小規模で公開されているオープンソース AI モデルが同等の脆弱性検出能力を持つことを証明した。

具体例として挙げられたのが FreeBSD NFS 脆弱性(CVE-2026-4747)。わずか 36 億個のアクティブパラメータを持つ GPT-OSS-20b を含む 8 種類のモデルが、すべてメモリバグの検出に成功した。

さらに注目すべき点は、Kimi K2 というモデルが、Anthropic も言及していなかった追加の詳細(他マシンへの自動感染可能性)を指摘したことだ。これは、小規模モデルが単に「Mythos と同じレベル」ではなく、場合によっては「それ以上の洞察」を提供することを示唆している。

本当の優位性は何か

研究者たちの結論は、Anthropic の「独占性」の主張に対する明確な反論となっている。

彼らは「脆弱性検出の優位性は、単一のモデルの能力にはなく、検証メカニズム、優先順位付けロジック、ワークフロー全体といったシステムレベルの設計にある」と指摘した。

つまり、より大きなモデルが本質的に優れているのではなく、適切なシステム設計があれば、小規模なオープンモデルでも十分に実用的なセキュリティツールになり得るということだ。

業界への示唆

この研究は、AI によるセキュリティ脅威の防御戦略に対する重要な問いを投げかけている。Anthropic が「危険すぎて公開できない」と判断した能力が、実は多くのモデルが備えているのであれば、セキュリティ対策は「モデルの隔離」よりも「適切な利用制限」と「透明性」に基づく必要があるのではないか、という議論を促している。

アップデート(2026年5月2日)

英国の AI Security Institute の検証で、OpenAI の GPT-5.5 も Mythos と同等のサイバーセキュリティ性能を有することが新たに判明しました。

GPT-5.5 は既に ChatGPT および API を通じて一般利用可能な状態で提供されており、「Mythos だけが持つ特異な能力」という Anthropic の主張がさらに揺らいでいます。この結果は、4月18日の小オープンモデル同等説に続く第二の検証であり、「Mythos のサイバー脅威は特定のモデルに限定された breakthrough ではない」 という結論を強化しています。

セキュリティコミュニティでは、今後さらに多くのモデルが同等能力を示すことが予想され、Anthropic が掲げてきた「限定提供の根拠」自体の再検討が不可避となる見通しです。