GoogleがA2UI 0.9で生成UIを標準化、Ray-Ban MetaのAIスマートグラスが日常タスクを高速化

GoogleがAIエージェント向けに生成UI標準「A2UI 0.9」をローンチ。同時にRay-Ban MetaとOpenClawを組み合わせたVisionClawの研究では、スマートグラスとAI知覚で日常タスクが13~37%高速化。UIの自動生成と常時知覚が融合する新時代が到来。

Googleが新たなAIエージェント時代のインフラを本格化させています。開発者向けの「A2UI 0.9」標準をローンチして、UIの自動生成をフレームワーク非依存で実現する道を整備。同時にRay-Ban MetaメガネとAIの組み合わせが実用化に近づき、スマートグラスを使った常時知覚型エージェントが日常タスクの効率を飛躍的に高める可能性が見えてきました。

GoogleのA2UI 0.9で「AIが作るUIを標準化」

A2UI 0.9はGoogle発表の新しいオープン標準です。AIエージェントがボタンやフォーム、入力欄などのUIコンポーネントをフレームワークを問わず動的に生成できる仕組みを定義しています。これは単なる要素の挿入ではなく、既存のアプリケーション資産(Webサイト、モバイルアプリ、その他プラットフォーム)のコンポーネント群を活用してAIが自在に組み替える設計です。

標準に含まれるのは、ReactレンダラーのほかFlutter・Lit・Angularのオフィシャル対応、Python・Go・KotlinのエージェントSDKです。AG2やA2A 1.0などの既存エコシステムとの連携も織り込まれており、開発現場での実装障壁を意識的に低くしています。

この標準化の狙いは明快です。エージェント側がUI生成をAPIで統一できれば、アプリケーション側は自分たちの既存コンポーネントをエージェントに「見せる」だけで済みます。セキュリティレイヤーの統一、デバッグの共通化、新しいエージェントフレームワークの参入障壁の低下——開発者エコシステム全体が高速化する条件が整います。

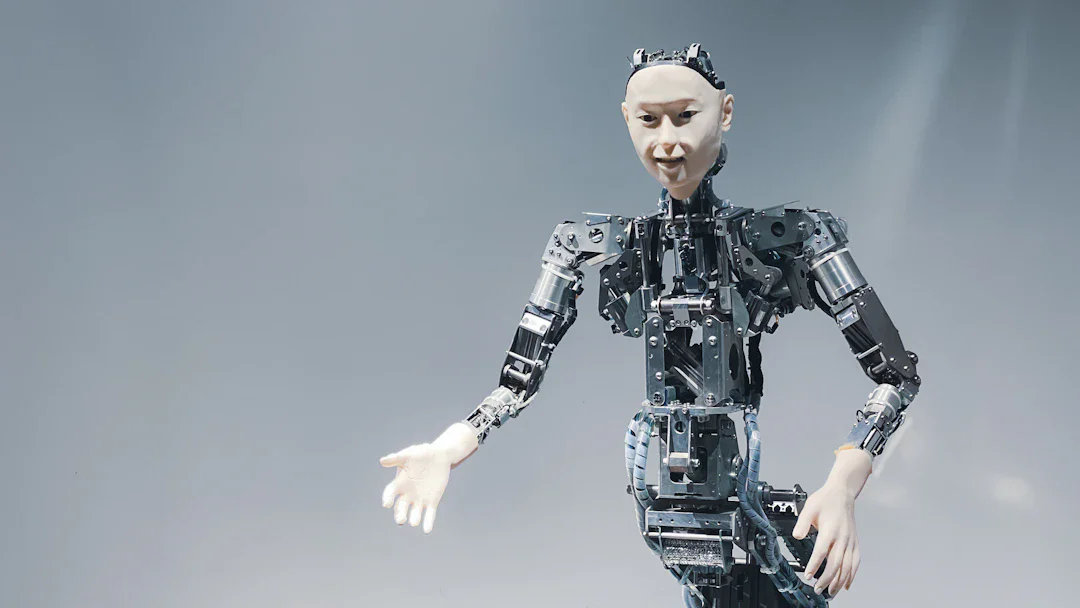

Ray-Ban MetaのスマートグラスがOpenClawで「常時思考」を実現

一方、RayBanメガネの実用化も急速に進行中。研究チーム開発の「VisionClaw」というシステムは、Ray-Ban Metaメガネに搭載されたカメラとマイクをスマートフォン経由でGoogle Gemini LiveとOpenClawに接続し、ユーザーが何をしているかをAIが常に「見て」「聞いて」把握しながら自動で行動するというもの。

実験結果は目を引きます。タスク完了速度が13~37%高速化、ユーザーが感じる負担は7~46%軽減。何より、フィールド研究で記録された555件の音声インタラクションを分析すると、情報検索(30%)・ショッピング(19%)・コンテンツ保存(16%)・連絡(14%)・記憶(12%)・デバイス制御(9%)と、日常生活全般でAIが有用に機能していることが分かります。

このシステムの強みは「常時知覚」にあります。従来のスマートスピーカーやスマートフォンは、明確な指示(「天気を教えて」)を待つ受け身型。VisionClawはユーザーが画面上の商品を見ているだけで購入フローを推察し、ブラウザやメールツールを自動実行する主動型です。ユーザーは「何かしたいな」と思った瞬間、AIが既に準備を整えている状態を経験します。

来年の日常が大きく変わる

A2UI標準化とスマートグラス実用化は別々の動きに見えますが、実は深く繋がっています。Googleはエージェントが「何をやるのか」だけでなく「どう見えるのか」も標準化する全体戦略を示しています。

エージェント側がUI生成を自由に行え、ユーザー側が常時知覚で結果を即座に受け取れる環境が出来上がれば、既存のスマートフォン・Webアプリの使い方は大きく変わるでしょう。「探す→クリック→指示→待機」という従来のフロー型から「背景でAIが準備→ユーザーが気づく→承認」という前倒し型へのシフトです。

VisionClawはGitHubでオープンソース化され、研究段階は終わりに向かっています。来年までには、スマートグラスを使った常時思考型AIが特別な存在ではなく、ビジネスツールとしての地位を固めているかもしれません。