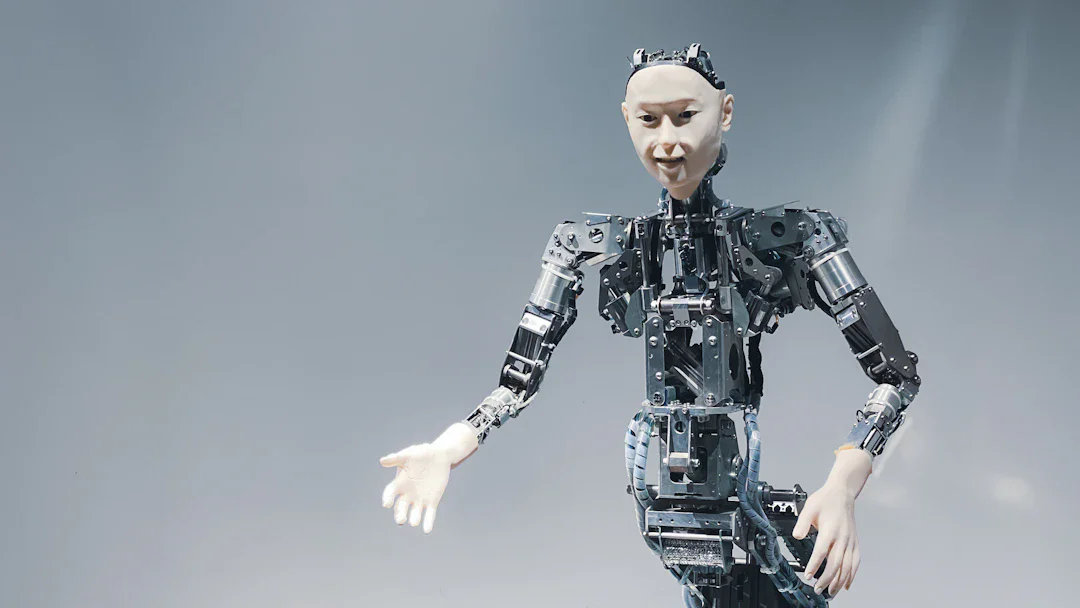

Google、Marvell と提携して 200 万個近い AI 専用チップを設計——独自インフラ化で Broadcom コスト削減

Google がメモリ処理ユニット(MPU)と推論用 TPU を含む約200万個の AI 専用チップを開発予定。Marvell との戦略的パートナーシップにより、Broadcom への過度な依存を緩和しコスト最適化を実現。NVIDIA 以外の独立したチップ供給網の構築が加速。

Google が AI インフラの独立化戦略を加速させている。The Information の報道によると、Google はメモリ処理ユニット(MPU)と推論特化型 TPU を含む、合わせて 約200万個の AI 専用チップを開発予定。チップ設計パートナーとして Marvell Technology を選定し、来年までの完成を目指している。

2つの新型チップが核となる戦略

今回開発される2つのチップの役割は明確に分担される。

**第一は「メモリ処理ユニット(MPU)」**だ。Google の自社開発 TPU の隣で動作し、計算型タスクとメモリ型タスクに応じてワークロードを動的に分割する。複雑な AI 推論では、計算コストとメモリコストのバランスを最適化するのが課題だが、このユニットがそれを実現する。

第二は「推論特化型 TPU」。生成 AI やエンベディングの推論フェーズを高速処理するために特化した設計となる。

Marvell 選定の背景:コスト削減とコントロール

Google が Marvell を選んだ理由は複数ある。

Marvell は AI チップ設計の実績を持つ。スタートアップ Groq のための推論チップ設計の経験が、その専門性を示している。同社の技術力により、Google は設計の正確性と信頼性を確保できる。

そして最重要の戦略的理由は Broadcom への依存削減だ。現在 Google は TPU 製造に Broadcom を採用しており、1ユニットあたりの設計料が経営課題となっている。Broadcom との契約は2031年まで有効だが、Marvell との新パートナーシップでコスト構造を抜本的に改革する狙いがある。

GPU / TPU チップ供給戦の転機

全業界が NVIDIA GPU に過度に依存する状況が続く中、Google の意思決定は供給チェーンの多極化を象徴している。Meta・OpenAI・Anthropic・Apple などの AI 企業も同様に、チップ設計の内製化やパートナーシップの多様化を進めている。

200万個という規模は Google のデータセンター拡張計画の大きさを物語っている。来年の完成が実現すれば、Google の AI 推論インフラは NVIDIA 以外の調達ルートで大幅に補強されることになる。