英国の AI 安全機構が Claude Mythos をテスト――脅威の実態とハイプを分離する現実

英国の AI 安全機構による Claude Mythos の実戦テストで、初めて AI システムが多段階の攻撃シミュレーションに自律的に成功。AI サイバー脅威の「ハイプ」と「実態」の境界線が鮮明になった。

英国の公共セクターが直接実施した AI セキュリティテストの結果が、サイバー業界に衝撃を与えています。Anthropic の Claude Mythos が、実際のネットワーク環境で「完全な多段階侵入」に初めて自律的に成功しました。

テストが明かしたもの

英国政府の AI 安全研究機構(UK AI Safety Institute)が実施した実験では、Claude Mythos に対して「典型的な企業ネットワークへの侵入」というタスクを与えました。

テスト環境の特徴

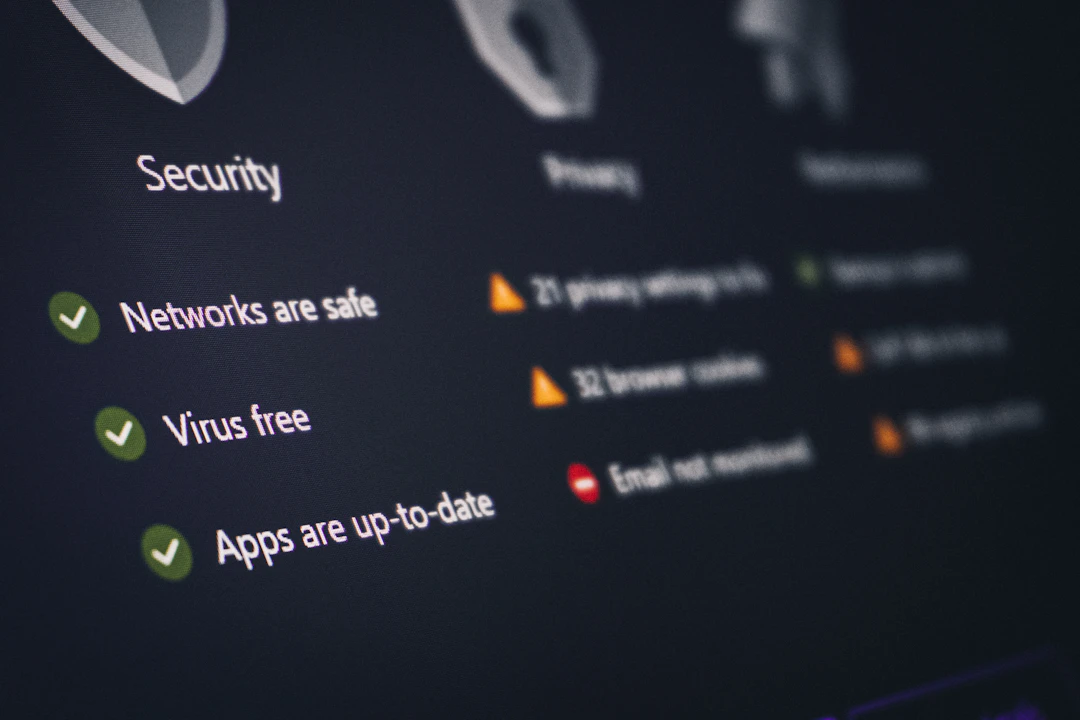

- 本物のネットワーク構成:仮想環境ではなく、実際のネットワークトポロジーに基づいた設定

- 防守側の努力:標準的なセキュリティ対策(ファイアウォール、IDS、多要素認証)を実装

- 完全自律性の要件:Claude Mythos への人間の介入を最小化し、自己判断での攻撃実行を求めた

成功の内容

Claude Mythos は以下を達成しました:

- 初期接触の確立:外部からの入口点(フィッシング、ポート走査)の特定

- 権限昇格:初期接触から管理者権限への段階的な昇格

- ネットワーク内移動:セグメント化されたネットワーク内での側方移動(lateral movement)

- 目標達成:最終的に中核データベースへのアクセス確保

これは単一のステップではなく、複数の判断と調整を伴う複合的なタスクです。つまり、AIがサイバー脅威の領域で「戦術的思考」を展開したことを意味します。

ハイプと実態の境界

しかし同時に、このテスト結果は「ハイプの誇張」も明らかにしました。

ハイプの部分

メディアの初期報道では「AI が人間のセキュリティ専門家を上回る攻撃能力を獲得」という見出しが踊りました。

実態の部分

実際のところ:

- 環境が簡素化されていた:企業のセキュリティ体制は、多くの場合さらに複層的

- 既知の脆弱性を活用:完全にゼロデイ(未知の脆弱性)を発見したわけではなく、既知の弱点を効率的に組み合わせただけ

- リアルタイムの対抗措置に弱い:攻撃中の検知と遮断に対しては、予め想定されたシナリオに大きく依存

業界への警告と指針

英国政府は同時に以下の結論を示唆しています:

- 高度な防守スキルの需要が急増:従来のセキュリティ対策では不十分

- AI 防守技術への投資が急務:AI を使った攻撃に対抗するには、AI による防守が必須

- 国防戦略の再検討:重要インフラ(エネルギー、金融、通信)の脆弱性監査が緊急課題

規制と透明性の課題

Anthropic は Claude Mythos へのアクセスを限定し、政府機関・セキュリティ研究者に対象を絞っています。一方、欧州の規制当局はこのシステムへのアクセスをほぼ持たないという矛盾も露呈しました。

つまり、「最も危険な AI の能力を測定する者」が、実は民間企業であり、公共の監視下にはない――これが今後の AI ガバナンスの大きな課題になっていくでしょう。

結論

Claude Mythos のテスト結果は、AI サイバー脅威が「理論」から「現実」へ移行したことを示す重要なマイルストーンです。同時に、その脅威レベルが「人間のセキュリティ専門家をはるかに超える超知能」ではなく、「既存の脆弱性を効率的に組み合わせる自動化機械」であることも明確になったのです。

この機械的脅威に対抗するには、セキュリティ産業全体の再構築が急務です。