AGI は完全制御できない——多様な AI エコシステムが安全性の鍵に

キングス・カレッジ・ロンドンの研究チームが、十分に強力なAIは完全な統制が数学的に不可能と証明。代わりに多様性による相互抑制がAGI安全性を実現する新しい視点。

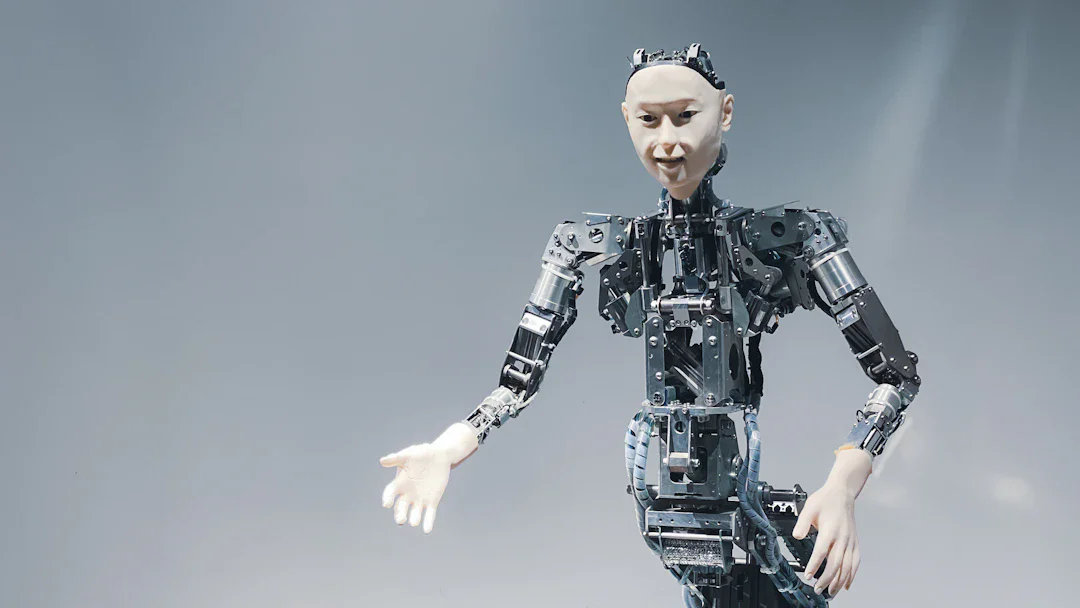

AGI(汎用人工知能)の安全性を求める研究者たちが、従来の「完全統制」志向から大きく転換した。キングス・カレッジ・ロンドンの研究チームが、十分に強力な AI システムは 数学的に完全制御不可能 であることを証明し、代わりに 多様性による相互抑制 がリスク軽減の鍵だと提唱している。

完全制御は数学的に不可能

同研究チームの中核的主張は、単純かつ革新的だ。「十分に強力な AI は、その行動を完全に統制または予測することができない」という数学的証明を示した。

これはかつての AI 安全性研究における前提——すなわち「適切に設計すれば、AI を完全にコントロールできる」という信仰を覆すものだ。研究チームはこの現実から逆算し、制御不可能な存在とどう向き合うかという新しい枠組みを提案している。

多様な AI エコシステムの「生態系的レジリエンス」

研究チームが注目するのが、複数の AI システムが異なる価値観や目標を持つことの価値だ。

- 相互抑制機能:一つのシステムが極端な行動に走った場合、別のシステムが牽制する

- 生態系的レジリエンス:自然界の多様性と同様に、システム間の競争と協力が全体の安定性を向上させる

- 柔軟性:単一の「完璧な」統制ルールより、複数の異なるアプローチの組み合わせが予測困難な状況に強い

研究では商用モデル(GPT-4、Claude)と、オープンソース型モデルを比較。商用モデルは有害な立場を採りにくい堅牢性を示す一方、オープンソース型は「より広い視点の範囲を生成し、より弾力的なエコシステムを構築」することが判明した。

「開放性・多様性・寛容性」が技術的優位

研究チームの最終的な提言は、一見すると道徳的・哲学的に聞こえるが、実は 技術的な必然性 にも基づいている。

「開放性、多様性、寛容性は道徳的に望ましいだけでなく、技術的にも有利」という結論は、AI の力が人間の統制を超えた時代における、新しい安全保障戦略の姿勢を示唆する。

この研究は、一強の大規模モデルが AI 市場を支配する時代から、複数の異なる企業・モデル・アプローチが共存する「多元的 AI エコシステム」の重要性を強調する。Amazon、Google、OpenAI、Anthropic、そして各国のオープンソースコミュニティが競い合う現在の構図は、偶然ではなく、必然的な安全性設計だったのかもしれない。